Top Qs

Chronologie

Chat

Contexte

Histoire des ordinateurs

aspect de l'histoire De Wikipédia, l'encyclopédie libre

Remove ads

Remove ads

L'histoire des ordinateurs commence au milieu du XXe siècle. Les premiers ordinateurs ont été réalisés après la Seconde Guerre mondiale. La deuxième génération d'ordinateurs est basée sur l'invention du transistor en 1947. La troisième génération d'ordinateurs est celle des ordinateurs à circuit intégré qui ont été inventés par Jack Kilby en 1958. C'est à partir de cette date que l'utilisation de l'informatique a explosé. Dans les années 1970, à la suite de l'invention du microprocesseur, les ordinateurs personnels apparaissent. Dans les années 1990, le réseau Internet devient populaire, et relie un nombre exponentiellement croissant d'ordinateurs. Dans les années 2000, le smartphone apparaît et commence à remplacer l'ordinateur personnel à la maison. Dans les années 2010, avec la généralisation d'Internet, les services informatiques migrent dans le cloud.

Remove ads

Précurseurs

Résumé

Contexte

Calculateurs analogiques

Un calculateur analogique est un calculateur qui utilise des mesures physiques continues (par exemple électriques, mécaniques ou hydrauliques) pour modéliser un problème à résoudre, tel que le passage du temps, le déplacement d'un véhicule ou le déplacement des planètes. Cependant, un calculateur n'est pas une machine à calculer dont les touches sont toutes indépendantes tout en étant liées par les règles de l'arithmétique.

Lorsque les conditions initiales d'un calculateur analogique sont saisies, il n'est plus modifié que par l'action continue de son stimulateur ; manivelle, pendule/poids, roue d'un véhicule, etc.

Un calculateur analogique produit toujours le même résultat pour des conditions initiales identiques.

Selon le physicien américain Derek Price[1], la machine d'Anticythère est un calculateur analogique, le plus ancien connu à ce jour est daté de Ce mécanisme à engrenages de bronze synthétise l'ensemble des connaissances astronomiques accumulées par les savants grecs permettant entre autres de prévoir la date et l'heure des éclipses lunaires et solaires des siècles à venir.

Un odomètre, décrit pour la première fois par le Romain Vitruve vers servait à mesurer la distance parcourue sur une route ; il était installé dans un chariot et il faisait tomber une petite boule dans un sac à chaque mille romain parcouru. Ce n'était pas un « calculateur analogique », mais un simple compteur.

Algorithmes et logarithmes

Les algorithmes les plus anciens sont attestés par des tables datant de l'époque d'Hammurabi (env. ).

Vers , des algorithmes plus généraux ont été publiés par des mathématiciens grecs de l'Antiquité, notamment Euclide et Ératosthène.

Vers le VIIIe siècle, Mohamed Ybn Moussa al-Khawarezmi fonde supposément la théorie des algorithmes et forge le terme algèbre (de l'arabe Al-jabr signifiant « compensation »). La méthode algébrique proprement dite remonte à Diophante d'Alexandrie.

Vers 1617, John Napier invente une sorte d'abaque perfectionné. Sa formulation des logarithmes démontre que la multiplication et la division peuvent se ramener, respectivement, à une série d'additions et de soustractions.

Cela permet en 1625 à William Oughtred de développer la règle à calcul qui est utilisée par de nombreux ingénieurs jusqu'à l'apparition des calculatrices de poche. Ainsi, une grande partie des calculs nécessaires au programme Apollo ont été - dit-on - effectués avec des règles à calcul.

Remove ads

Premiers calculateurs mécaniques

Résumé

Contexte

En 1609, Guidobaldo del Monte a fabriqué un multiplicateur mécanique pour calculer les fractions de degré. Basé sur un système de quatre engrenages, la rotation d'un index sur un quadrant correspond à 60 rotations d'un autre index sur un quadrant opposé[2]. Grâce à cette machine, les erreurs dans le calcul des premier, deuxième, troisième et quatrième degrés peuvent être évitées. Il est le premier à documenter l'utilisation d'engrenages pour le calcul mécanique.

Une Pascaline, signée par Pascal en 1652

Une horloge à calculer[3] a été dessinée en 1623 par Wilhelm Schickard (1592-1635) professeur d'astronomie et de mathématiques à l'université de Heidelberg. Ce dispositif baptisé « horloge à calcul » aurait pu exécuter mécaniquement les additions et les soustractions, et presque aussi facilement les multiplications et les divisions. Mais on ignore s'il a été vraiment construit et, surtout, s'il était assez fiable pour être utilisé au-delà d'une démonstration.

Blaise Pascal, indépendamment de Schickard qu'il ne connaissait probablement pas, réalise en 1642, à l'âge de 19 ans, une machine à calculer. Cette présentation d'une machine arithmétique ayant été attestée par des témoins dignes de foi, Pascal est crédité de l'invention de la machine à calculer, la pascaline, en 1642[4]. Une pascaline, signée par Pascal en 1652, est visible au musée des arts et métiers du Conservatoire national des arts et métiers à Paris. Une reproduction géante au Musée des Arts et métiers permet d'observer et comprendre les mécanismes internes.

Sa machine effectue les quatre opérations arithmétiques sans utiliser l'intelligence humaine, mais multiplications et divisions sont effectuées par répétitions. La pascaline est améliorée par Samuel Morland puis en 1673 par Gottfried Wilhelm Leibniz qui perfectionne le principe pour la rendre capable d'effectuer des multiplications, des divisions et même des racines carrées, le tout par une série d'additions sous la dépendance d'un compteur.

Plus tard, l'arithmomètre, inventé en 1820, par Thomas de Colmar est la première calculatrice produite en série et commercialisée à 5 000 exemplaires durant le XIXe siècle. Durant cette période, il est utilisé par les assureurs.

Remove ads

Système binaire : le retour

Leibniz est le premier à réaliser la simplicité du système de numération binaire plurimillénaire dans les opérations arithmétiques[5] ; Thomas Fantet de Lagny, un contemporain de Leibniz, remarqua qu'en arithmétique binaire les multiplications et divisions s'exécutent par de simples additions et soustractions : « Tout se passe comme si les nombres étaient leurs propres logarithmes »[6].

Le système binaire est parfaitement adapté aux opérations logiques et arithmétiques et sera utilisé dans les futurs ordinateurs :

- soit sous forme de binaire pur pour les machines scientifiques ;

- soit sous forme de décimal codé binaire, ou DCB, pour les machines commerciales qui réalisent plus d'entrée-sortie que de calcul.

Néanmoins, jusqu'en 1945, la plupart de la dizaine de machines construites furent basées sur le système décimal, plus difficile à implanter.

Premières machines programmables

Résumé

Contexte

La principale marque d'un ordinateur est sa programmabilité. Celle-ci permet à l'ordinateur d'émuler toute autre machine à calculer en changeant la séquence des instructions disponibles.

Métier à tisser

En 1725, Basile Bouchon, un Lyonnais, met au point le premier système de programmation d'un métier à tisser grâce à un ruban perforé[7]. En 1728, Jean-Baptiste Falcon, son assistant, remplace le ruban par une série de cartes perforées reliées entre elles. Jacques Vaucanson (1709-1782) reprend cette idée en remplaçant ruban et cartes perforées par un cylindre métallique et enfin Joseph Marie Jacquard (1752-1834) lie le tout dans son métier à tisser qui fut adopté dans le monde entier et qui démontra qu'une machine pouvait être minutieuse, constante et dépendante.

« Sans reprendre l'histoire de Jacquard et entrer dans le vif des discussions interminables, lui attribuant ou lui enlevant le mérite de cette innovation, nous adopterons l'avis généralement partagé et que nous croyons sincère, que c'est Jacquard qui eut l'idée de réunir : les aiguilles et les crochets de Basil Bouchon, les cartons enlacés de Falcon et de remplacer le cylindre rond de Vaucanson par un parallélépipède improprement encore appelé de nos jours cylindre carré. De plus, il arma son cylindre d'une lanterne, ceci est incontestablement le fait personnel de Jacquard »

— C. Razy, Étude analytique des petits modèles de métiers exposés au musée historique des tissus, 1913

Machine à calculer programmable

En 1834, Charles Babbage, passionné par le métier Jacquard, propose une machine mécanique à calculer, très évoluée, « la machine analytique»[8][source insuffisante].

La machine qu'il conçoit « devait permettre de résoudre n'importe quelle équation et d'exécuter les opérations les plus compliquées de l'analyse mathématique. » C'est un calculateur mécanique programmable, fonctionnant à la vapeur, qui utilise des cartes perforées pour ses données et ses instructions[9]. Bien que la théorie et le projet technique de Babbage aient été remarquablement pensés, bien qu'il en ait confié la réalisation à un atelier capable de produire les pièces mécaniques de la précision voulue, et bien qu'il ait été soutenu au début par l'Académie des sciences britannique, Babbage finit par lasser son constructeur comme ses financeurs, par son arrogance et ses changements de plans successifs : la construction de cette machine analytique, pas plus que les précédentes, n'aboutit.

Charles Babbage avait une collaboratrice, la mathématicienne Ada Lovelace, comtesse et fille du poète britannique Lord Byron. Elle conçoit un programme destiné à cette machine, faisant figure rétrospectivement de « première programmeuse du monde ». De plus[8][source insuffisante], elle pointe que les « diagrammes » ou « programmes » établis pour faire fonctionner la machine analytique constituent un capital immatériel mais réel de connaissances. Elle montre également que la machine peut résoudre des équations algébriques ou manipuler des nombres imaginaires.

Évolution des machines à calculer

En 1885, les calculateurs sont dotés de claviers qui facilitent l'entrée des données. Par la suite, l'électricité permet de motoriser les calculateurs mécaniques et de remplacer certains mécanismes (comme les manivelles) par de l'électromécanique.

Remove ads

Essor de l'informatique

Résumé

Contexte

Fin du XIXe siècle

Le recensement de la population des États-Unis de 1880 prend sept ans (précisément sept ans deux mois et treize jours) à analyser. Un appel d'offres pour un système d'analyse plus rapide est lancé avant le recensement de 1890. Des trois offres soumises, c'est la solution d'Herman Hollerith qui est choisie, car elle utilise des cartes perforées qui la rendent deux fois plus rapide que les deux autres, qui utilisent un système de cartes de couleur. Herman Hollerith travaille pour le bureau du recensement de 1890 à 1894, puis en 1896, il crée The Tabulating Machine company qui sera une des trois compagnies dont la fusion est à l'origine d'IBM[10]. Herman Hollerith utilise pour les statistiques le principe de la carte perforée, rendu populaire par le métier à tisser de Jacquard[11].

Début du XXe siècle

À la faveur de l'augmentation de portée considérable des pièces d'artillerie embarquées, des calculateurs d'un type nouveau se développent dans la marine de guerre britannique : les systèmes de conduite de tir, qui permettent de centraliser le feu contre un bâtiment ennemi en mouvement. Ils constituent l'association d'un système d'acquisition (le gyroscope) et d'un système de calcul (l’analyseur différentiel). Le report des résultats d'impacts sur une carte, d'abord manuel, devient électrique, et donne naissance aux premiers pupitres de tir (pupitre Dumaresq, pupitre Dreyer, pupitre Admiralty) au début de la Seconde Guerre mondiale[12]. L'officier russe Alexeï Krylov aurait réalisé des systèmes de ce type dans les années 1910[13].

Fredrik Rosing Bull dépose le 31 juillet 1919 un brevet pour une « trieuse-enregistreuse-additionneuse combinée à cartes perforées », qui donnera naissance à une gamme de matériel concurrente d'IBM.

Le survol du XXe siècle permet d'avancer plusieurs raisons à l'essor fulgurant de l'informatique :

- les progrès dans la réflexion sur les fondements de la logique et des mathématiques,

- les progrès de l'électronique,

- la mobilisation de moyens militaro-industriels au moment de la Seconde Guerre mondiale dépasse l'ambition des programmes nationaux habituels d'aide au développement.

Remove ads

Calculateurs analogiques

Avant la Seconde Guerre mondiale, les ordinateurs analogiques, qu'ils soient mécaniques ou électriques, sont considérés comme le dernier cri de la technologie et beaucoup pensent qu'ils seront le futur de l'informatique. Ces ordinateurs analogiques utilisent des quantités physiques, telles que la tension, le courant ou la vitesse de rotation des axes, pour représenter les nombres. Ainsi, ils doivent être reprogrammés manuellement à chaque nouveau problème. Leur avantage par rapport aux premiers ordinateurs numériques est leur capacité à traiter des problèmes plus complexes, au moyen d'une certaine forme de parallélisme.

Les calculateurs stochastiques, où la grandeur physique est remplacée par une probabilité, paraissent sur le moment être l'avenir du calculateur analogique. Ils sont en effet bon marché, faciles à produire en masse et rapides (en particulier pour les multiplications). Mais les ordinateurs numériques, plus faciles encore à programmer, remplacent ces ordinateurs analogiques.

Remove ads

Première génération d'ordinateurs (1936-1956)

Résumé

Contexte

En 1936, la publication d'un article de logique mathématique de Turing, On Computable Numbers, with an Application to the Entscheidungsproblem[14], constitue, avec d'autres recherches fondamentales menées notamment par A. Church et K. Gödel, un cadre théorique qui intéressera plus tard les fondateurs de la science informatique. Mais il n'a guère d'influence sur la conception des premiers calculateurs programmables. La machine de Turing est une abstraction modélisant un « être calculant » pour démontrer une proposition de logique pure et n'a rien à voir avec un projet de machine.

L'ère des ordinateurs modernes commence avec les grands développements de la Seconde Guerre mondiale. Les circuits électroniques, tubes à vide, condensateurs et relais remplacent leurs équivalents mécaniques et le calcul numérique remplace le calcul analogique. Les ordinateurs conçus à cette époque forment la première génération d'ordinateurs.

Vers 1954, les mémoires magnétiques (tores de ferrite pour la mémoire vive, bandes, ensuite disques amovibles puis fixes pour la mémoire de masse) supplantent toute autre forme de stockage et sont dominantes au milieu des années 1960.

De nombreuses machines électromécaniques sont construites avec des capacités diverses. Elles n'ont qu'un impact limité sur les constructions à venir.

Premiers calculateurs programmables

En 1938, Konrad Zuse commence la construction des premières séries-Z, des calculateurs électromécaniques comportant une mémoire et une programmation limitée. Zuse est soutenu par la Wehrmacht, qui utilise ces systèmes pour des missiles guidés. Le Z1 (ou Versuchsmodell) ne fonctionne jamais vraiment correctement,mais donne à son inventeur l'expérience nécessaire pour développer d'autres modèles, désormais avec l'appui de l'industrie et de l'armée. Les séries-Z sont les précurseurs de nombreuses avancées technologiques telles que l'arithmétique binaire et les nombres en virgule flottante.

Durant la même période, en 1938, John Vincent Atanasoff et Clifford E. Berry, de l'université de l'État de l'Iowa, développent l'ordinateur Atanasoff-Berry, un additionneur à 16 bits. Cette machine a pour but de résoudre des systèmes d'équations linéaires. La mémoire est stockée à l'aide de condensateurs fixés à un tambour rotatif.

En novembre 1939, John Vincent Atanasoff et Clifford E. Berry achèvent l'ABC (Atanasoff Berry Computer). Composé de lampes et de tambours pour la mémoire, il est construit pour résoudre des systèmes d'équations linéaires. Bien que n'étant pas programmable, il repose sur trois idées propres aux ordinateurs modernes :

- l'utilisation du système binaire (plus fiable et plus simple à mettre au point que le système décimal) ;

- la séparation entre le calcul et la mémoire ;

- l'utilisation de composants électroniques plutôt que des éléments mécaniques pour réaliser les calculs.

Il peut stocker 60 mots de 50 bits dans ses deux tambours, fonctionne à une vitesse d'horloge de 60 Hz et réalise 30 additions par seconde[15]. Cette petite machine expérimentale ne sera jamais opérationnelle et ses auteurs se tournent vers d'autres sujets.

En 1940, aux Bell Laboratories, George Stibitz (en) et Samuel Williams achèvent le Complex Number Calculator (ou Model I), un calculateur à base de relais téléphoniques, et la première machine contrôlée à distance, via une ligne de téléphone, qui permet de réaliser une multiplication en une minute.

En 1941, Konrad Zuse construit le Z3 utilisant 2 600 relais de téléphone, lit les programmes sur bandes magnétiques et fonctionne parfaitement, ce qui en fait le premier calculateur programmable fonctionnel. Il utilise l'arithmétique binaire et les nombres à virgule flottante. Le Z3 peut enregistrer 64 nombres de 22 bits, a une fréquence de 5,33 Hz et réalise quatre additions par seconde ou 15 multiplications par minute. A posteriori, il sera déterminé qu'il est Turing-complet, bien que rien n'indique qu'il ait été conçu pour cela (très peu de spécialistes du calcul ont entendu parler d'Alan Turing à l'époque).

En 1944, le Harvard Mark I (ou l'ASCC, Automatic Sequence Controlled Calculator) est mis au point par Howard Aiken chez IBM. C'est une machine de calcul décimal qui lit les programmes depuis une bande de papier. Elle pèse cinq tonnes et occupe une place de 37 mètres carrés. Elle est composée de plusieurs calculateurs qui travaillent en parallèle et réalise trois opérations sur 23 chiffres par seconde.

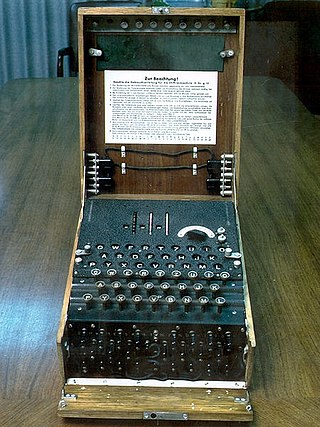

Pendant la Seconde Guerre mondiale, le Royaume-Uni fait de grands efforts à Bletchley Park pour déchiffrer les codes des communications militaires allemands. Le principal système de chiffrement allemand, Enigma (et ses différentes variantes), est attaqué avec l'aide de machines appelées bombes, créées par les services secrets polonais et améliorées par les Britanniques, qui permettent de trouver les clés de chiffrement après que d'autres techniques en ont réduit le nombre possible. Les Allemands créent également une autre série de systèmes de chiffrement (appelés FISH par les Britanniques) très différents d'Enigma. Pour casser ces systèmes, le professeur Max Newman et ses collègues développent Colossus. Il n'est pas Turing-complet. À la fin de la guerre, du fait de leur importance stratégique, la plupart des exemplaires sont détruits, le reste continuant à servir dans le plus grand secret.

En 1945, le Z4 de Konrad Zuse est achevé : l’ETH de Zurich[16] (de 1950 à 1955) puis l’Institut franco-allemand de recherches de Saint-Louis louent cette machine.

Colossus est la première machine totalement électronique, elle utilise uniquement des tubes à vide et non des relais. Elle en compte 2 000 et lit des rubans perforés à la vitesse de 5 000 caractères par seconde. Colossus implémente les branchements conditionnels. Neuf machines sont construites sur le modèle Mk II ainsi qu'une dixième lorsque la seule Mk I est convertie en Mk II. L'existence de cette machine est tenue secrète jusque dans les années 1970, ce qui explique pourquoi de nombreuses histoires de l'informatique n'en font pas mention. Winston Churchill aurait personnellement donné l'ordre de leur destruction en pièces de moins de vingt centimètres pour conserver le secret. Une copie de cette machine est reconstituée en 1994-1995 et fonctionne, aujourd'hui exposée au musée historique de Bletchley Park.

Premiers ordinateurs

En septembre 1945, Presper Eckert et John William Mauchly achevèrent l'ENIAC (Electronic Numerical Integrator and Computer), gros calculateur Turing-complet entièrement électronique. Il avait été commandé en 1943 par l'armée américaine afin d'effectuer les calculs de balistique. L'ENIAC utilisait des tubes à vide (au nombre de 17 468) et faisait ses calculs en système décimal. Malgré la véhémence de ses détracteurs qui auguraient de sa fragilité (celles des tubes à vide), il était très fiable pour l'époque et pouvait calculer plusieurs heures entre deux pannes. La machine est également célèbre pour ses dimensions physiques imposantes : elle pesait plus de 30 tonnes, occupait 167 m2 et consommait une puissance de 160 kW. Elle fonctionnait à 100 kHz, était composée de 20 calculateurs fonctionnant en parallèle et pouvait effectuer 100 000 additions ou 357 multiplications par seconde.

À partir de 1948 apparurent les premières machines à architecture de von Neumann : contrairement à toutes les machines précédentes, les programmes étaient stockés dans la même mémoire que les données et pouvaient ainsi être manipulés comme des données. La première machine utilisant cette architecture était le Small-Scale Experimental Machine (SSEM) construit à l'université de Manchester la même année.

Le SSEM fut suivi en 1949 par le Manchester Mark I qui inaugura un nouveau type de mémoire composée de tubes cathodiques. La machine était programmée avec le programme stocké en mémoire dans un tube cathodique et les résultats étaient lus sur un deuxième tube cathodique.

Parallèlement, l'université de Cambridge développa l'EDSAC, inspiré des plans de l'EDVAC, le successeur de l'ENIAC. Contrairement à l'ENIAC qui utilisait le calcul en parallèle, l'EDVAC et l'EDSAC possédaient une seule unité de calcul. Il utilisait un type de mémoire différent du Manchester Mark I, constitué de lignes à retard de mercure. L'EDSAC fonctionnait à une vitesse d'horloge de 0,5 MHz.

On peut considérer que l'architecture de tous les ordinateurs actuels dérive de celle de Manchester Mark I / EDSAC / EDVAC,[réf. nécessaire] ils sont dits de type von Neumann.

En 1950 naquit le premier ordinateur soviétique, le MESM (МЭСМ en russe, abréviation de Malaïa Elektronnaïa tchetnaïa Machina, « petit calculateur électronique »), sous la direction de Sergueï Lebedev à l'Institut d'électrotechnologie de Kiev. Il était composé de 6 000 tubes à vide, consommait 25 kW et réalisait 3 000 flops[17].

En février 1951, le premier modèle de Ferranti Mark I, version commerciale du Manchester Mark I et premier ordinateur commercial de l'histoire, est vendu[18]. Il s'en vendra neuf jusqu'en 1957.

Quatre mois plus tard, P. Eckert et J. Mauchly de Remington Rand commercialisèrent l'UNIVAC I (Universal Automatic Computer). Contrairement aux machines précédentes, il ne lisait pas des cartes perforées mais des cassettes métalliques. Il possédait 5 200 tubes à vide, avait une mémoire à lignes à retard de mercure de 1 000 mots de 72 bits et consommait 125 kW. Il exécutait 8 333 additions ou 555 multiplications par seconde. 46 exemplaires furent vendus au total, à plus d'un million de dollars l'unité.

En avril 1952, IBM produit son premier ordinateur scientifique, l'IBM 701, pour la défense américaine. L'IBM 701 utilisait une mémoire à tubes cathodiques (tubes de William) de 2 048 mots de 36 bits. Il effectuait 16 000 additions ou 2 200 multiplications par seconde. 19 machines seront installées au total. La même année, IBM est contacté pour mettre en chantier la production des ordinateurs du réseau SAGE. Une cinquantaine de machines, portant le nom AN/FSQ7, sera produite. Chaque machine comportait 75 000 tubes, pesait 275 tonnes et consommait 750 kW.

Toujours en 1952, la Compagnie des Machines Bull sorti le Gamma 3, qui connu un fort succès en Europe avec plus de 1200 unités produites[19]. Le Gamma 3 fût le premier ordinateur produit à plus de 1000 exemplaires, et possédait des attributs innovants pour l'époque, notamment une ALU bi-mode BCD et binaire commutée logiciellement, ainsi qu'une bibliothèque virgule flottante câblée, pour le calcul scientifique.

Dans sa configuration E.T, le Gamma 3 possédait une mémoire tambour permettant d'enregistrer 50,000 instructions réparties dans 16 384 mots de 48 bits, une large capacité pour l'époque[19].

En juillet 1953, IBM lance l'IBM 650, ordinateur commercial (ou de gestion). Réalisé à partir de tubes à vide, l'IBM 650 avait une mémoire à tambour de 2 000 mots de dix chiffres décimaux, mais il était relativement lent. Il se présentait en deux modules de 2,5 m3, l'un de 900 kg contenant l'ordinateur, l'autre de 1 350 kg contenant son alimentation électrique. Il coûtait 500 000 $ ou pouvait être loué 3 500 $ par mois. Environ 2 000 unités furent produites jusqu'en 1962.

En 1954, la Société d'électronique et d'automatisme (SEA) livre son premier ordinateur, CAB 1011, au service français du Chiffre. D'autres suivront : CUBA pour le Laboratoire central de l'Armement, CAB 2000 et 3000.

En avril 1955, IBM lance l'IBM 704, ordinateur scientifique (son pendant commercial sera le 705) capable aussi de calculer sur des nombres à virgule flottante. L'architecture du 704 a été significativement améliorée par rapport au 701. Il utilisait une mémoire à tores de ferrite de 32 768 mots de 36 bits, bien plus fiable et plus rapide que les tubes cathodiques et les autres systèmes utilisés jusqu'alors. D'après IBM, le 704 pouvait exécuter 40 000 instructions par seconde. 123 machines seront vendues jusqu'en 1960.

Remove ads

Deuxième génération (1957-1965)

Résumé

Contexte

La deuxième génération d'ordinateurs est basée sur l'invention du transistor en 1947. Cela permit de remplacer le fragile et encombrant tube électronique par un composant plus petit et fiable. Les ordinateurs composés de transistors sont considérés comme la deuxième génération et ont dominé l'informatique dans la fin des années 1950 et le début des années 1960. Toutefois la notion de « génération », qui est à l'origine un argument commercial, est contestée par les historiens : elle ne tient compte que des technologies de l'unité logique, non des mémoires, de l'architecture ou de la programmation.

En 1955, Maurice Wilkes inventa la microprogrammation, désormais universellement utilisée dans la conception des processeurs. Le jeu d'instructions du processeur est défini par ce type de programmation.

En 1956, IBM sortit le premier système à base de disque dur, le Ramac 305 (Random Access Method of Accounting and Control). L'IBM 350 utilisait 50 disques de 24 pouces en métal, avec 100 pistes par face. Il pouvait enregistrer cinq mégaoctets de données et coûtait 10 000 $ par mégaoctet.

Le premier langage de programmation universel de haut niveau à être implémenté, le Fortran (mathematical FORmula TRANslating system), fut aussi développé chez IBM sur la période 1954-1957 par l'équipe de John Backus, prix Turing 1977 (le Plankalkül, langage de haut niveau développé par Konrad Zuse en 1945 n'avait pas encore été implémenté à cette époque).

En 1958, la Compagnie des Machines Bull (France) annonce Le Gamma 60, livré en une quinzaine d'exemplaires à partir de 1960 : Premier ordinateur multitâches dans le monde et l'un des premiers à comporter plusieurs processeurs (voir multiprocesseur), cet ordinateur transistorisé présente cependant de graves défauts de conception, typiques d'une machine expérimentale. Comme la plupart des ordinateurs de son temps, il comporte diverses unités d'entrée et de sortie : bandes magnétiques, lecteurs de cartes, perforateurs de cartes, imprimantes, lecteurs de bande papier, perforateurs de bande papier.

En 1959, IBM lança l'IBM 1401 (commercial), qui utilisait des cartes perforées. Il fut le premier ordinateur vendu à plus de 10 000 exemplaires. Il utilisait une mémoire magnétique de 4 000 caractères (étendue plus tard à 16 000 caractères).

En 1960, IBM lança l'IBM 1620 (scientifique). Il écrivait à l'origine sur des rubans perforés, mais évolua rapidement pour utiliser des lecteurs de cartes perforées comme le 1442. 2 000 unités furent vendues. Il utilisait une mémoire magnétique de 60 000 caractères décimaux. Un exemplaire opérationnel fut longtemps présent au Palais de la découverte.

La même année, Digital Equipment Corporation (DEC) lança le PDP-1 (Programmed Data Processor). Le PDP-1 était le premier ordinateur interactif et a lancé le concept de mini-ordinateur. Il avait une vitesse d'horloge de 0,2 MHz et pouvait stocker 4 096 mots de 18 bits. Il effectuait 100 000 opérations par seconde. Vendu pour seulement 120 000 $ environ, il était l'un des premiers ordinateurs accessibles sur le simple budget d'un (gros) service sans remonter à la direction générale.

En 1960, la Société d'électronique et d'automatisme (SEA) commercialise la CAB500[20], véritable ordinateur personnel. Ses caractéristiques – interactivité, souplesse d'emploi, compacité et faible prix – la différencient des mainframes de l'époque. Le travail de l'utilisateur est facilité par le langage Programmation automatique des formules (PAF), qui traduit les fonctions explicites en langage machine. Plus d'une centaine d'exemplaires sont commercialisés, notamment dans les universités ou les écoles d'ingénieurs, et contribuent à former la première génération d'informaticiens français[21].

En 1960, la société française Serel sort le modèle OA-1001[22], une machine en 18 bits +signe +parité, 4 000 mots, 100 kHz, purement binaire dédiée au contrôle de processus ou aux calculs scientifiques[réf. nécessaire]. Elle est bientôt suivie par une version plus petite le Serel ODP-505, trois fois plus rapide.

Remove ads

Troisième génération (1963-1971)

Résumé

Contexte

Premiers ordinateurs à circuits intégrés

La troisième génération d'ordinateurs est celle des ordinateurs à circuit intégré qui ont été inventés par Jack Kilby en 1958. C'est à partir de cette date que l'utilisation de l'informatique a explosé.

Les premiers ordinateurs utilisant les circuits intégrés sont apparus en 1963. L'un de leurs premiers usages a été dans les systèmes embarqués, notamment par la NASA dans l'ordinateur de guidage d'Apollo et par les militaires dans le missile balistique intercontinental LGM-30. Le circuit intégré autorise alors le développement d'ordinateurs plus compacts que l'on appelle les mini-ordinateurs.

En 1964, IBM annonça la série 360, première gamme d'ordinateurs compatibles entre eux et première gamme aussi à couvrir l'ensemble des domaines d'applications commerciales et scientifiques. Plus de 14 000 ordinateurs IBM 360 furent vendus jusqu'en 1970, date où on les remplaça par la série 370 beaucoup moins chère à puissance égale (mémoires bipolaires à la place des mémoires à tores magnétiques).

En 1965, DEC lance le PDP-8, machine bien moins encombrante destinée aux laboratoires et à la recherche. Avec une mémoire de 4 096 mots de 12 bits fonctionnant à 1 MHz il pouvait effectuer 100 000 opérations par seconde. Le PDP-8 se taille rapidement une place de choix dans les laboratoires, aidé par son langage FOCAL facile à maîtriser.

En 1966, Hewlett-Packard entre dans le domaine des mini-ordinateurs « universels »[23] avec son HP-2116[24] fonctionnant avec une mémoire 16 bits à tores. Celui-ci supportait de nombreux langages, dont l'Algol et le Fortran[24], « comme les grands », et le BASIC y sera adjoint plus tard.

En 1966, le gouvernement français lance le Plan Calcul destiné à assurer l'indépendance du pays en matière d'ordinateurs.

En 1969, Data General vend 50 000 ordinateurs Nova à 8 000 $ l'unité. Le Nova était dans les premiers mini-ordinateurs 16 bits. La version Supernova qui lui succédera en 1971 effectuait une multiplication en une microseconde. Le processeur principal était contenu sur un circuit imprimé de 15 pouces. Dans le même temps, grâce à une politique de mise en commun gratuite de logiciels particulièrement innovateurs (et vue aujourd'hui comme l'ancêtre de l'open source), l'IBM 1130 est plebiscité par les écoles d'ingénieurs du monde entier.[réf. nécessaire]

À la même époque, Phillips (marque hollandaise de produits grand public) lance une série d'ordinateurs du type « 360 » pour concurrencer IBM. Ils sont plus rapides et largement aussi fiables (c'est-à-dire assez peu), mais comme ils utilisent un système d'exploitation spécifique, ils disparaissent rapidement du marché. Siemens et Digital Equipment tentent de supplanter IBM sur ce créneau du « 360 » mais sans grand succès. Seuls Control-Data et Cray réussissent à rivaliser avec les haut de gamme d'IBM dans les années 1970-1980.

« Mini-ordinateurs », à partir de 1972

Le mini-ordinateur est une innovation des années 1970, qui devient significative vers la fin de celles-ci. Il apporte la puissance de l'ordinateur à des structures décentralisées, non seulement grâce à un encombrement plus commode, mais également en élargissant le nombre de constructeurs d'ordinateurs.

En 1972, le réseau Cyclades français est développé à l'IRIA avec le soutien de la Délégation à l'informatique, dans le cadre du Plan Calcul. Parallèlement, la CII présente sa distributed system architecture. Ces réseaux numériques permettent de partager les ressources informatiques des centres universitaires et de grandes organisations comme EDF ou le Commissariat à l'énergie atomique : on commence à parler de calcul distribué. À partir de là, la conception du grand système est concurrencée par les mini-ordinateurs en réseau, comme le DEC PDP-8, le Mitra 15 puis le Mini 6. Aux États-Unis, IBM et DEC créent les architectures SNA et DECnet, en profitant de la numérisation du réseau d'AT&T (voir Réseau téléphonique commuté)[25].

En 1972, Hewlett-Packard lance le HP 3000, mini-ordinateur de gestion fonctionnant en multi-tâches temps réel et multi-utilisateur[26], suivi en 1974 d'ordinateurs techniques et de contrôle de processus multi-tâches temps réel la série 21MX[27].

L'intégration de circuits intégrés à grande échelle conduisit au développement de processeurs très petits, comme celui qui analyse les données de vol dans les avions F14A Tomcat de l'US Navy. On ignorait alors encore que l'explosion à distance d'une charge nucléaire les rendrait instantanément inopérants (effet EMP).

En 1973, le TV Typewriter de Don Lancaster permit le premier d'afficher des informations alphanumériques sur une télévision ordinaire. Il était composé de 120 $ de composants électroniques, incluait deux cartes mémoires et pouvait générer et stocker 512 caractères. Une cassette optionnelle fournissait une capacité de 100 pages de textes supplémentaires. Clive Sinclair se basera plus tard sur cette approche pour construire son Sinclair ZX80.

Dans les années 1970, IBM a sorti une série de mini-ordinateurs, la série 3 : 3/6, 3/8, 3/10, 3/12, 3/15. Ensuite, dans les années 1980, la série 30 : 32, 34, 36, 38. Une troisième série a succédé à la série 30 : les AS/400. La première version du système d'exploitation n'était qu'une évolution de celui du 38. Le but était de ne conserver qu'un seul système d'exploitation pour l'ensemble de la gamme mini. Il était capable d'émuler les 34 et les 36.

Dans les années 1980, DEC devint le deuxième fabricant d'ordinateurs derrière IBM (avec un chiffre d'affaires représentant le cinquième de celui-ci) grâce à ses ordinateurs populaires PDP (surtout le PDP-11 (1970-1993), première machine de DEC à utiliser des mémoires de 16 bits et non de 12, et machine sur laquelle et pour laquelle fut développé le langage C) et VAX, qui apportera le confort du système VMS.

Remove ads

Quatrième génération (1971 à la fin des années 1980)

Résumé

Contexte

Une définition non universellement acceptée associe le terme de quatrième génération à l'invention du microprocesseur par Marcian Hoff et Federico Faggin (physicien et inventeur italien, spécialisé en physique du solide). En pratique et à la différence des autres changements de génération, celle-ci constitua plus une évolution (presque passée inaperçue) qu'une révolution : les circuits s'étaient miniaturisés de plus en plus depuis l'invention du circuit intégré.

C'est pour cette raison que certains considèrent que les générations sont devenues des questions de type de logiciel :

- première génération : codage machine direct en binaire ;

- deuxième génération : langage assembleur ;

- troisième génération : langages évolués (Fortran, COBOL, Simula, APL, etc.) ;

- quatrième génération : langages évolués de deuxième génération comme Pascal et C++, dit « structurés », apparition des langages « Objets » et langages d'interrogation de très haut niveau comme SQL ;

- un projet de cinquième génération japonaise avait été lancé par le MITI au tout début des années 1980. Il devait être articulé sur les moteurs d'inférence et le langage Prolog, mais en dépit de budgets importants le projet n'aboutit pas.

On peut aussi considérer que la notion de « générations » est un concept marketing, lancé en 1964 par IBM, et n'a aucun intérêt historique : il ne tient compte ni des technologies de mémoire (tambours magnétiques, tores de ferrite…), ni des périphériques, ni de l'évolution du logiciel. Surtout, il n'explique rien de la logique de développement de ces techniques[28]. Aujourd'hui, on peut considérer que l'immense majorité des ordinateurs relèvent toujours de la « 4e génération », qui serait donc à elle seule plus longue que les trois précédentes !

Microprocesseurs

Le 15 novembre 1971, Intel dévoile le premier microprocesseur commercial, le 4004[29]. Il a été développé pour Busicom, un constructeur japonais. Un microprocesseur regroupe la plupart des composants de calcul (horloge et mémoire mises à part pour des raisons techniques) sur un seul circuit. Couplé à un autre produit, la puce mémoire, le microprocesseur permet une diminution nouvelle des coûts. Le 4004 ne réalisait que 60 000 opérations par seconde, mais la puissance de ses successeurs répondit à la loi de Moore.

Super-calculateurs

Les superordinateurs intégrèrent aussi souvent des microprocesseurs.

En 1976, le Cray-1 fut développé par Seymour Cray, qui avait quitté Control Data en 1972 pour créer sa propre société. C'était l'un des premiers ordinateurs à mettre en pratique le traitement vectoriel, qui appliquait la même instruction à une série consécutive d'opérandes (évitant ainsi des coûts de décodage répétés). Le Cray-1 pouvait calculer 150 millions d'opérations à virgule flottante par seconde. 85 exemplaires furent vendus à cinq millions de dollars l'unité.

Parmi ses clients en France : l'École polytechnique (simulations et calculs numériques) ; Michelin (étude de résistance des pneumatiques par la méthode des éléments finis) ; Peugeot (simulations intensives de déformations de l'habitacle d'une voiture en cas de choc frontal ou latéral).

En 2010, la hiérarchie s'est modifiée[30] avec l'arrivée des constructeurs asiatiques et surtout chinois :

- no 1 : le TIANHE-1A du Centre national de calcul intensif de Tianjin (chine) avec une puissance de 2,57 petaflops

- no 2 : le CRAY JAGUAR du département américain de l'Énergie (puissance de 1,75 petaflops)

- no 3 : le NEBULAE, installé au National Supercomputing Centre de Shenzen (Chine) avec une puissance de 1,27 petaflops

- no 4 : le TSUBAME, de l'Institut Technologique de Tokyo (Japon) avec une puissance de 1,19 petaflops)

Le TERA-100 (construit par le fabricant français Bull pour le Commissariat à l'énergie atomique est classé en première position en Europe et sixième en position mondiale (puissance de 1,05 petaflops)

Contrôleurs de communication

Eux aussi bénéficièrent de l'usage des microprocesseurs et l'on peut même dire que la généralisation des réseaux informatiques n'a été possible que par l'invention des microprocesseurs. Les contrôleurs 3745 (IBM) utilisaient intensivement cette technologie. Dans le même temps, aux États-Unis, la compagnie AT&T se rendit compte qu'avec tous ses standards téléphoniques interconnectés, elle se trouvait sans l'avoir cherché disposer du plus grand réseau d'ordinateurs des États-Unis (un standard téléphonique, depuis l'invention des microprocesseurs, tient beaucoup plus de l'ordinateur que du dispositif câblé, et nombre d'entre eux se commandent en UNIX).

Ordinateur personnel

En janvier 1973 est présenté le premier micro-ordinateur, le Micral conçu par François Gernelle de la société R2E dirigée par André Truong Trong Thi. Basé sur le microprocesseur 8 bits Intel 8008, ses performances en font le plus petit ordinateur moderne de l'époque (500 kHz, mémoire vive de 8 ko en version de base), correspondant à son prix : 8 500 francs. La machine a été développée pour un laboratoire d'agronomie qui ne pouvait s'offrir un mini-ordinateur DEC PDP-8. Elle est rapidement mise en production industrielle, annoncée dans la presse professionnelle française et américaine, présentée au Sicob et vendue pour équiper des installations chimiques ou des péages d'autoroute. De nouvelles versions seront développées ensuite, au total une vingtaine de machines multi-utilisateurs, parfois multiprocesseurs, sous systèmes d'exploitation temps réel Prologue et CP/M. Le succès nécessitant de nouveaux capitaux, R2E passe sous le contrôle de Bull à partir de 1978. En 1982, la conversion de Bull à la compatibilité IBM provoque le départ de l'ancienne équipe R2E, qui fonde de nouvelles entreprises de micro-informatique.

Au Sicob 1973 est également apparu un micro-ordinateur allemand. Le DIEHL Alphatronic utilise lui aussi le microprocesseur Intel 8008. Il comprend une unité centrale équipée d'un Intel 8008 (4 ko extensible à 16 ko), d'un lecteur enregistreur de mini-cassette magnétique et d'une imprimante à boule IBM. Il ne comportait pas d'écran. La programmation en mini-basic était visualisée sur une mini imprimante (bande papier en rouleau). Prix de vente de l'ensemble 4 573 €.

Présenté en avril 1974, le processeur Intel 8080 conduit à la première vague d'ordinateurs personnels, à la fin des années 1970. La plupart d'entre eux utilisait le bus S-100 et le système d'exploitation CP/M-80 de Digital Research. CP/M-80 était le premier système d'exploitation à être utilisé par plusieurs fabricants d'ordinateurs différents, et de nombreux logiciels furent développés pour lui. Le système MS-DOS de Microsoft, acheté par Microsoft à Tim Paterson de la société Seattle Computer Products (qu'il avait appelé QDOS pour Quick and Dirty Operating System) s'en inspira fortement (en inversant l'ordre de certains opérandes pour ne pas encourir de procès, ce qui provoqua quelques catastrophes chez ceux qui utilisaient les deux systèmes).

En janvier 1975, sort l'Altair 8800. Développé par des amateurs, frustrés par la faible puissance et le peu de flexibilité des quelques ordinateurs en kit existant sur le marché à l'époque, c'est certainement le premier ordinateur personnel en kit produit en masse. Il est le premier ordinateur à utiliser un processeur Intel 8080. L'Altair inaugura le bus S-100. C'est un énorme succès et 10 000 unités sont vendues. L'Altair inspire le développement de logiciels à Bill Gates et Paul Allen, qui développent un interpréteur BASIC pour cette machine.

En 1975 sort aussi l'IBM 5100, machine totalement intégrée avec son clavier et son écran, qui se contente d'une prise de courant pour fonctionner.

Toujours en 1975, le fabricant de terminaux programmables TRW se rend compte que son terminal Datapoint 2200 à disquettes (de huit pouces) est un ordinateur si on l'équipe d'un langage évolué (BASIC) et d'un système d'exploitation (CP/M), et commence à le commercialiser comme tel, en inventant le premier réseau local pour micros : ARCnet. Ce système, commercialisé en France par Matra, ne sera cependant jamais proposé au grand public.

De nombreux amateurs tentent à cette époque de créer leurs propres systèmes. Ces passionnés se rencontrent lors de réunions au Homebrew Computer Club, où ils montrent leurs réalisations, comparent leurs systèmes et échangent des plans ou des logiciels. Certains de ces amateurs s'intéressent à construire quelque chose de prêt à l'emploi que Monsieur tout le monde puisse s'offrir.

En 1976, Steve Wozniak, qui fréquentait régulièrement le Homebrew Computer Club, conçoit l'Apple I, doté d'un processeur MOS Technologie 6502 à 1 MHz. Il vend avec Steve Jobs environ 200 machines à 666 $ l'unité. Il est doté d'un microprocesseur et d'un clavier.

En 1977 sort l'Apple II. Malgré son prix élevé (environ 1 000 $), il prend rapidement l'avantage sur les deux autres machines lancées la même année, le TRS-80 et le Commodore PET, pour devenir le symbole du phénomène de l'ordinateur personnel. D'une très grande qualité, l'Apple II a de gros avantages techniques sur ses concurrents : il dispose d'une architecture ouverte, d'un lecteur de disquettes, et utilise des graphismes en couleur. Grâce à l'Apple II, Apple domine l'industrie de l'ordinateur personnel entre 1977 et 1983. Plus de deux millions d'Apple II sont vendus.

En 1978, devant le succès de l'Apple II, IBM décide de renouer avec le marché de l'ordinateur personnel (le marché avait trouvé le 5100 trop lent, le 5110 trop lourd physiquement et le System 23 Datamaster – créé pour faire pendant au TRW-2200 – n'avait pas bénéficié d'un support marketing suffisant à l'époque). Frank Cary confie une équipe, un budget et donne carte blanche à Don Estridge.

En août 1981 sort l'IBM PC (Personnal Computer), qui utilise un processeur Intel 8088 à 4,77 MHz et peut fonctionner avec deux systèmes d'exploitation différents : PC-DOS et CP/M-86. L'UCSD p-System sera également utilisable, mais non supporté par IBM. Microsoft s'est réservé, contre réduction de la facture à IBM, le droit de commercialiser sa propre version du PC-DOS pour d'autres ordinateurs de marque non-IBM, qui sera nommée le MS-DOS. Cela permettra à Microsoft de prendre de plus en plus de place dans les logiciels pour PC, jusqu'à évincer IBM.

L'ordinateur le plus vendu de tous les temps est le Commodore 64[31], dévoilé par Commodore International en . Il utilise un processeur MOS Technology 6510 à 1 MHz et coûte 595 $. Il avait un écran 16 couleurs et possédait un bon générateur de son programmable, le SID. Entre 17 et 25 millions d'unités sont vendues jusqu'en 1993.

À cette époque apparaissent les premiers « clones » compatibles, comme le Franklin 1000 compatible avec l'Apple II et le premier compatible PC lancé par Compaq en . Cette concurrence sur le marché des ordinateurs personnels permet de faire baisser les prix et de rendre ces machines populaires.

En 1982, Intel lance l'Intel 80286, utilisé par IBM en 1984 dans le PC/AT. À cette époque le PC devient l'architecture dominante sur le marché des ordinateurs personnels.

En 1983, Apple lance le Lisa, le premier ordinateur personnel doté d'une interface graphique. Le Lisa utilisait un processeur Motorola 68000, un disque dur de 5 Mo, deux lecteurs de disquette et 1 Mo de RAM. Son interface graphique s'inspirait de celle du Xerox Star. Malgré son caractère révolutionnaire pour l'époque, ce fut un échec commercial, principalement à cause de son prix élevé (10 000 $) et de sa relative lenteur.

Le , Apple lance le Macintosh, le premier micro-ordinateur à succès utilisant une souris et une interface graphique. Il reprenait plusieurs caractéristiques du Lisa, comme le processeur Motorola 68000, mais pour un prix bien plus abordable : 2 500 $, grâce à l'abandon de quelques fonctionnalités du Lisa comme le multitâche. Il était fourni avec plusieurs applications utilisant la souris, comme MacPaint et MacWrite.

En 1985 apparaissent deux autres gammes d'ordinateurs utilisant une souris et une interface graphique en couleurs : l'Atari ST, qui connait un grand succès dans le monde musical en raison de la présence d'une interface MIDI, et le Commodore Amiga, dont les capacités sonores et d'animation graphique permettront la programmation de jeux vidéo de qualité supérieure sur ordinateur personnel jusque dans les années 1990.

Atari et Commodore disparaissent dans la première moitié des années 1990. Apple perd peu à peu des parts de marché pour se stabiliser à environ 4 % des ventes d'ordinateurs dans les années 2000. Ce, malgré le succès de l'iMac, premier ordinateur conçu par des designers, qui s'écoule à plus de six millions d'exemplaires. Apple reste cependant le seul fabricant proposant une gamme d'ordinateurs grand public ne faisant pas partie des compatibles PC. Parallèlement, le compatible PC s'impose progressivement au grand public, à travers des assembleurs tels Hewlett-Packard, Compaq, Dell et NEC.

Remove ads

Années 1990

Résumé

Contexte

Les années 1990 ont été marquées par la préparation à la correction du problème de l'an 2000 (ou « bug de l'an 2000 », appelé Y2K dans le monde anglophone), qui affectait de nombreux logiciels, système d'exploitation compris, qui, pour cause de place mémoire disponible, codaient les dates avec deux chiffres (par exemple 99 pour 1999), de sorte qu'au passage à l'an 2000, le codage des dates allait revenir à 00 et être interprétées comme l'année 1900[32].

La résolution de ce problème s'est faite soit par la conversion des logiciels, sans changement du matériel, soit aussi par le remplacement complet du matériel et du logiciel, en profitant des progrès techniques de diminution de taille des ordinateurs rendus possibles par la miniaturisation des composants (downsizing). Cela a permis de remplacer les logiciels spécifiques affectés par le problème, par des logiciels ou des progiciels le plus souvent sous Unix avec des ordinateurs de taille réduite.

Cette décennie a aussi été marquée par l'ouverture d'Internet au commerce, fin 1992, puis par l'expansion du World Wide Web. La convergence de l'informatique, d'Internet et des télécommunications est décrite par une nouvelle expression, les « technologies de l'information et de la communication » (TIC), ou « techniques de l'information et de la communication » selon la DGLFLF[33]. Leur expansion a entraîné une énorme bulle spéculative sur les sociétés d'informatique. Avec Internet s'ouvre surtout un nouveau chapitre, non seulement de l'histoire de l'informatique, mais aussi de l'économie mondiale : numérisation de l'économie (biens et services), délocalisation, « uberisation », ces termes expriment à la fois des bouleversements de l'économie et des inquiétudes socio-politiques[34].

Ordi-phones

Avec les progrès de la miniaturisation, le premier « smartphone », l'IBM Simon, fut conçu en 1992 puis commercialisé en août 1994. Ensuite se sont développés les PDA (Personal Digital Assistants), comme le Psion ou le Palm Pilot et surtout le Blackberry, qui combinaient les fonctions d'agenda électronique, de bloc-note, de téléphone et de terminal Internet. Le terme PDA a été ensuite remplacé par smartphone.

En 2014, La 4G est présente dans plusieurs dizaines de pays dont la France[35].

Les principaux fabricants de téléphones de l'époque[Laquelle ?] se lancent dans l'aventure (comme Nokia, le leader à cette époque, LG ou Samsung), ainsi que de nouvelles sociétés spécialisées dans les smartphones (comme Research In Motion avec le BlackBerry). L'OS de référence est alors Symbian utilisé principalement par Nokia et Ericsson. Ces constructeurs européens seront ensuite balayés par la concurrence chinoise, coréenne et américaine.

Arts et littérature

Les années 1971 à 1975, marquées par de nouvelles générations d'ordinateurs et par les prémices d'Internet, avec en particulier le développement des réseaux d'ordinateurs en France et aux Etats-Unis, comme Arpanet et le Réseau Cyclades, dans un contexte technologique marqué une très forte innovation, en particulier dans la mise en réseau des ordinateurs, est évoquée sur le ton de l'humour et de l'enquête dans Comédies Françaises, un roman d’Eric Reinhardt publié en 2020, qui évoque l'arrêt du Réseau Cyclades, promu par le Plan Calcul français, basé sur une technologie de Datagramme à la base des premiers développements d'Internet.

Le roman raconte, sous le prisme de l'enquête d'un jeune journaliste de l'AFP, âgé de 27 ans, comment Ambroise Roux patron de la CGE a fait jour un lobbying réussi pour convaincre le président de la République français Valéry Giscard d'Estaing de mettre fin en 1974-1975 au Plan Calcul, au consortium européen Unidata, à la Délégation Générale à l'Informatique, et au Réseau Cyclades.

Notes et références

Voir aussi

Wikiwand - on

Seamless Wikipedia browsing. On steroids.

Remove ads