資訊熵

From Wikipedia, the free encyclopedia

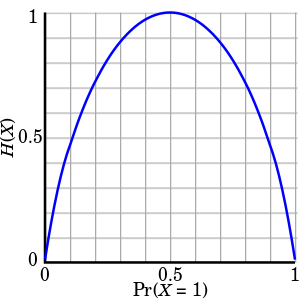

資訊熵(粵拼:zi1 seon3 soeng1 | 英文:information entropy)係資訊理論(研究資訊嘅數學理論)上嘅核心概念。同物理學上所講嘅熵唔同,資訊論當中嘅「熵」係一個指標,用嚟量度一個有隨機性喺入面嘅變數或者過程當中帶有幾多不確定性喺入面[1]。

舉個例說明,想像家吓掟一個銀仔同擲一粒骰仔,假設個銀仔同粒骰仔係冇出千嘅,前者有 50% 機會率係公、50% 機會率係字,而後者有 1/6 機會係擲到「1」、1/6 機會係擲到「2」... 如此類推,即係話[註 1]:

- 掟銀仔(

表示掟銀仔結果;0 代表公、1 代表字):

- 擲骰仔(

表示擲到嘅數字):

後者嘅情況有更加高嘅資訊熵-後者當中有更多嘅可能性喺度,所以不確定性亦都更加大。亦都因為噉,「話俾人知掟銀仔嘅結果」所俾嘅資訊少過「話俾人知擲骰仔嘅結果」所俾嘅,因為喺後者情況當中,「提供資訊」所消除嘅資訊熵更加多。就係噉,資訊論做到將「資訊」呢一個概念量化,令到資訊成為一個喺科學上可以被研究嘅對象[1][2]。

以下嘅內容係建基於概率論嘅基礎概念嘅。