Loading AI tools

sensore di immagine Da Wikipedia, l'enciclopedia libera

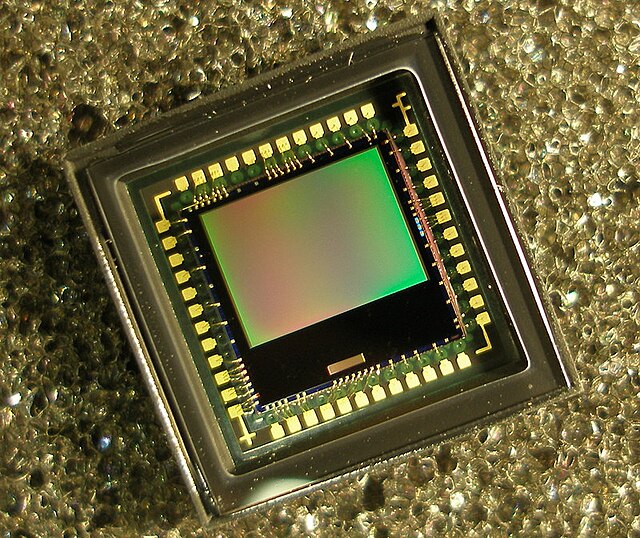

Un sensore a pixel attivi (in inglese active-pixel sensor - APS) è un tipo di sensore di immagini (o sensore digitale) in cui ogni singola cella dell'unità, detta pixel, è composta da un fotorivelatore (tipicamente un fotodiodo bloccato) e da uno o più transistor attivi.[1][2] In un sensore a pixel attivi di tipo MOS (metallo-ossido-semiconduttore), i transistor a effetto di campo (MOSFET) vengono utilizzati come amplificatori. Esistono diversi tipi di APS, tra cui il primo APS NMOS e il molto più comune APS MOS complementare (CMOS), noto anche come sensore CMOS, che è ampiamente utilizzato nelle tecnologie delle fotocamere digitali come le fotocamere dei cellulari, le webcam, le più moderne fotocamere digitali tascabili, la maggior parte delle fotocamere reflex digitali a lente singola (DSLR) e fotocamere mirrorless a obiettivo intercambiabile (EVIL o MILC). I sensori CMOS sono emersi come alternativa ai sensori di immagine basati su dispositivo ad accoppiamento di carica (CCD), superandoli a livello di mercato a metà degli anni 2000.

Il termine "sensore di pixel attivo" viene utilizzato anche per riferirsi al singolo sensore di pixel stesso, contrariamente al sensore di immagine.[3][4][5]

Durante la ricerca sulla tecnologia MOS (metallo-ossido-semiconduzione), Willard Boyle e George Elwood Smith scoprirono che una carica elettrica poteva essere immagazzinata in un piccolo condensatore MOS: esso divenne l'elemento costitutivo di base del dispositivo ad accoppiamento di carica (CCD), che inventarono nel 1969.[6][7] Un problema con la tecnologia CCD era che richiedeva la necessità di un trasferimento di carica quasi perfetto, che, secondo Eric Fossum, "rende la loro radiazione 'morbida', difficile da usare in condizioni di scarsa illuminazione, difficile da produrre in array di grandi dimensioni, difficile da integrare con l'elettronica su chip, difficile da usare a basse temperature, difficile da usare a frame rate elevati e difficile da produrre in materiali non siliconici che estendano la risposta in lunghezza d'onda".[1]

Presso gli RCA Laboratories, un gruppo di ricerca composto da Paul K. Weimer, WS Pike e G. Sadasiv nel 1969 propose un sensore di immagine a stato solido con circuiti di scansione che utilizzavano transistor a film sottile (TFT), con pellicola fotoconduttiva utilizzata per il fotorilevatore.[8][9] Nel 1981, Richard F. Lyon diede dimostrazione di un imager MOSFET a canale N (NMOS) a bassa risoluzione "per lo più digitale" con amplificazione intra-pixel, per un'applicazione con mouse ottico.[10] Un altro tipo di tecnologia del sensore di immagine correlato all'APS è la matrice di piano focale infrarosso (IRFPA),[1] progettata per funzionare a temperature criogeniche nello spettro infrarosso. I dispositivi sono due chip che vengono messi insieme come un sandwich: un chip contiene elementi rilevatori realizzati in InGaAs o HgCdTe, mentre l'altro chip è tipicamente realizzato in silicio e viene utilizzato per leggere i fotorilevatori. Un elemento chiave del moderno sensore CMOS è il fotodiodo appuntato (PPD).[2] Fu inventato da Nobukazu Teranishi, Hiromitsu Shiraki e Yasuo Ishihara alla NEC nel 1980[11] e poi pubblicamente riportato da Teranishi e Ishihara con A. Kohono, E. Oda e K. Arai nel 1982, con l'aggiunta di una struttura anti-blooming.[12] Il fotodiodo appuntato è una struttura fotorivelatore a basso ritardo, a basso rumore, alta efficienza quantica e bassa corrente scura. La nuova struttura del fotorilevatore inventata al NEC ha ricevuto il nome di "fotodiodo appuntato" (PPD) da B.C. Burkey alla Kodak nel 1984. Nel 1987, il PPD iniziò ad essere incorporato nella maggior parte dei sensori CCD, diventando un dispositivo fisso nelle videocamere elettroniche di consumo e poi nelle fotocamere digitali. Da allora, il PPD è stato utilizzato in quasi tutti i sensori CCD e quindi nei sensori CMOS.

Il precursore dell'APS era il sensore a pixel passivi (PPS), un tipo di matrice di fotodiodi (PDA). Un sensore a pixel passivi è costituito da pixel che vengono letti senza amplificazione, con ogni pixel costituito da un fotodiodo e un interruttore MOSFET.[13] In una matrice di fotodiodi, i pixel contengono una giunzione p-n, un condensatore integrato e dei MOSFET come transistor di selezione. Una matrice di fotodiodi fu proposta da G. Weckler nel 1968, antecedentemente al CCD.[1] Questa fu la base per il PPS,[2] che aveva elementi di sensori di immagine con transistor di selezione in pixel, proposto da Peter J.W. Noble nel 1968[8][14] e da Savvas G. Chamberlain nel 1969.[15]

Il sensore a pixel passivi MOS utilizzava solo un semplice interruttore nel pixel per leggere la carica integrata del fotodiodo.[16] I pixel erano disposti in una struttura bidimensionale, con un filo di abilitazione all'accesso condiviso dai pixel nella stessa riga e un filo di uscita condiviso per colonna. Alla fine di ogni colonna c'era un transistor. I primi array di fotodiodi erano complessi e poco pratici, richiedendo la fabbricazione di transistor di selezione all'interno di ciascun pixel, insieme a circuiti multiplexer su chip. Il rumore degli array di fotodiodi era un limite alle prestazioni, poiché la capacità del bus di lettura dei fotodiodi determinava un aumento del livello di rumore. Anche il doppio campionamento correlato (CDS) non può essere utilizzato con un array di fotodiodi senza memoria esterna. Negli anni '70 non era possibile fabbricare sensori di pixel attivi con una dimensione pixel pratica, a causa delle limitate tecnologie di microlitografia dell'epoca.[1]

Il sensore a pixel attivi è costituito da pixel attivi, ciascuno contenente uno o più amplificatori MOSFET che convertono la carica foto-generata in una tensione, amplificano la tensione del segnale e riducono il rumore.[13] Il concetto di un dispositivo a pixel attivi è stato proposto da Peter Noble nel 1968.[14][17]

Il concetto di pixel attivi MOS venne implementato come dispositivo di modulazione di carica (CMD) da Olympus in Giappone durante la metà degli anni '80. Ciò fu reso possibile dai progressi nella fabbricazione dei dispositivi a semiconduttore MOSFET, con il ridimensionamento dei MOSFET che raggiunse livelli più piccoli del micron, quindi del sotto micron tra gli anni '80 e i primi anni '90.[1][18] Il primo MOS APS fu fabbricato dal team di Tsutomu Nakamura alla Olympus nel 1985. Il termine sensore di pixel attivi (APS) fu coniato da Nakamura mentre lavorava al sensore CMD active-pixel alla Olympus.[19] L'imager CMD aveva una struttura APS verticale, che aumentava il fattore di riempimento (o riduceva le dimensioni dei pixel), memorizzando la carica del segnale in un transistor NMOS di uscita. Altre società giapponesi di semiconduttori seguirono presto con i propri sensori di pixel attivi tra la fine degli anni '80 e l'inizio degli anni '90. Tra il 1988 e il 1991, Toshiba sviluppò il sensore "double-gate floating surface transistor", che aveva una struttura APS laterale, con ogni pixel contenente un photogate MOS a canale nascosto e un amplificatore di uscita PMOS. Tra il 1989 e il 1992, Canon sviluppò il base-stored image sensor (BASIS), che utilizzava una struttura APS verticale simile al sensore Olympus, ma con transistor bipolari anziché MOSFET.[1]

All'inizio degli anni '90, le aziende americane hanno iniziato a sviluppare pratici sensori di pixel attivi MOS. Nel 1991, Texas Instruments sviluppò il sensore CMD di massa (BCMD), che venne fabbricato presso la filiale giapponese dell'azienda e aveva una struttura APS verticale simile al sensore CMD Olympus, ma era più complesso e utilizzava PMOS piuttosto che transistor NMOS.[2]

Dalla fine degli anni '80 all'inizio degli anni '90, il processo CMOS era ben consolidato come un processo di produzione di semiconduttori stabile ben controllato, oltre ad essere il processo di base per quasi tutti i microprocessori e la logica. C'è stata una recrudescenza nell'uso di sensori a pixel passivi per applicazioni di imaging di fascia bassa,[20] mentre i sensori a pixel attivi hanno iniziato a essere utilizzati per applicazioni a bassa risoluzione ad alte prestazioni come la simulazione della retina[21] e i rivelatori di particelle ad alta energia. Tuttavia, i CCD continuavano ad avere un rumore temporale molto più basso e un rumore a schema fisso ed erano di conseguenza la tecnologia dominante nelle applicazioni di consumo come i camcorder e le telecamere di trasmissione, dove stavano sostituendo i tubi da ripresa.

Nel 1993, venne sviluppato presso il Jet Propulsion Laboratory (JPL) della NASA il primo APS concreto prodotto al di fuori del Giappone, compatibile con CMOS, il cui sviluppo fu guidato da Eric Fossum. Aveva una struttura APS laterale simile al sensore Toshiba, ma fabbricata con transistor CMOS anziché PMOS.[1] Fu il primo sensore CMOS con trasferimento di carica intra-pixel,[2] legato a un amplificatore in-pixel per ottenere un vero e proprio doppio campionamento correlato (CDS) e un funzionamento a basso rumore temporale, e circuiti on-chip per la riduzione del rumore a schema fisso.

Fossum ha anche pubblicato un ampio articolo del 1993 che prevede l'emergere di imager APS come successori commerciali dei CCD.[1] Il documento ha dato ampio spazio alla definizione del sensore a pixel attivi (APS). Fossum ha classificato due tipi di strutture APS, l'APS laterale e l'APS verticale. Ha anche fornito una panoramica della storia della tecnologia APS, dai primi sensori APS giapponesi allo sviluppo del sensore CMOS al JPL.

Nel 1994 Fossum propose un miglioramento al sensore CMOS: l'integrazione del fotodiodo appuntato (PPD). Un sensore CMOS con tecnologia PPD fu fabbricato per la prima volta nel 1995 da un team congiunto del JPL e di Kodak che includeva Fossum insieme a P. P. K. Lee, R. C. Gee, R. M. Guidash e T. H. Lee.[2] Tra il 1993 e il 1995, il Jet Propulsion Laboratory sviluppò una serie di prototipi di dispositivi, che hanno convalidato le caratteristiche chiave della tecnologia. Sebbene primitivi, questi dispositivi dimostrarono una buona qualità dell'immagine con un'elevata velocità di lettura e un basso consumo energetico.

Nel 1995, frustrati dal ritmo lento dell'adozione della tecnologia, Fossum e la sua moglie di allora, la dott.ssa Sabrina Kemeny co-fondarono Photobit Corporation per spingere la commercializzazione della tecnologia.[17] Continuò a sviluppare e commercializzare la tecnologia APS per una serie di applicazioni, come web cam, fotocamere ad alta velocità e motion capture, radiografia digitale, fotocamere per endoscopia (pillola), fotocamere reflex digitali a lente singola (DSLR) e telefoni cellulari. Molte altre piccole aziende del settore sono nate poco dopo grazie all'accessibilità del processo CMOS e tutte hanno adottato rapidamente l'approccio del sensore a pixel attivi.

I sensori CMOS di Photobit hanno trovato la loro strada nelle webcam prodotte da Logitech e Intel, prima che Photobit fosse acquistata da Micron Technology nel 2001. Le prime fasi del mercato dei sensori CMOS vedevano inizialmente alla guida produttori americani come Micron e Omnivision, il che consentì agli Stati Uniti di riconquistare brevemente una parte del mercato complessivo dei sensori di immagine dal Giappone, prima che il mercato dei sensori CMOS finisse per essere dominato a loro volta dallo stesso Giappone, dalla Corea del Sud e dalla Cina.[22] Il sensore CMOS con tecnologia PPD è stato ulteriormente perfezionato da R. M. Guidash nel 1997, K. Yonemoto e H. Sumi nel 2000 e I. Inoue nel 2003. Ciò ha portato i sensori CMOS a ottenere prestazioni di imaging alla pari con i sensori CCD e successivamente a superare i sensori CCD.[2]

Dal 2000, i sensori CMOS sono stati utilizzati in una gran varietà di applicazioni, tra cui telecamere a basso costo, telecamere per PC, fax, multimedia, sicurezza, sorveglianza e videotelefonia.[23]

L'industria video è passata alle telecamere CMOS con l'avvento del video ad alta definizione (video HD), in quanto l'elevato numero di pixel richiederebbe un consumo energetico significativamente maggiore con i sensori CCD, che surriscalderebbe e consumerebbe le batterie.[22] Sony nel 2007 commercializzò sensori CMOS con un originale circuito di conversione A/D a colonna, per prestazioni rapide e silenziose, seguiti nel 2009 dal sensore CMOS retroilluminato (sensore BI), con una sensibilità doppia rispetto ai sensori di immagine convenzionali che va oltre l'occhio umano.[24]

I sensori CMOS hanno continuato ad avere un impatto culturale significativo, portando alla proliferazione di massa di fotocamere digitali e cellulari con fotocamera, che ha sostenuto l'ascesa dei social media e della cultura dei selfie e ha influenzato i movimenti sociali e politici in tutto il mondo.[22] Nel 2007, le vendite di sensori CMOS a pixel attivi avevano superato i sensori CCD, con i sensori CMOS che rappresentavano il 54% del mercato globale dei sensori di immagine dell'epoca. Al 2012, i sensori CMOS hanno aumentato la loro quota al 74% del mercato. A partire dal 2017, i sensori CMOS rappresentano l'89% delle vendite globali di sensori di immagine.[25] Negli ultimi anni, la tecnologia del sensore CMOS si è estesa alla fotografia di medio formato e Phase One è stata la prima a lanciare un dorso digitale di medio formato con un sensore CMOS prodotto da Sony.

Nel 2012, Sony introdusse il sensore CMOS BI in pila,[24] mentre Fossum eseguiva ricerche sulla tecnologia Quanta Image Sensor (QIS).[26] Il QIS venne inventato a Dartmouth e introdusse un importante cambiamento nelle metodologie di cattura delle immagini in una fotocamera. Nel QIS, l'obiettivo è contare ogni fotone che colpisce il sensore di immagine e fornire una risoluzione di 1 miliardo o più fotoelementi specializzati (chiamati jots) per sensore e leggere i piani di bit jot centinaia o migliaia di volte al secondo risultando in terabit/sec di dati.[27]

Boyd Fowler di OmniVision è noto per il suo lavoro nello sviluppo di sensori di immagine CMOS. I suoi contributi includono il primo sensore di immagine CMOS a pixel digitali del 1994; il primo sensore di immagine CMOS lineare scientifico con rumore di lettura RMS a singolo elettrone nel 2003; il primo sensore di immagine CMOS per aree scientifiche multi-megapixel con gamma dinamica elevata simultanea (86 dB), lettura rapida (100 fotogrammi/secondo) e rumore di lettura estremamente basso (1,2e-RMS) (sCMOS) nel 2010. Ha anche brevettato[28] il primo sensore di immagine CMOS per radiografie dentali interorali con angoli ritagliati per un migliore comfort del paziente.[29]

Alla fine degli anni 2010 i sensori CMOS avevano in gran parte se non completamente sostituito i sensori CCD, poiché i sensori CMOS non solo possono essere realizzati nelle linee di produzione di semiconduttori esistenti, riducendo i costi, ma consumano anche meno energia, solo per citare alcuni vantaggi. (vedi sotto)

I pixel APS risolvono i problemi di velocità e scalabilità dei sensori di pixel passivi. Generalmente consumano meno energia rispetto ai CCD, hanno meno ritardo nell'immagine e richiedono strutture di produzione meno specializzate. A differenza dei CCD, i sensori APS possono combinare la funzione del sensore di immagine e le funzioni di elaborazione delle immagini all'interno dello stesso circuito integrato. I sensori APS hanno trovato spazio nel mercato in molte applicazioni di consumo, in particolare nei telefoni con fotocamera. Sono stati utilizzati anche in altri campi, tra cui la radiografia digitale, l'acquisizione di immagini in campo militare ad altissima velocità, le telecamere di sicurezza e i mouse ottici . I produttori includono, tra gli altri, Aptina Imaging (spinout indipendente da Micron Technology, che ha acquistato Photobit nel 2001), Canon, Samsung, STMicroelectronics, Toshiba, OmniVision Technologies, Sony e Foveon. I sensori APS di tipo CMOS sono generalmente adatti ad applicazioni in cui sono importanti il packaging, la gestione dell'alimentazione e l'elaborazione su chip. I sensori di tipo CMOS sono ampiamente utilizzati, dalla fotografia digitale di fascia alta fino alle fotocamere dei telefoni cellulari.

Un vantaggio importante di un sensore CMOS è generalmente il costo di produzione inferiore rispetto a un sensore CCD, poiché gli elementi di acquisizione e rilevamento delle immagini possono essere combinati sullo stesso CI, richiedendo una costruzione più semplice.[30]

Un sensore CMOS in genere ha anche un migliore controllo del blooming (cioè della dispersione di carica fotografica da un pixel sovraesposto ad altri pixel vicini).

Nei sistemi di telecamere a tre sensori che utilizzano sensori separati per rilevare le componenti rossa, verde e blu dell'immagine insieme ai prismi divisori del fascio, i tre sensori CMOS possono essere identici, mentre la maggior parte dei prismi separatori richiede che uno dei sensori CCD debba essere un'immagine speculare delle altre due per leggere l'immagine in un ordine compatibile. A differenza dei sensori CCD, i sensori CMOS hanno la capacità di invertire l'indirizzamento degli elementi del sensore. Esistono sensori CMOS con una velocità di pellicola di ISO 4 milioni.[31]

Poiché un sensore CMOS in genere cattura una riga alla volta entro circa 1/60 o 1/50 di secondo (a seconda della frequenza di aggiornamento), si potrebbe creare un effetto rolling shutter, in cui l'immagine risulta distorta (inclinata a sinistra o destra, a seconda della direzione della fotocamera o del movimento del soggetto). Ad esempio, quando si rileva un'auto che si muove ad alta velocità, l'auto non sarà distorta ma lo sfondo sembrerà inclinato. Un sensore CCD frame-transfer o un sensore CMOS "global shutter" non presenta questo problema; cattura infatti l'intera immagine in una volta in un archivio di frame.

Un vantaggio durevole dei sensori CCD è stato la loro capacità di acquisire immagini con un rumore inferiore.[32] Con i miglioramenti nella tecnologia CMOS, questo vantaggio si è chiuso a partire dal 2020, con i moderni sensori CMOS disponibili in grado di superare in performance i sensori CCD.[33]

La circuiteria attiva nei pixel CMOS occupa un'area della superficie che non è sensibile alla luce, riducendo l'efficienza del dispositivo nel rilevamento dei fotoni (i sensori retroilluminati possono mitigare questo problema). Tuttavia il CCD frame-transfer ha circa la metà dell'area non sensibile per i nodi del frame store, quindi i vantaggi relativi dipendono dai tipi di sensori che vengono confrontati.

Il pixel APS CMOS standard oggi è costituito da un fotorivelatore (fotodiodo appuntato),[2] una diffusione floating e la cosiddetta cella 4T costituita da quattro transistor CMOS, tra cui un gate di trasferimento, un gate di azzeramento, un gate di selezione e un transistor di lettura source-follower.[34] Il fotodiodo appuntato era originariamente utilizzato nei CCD a trasferimento interlinea data la sua bassa corrente scura e la buona risposta del blu; quando accoppiato con il gate di trasferimento, consente il trasferimento completo della carica dal fotodiodo appuntato alla diffusione flottante (che è ulteriormente collegata al gate del transistor di lettura) eliminando il ritardo. L'uso del trasferimento di carica intrapixel restituisce un rumore inferiore, consentendo l'uso del doppio campionamento correlato (CDS). Il pixel Noble 3T è ancora utilizzato in alcuni casi, poiché i requisiti di fabbricazione sono meno complessi. Il pixel 3T comprende gli stessi elementi del pixel 4T, ad eccezione del gate di trasferimento e del fotodiodo. Il transistor di reset, Mrst, funge da interruttore per ripristinare la diffusione flottante su VRST, che in questo caso è rappresentato come il gate del transistor Msf. Quando il transistor di ripristino è acceso, il fotodiodo è effettivamente collegato all'alimentazione, VRST, azzerando tutta la carica integrata. Poiché il transistor di ripristino è di tipo n, il pixel opera in soft reset. Il transistor di lettura, Msf, funge da buffer (nello specifico, un source follower), un amplificatore che consente di osservare la tensione dei pixel senza rimuovere la carica accumulata. La sua alimentazione, VDD, è tipicamente collegata all'alimentazione del transistor di reset RS . Il transistor di selezione, sel, consente la lettura di una singola riga della matrice di pixel da parte dell'elettronica di lettura. Esistono anche altre innovazioni dei pixel come i pixel 5T e 6T. Aggiungendo ulteriori transistor, si possono ottenere funzioni come l'otturatore globale, al contrario del più comune rolling shutter. Per aumentare le densità dei pixel, è possibile utilizzare la lettura condivisa shared-row, a quattro vie, a otto vie e altre architetture. Una variante del pixel attivo 3T è il sensore Foveon X3 inventato da Dick Merrill. In questo dispositivo, sono impilati tre fotodiodi uno sopra l'altro grazie all'utilizzo di tecniche di fabbricazione planare, con ogni fotodiodo avente un proprio circuito 3T. Ogni livello successivo agisce da filtro per il livello sottostante spostando lo spettro della luce assorbita negli strati successivi. Decostituendo la risposta di ogni rivelatore stratificato, è possibile ricostruire i segnali rosso, verde e blu.

Una tipica matrice bidimensionale di pixel è organizzata in righe e colonne. I pixel in una determinata riga condividono le linee di reset, in modo che ad ogni impulso venga ripristinata un'intera riga alla volta. Anche le linee di selezione di ogni pixel in una riga sono legate insieme. Gli output di ogni pixel in una determinata colonna sono collegati tra loro. Poiché viene selezionata solo una riga alla volta, non si verifica alcuna competizione per la linea di output. Ulteriori circuiti di amplificazione sono tipicamente su una base di colonna.

La dimensione del sensore pixel è spesso data in altezza e larghezza, ma anche in formato ottico.

Esistono due tipi di strutture di sensori a pixel attivi (APS), l'APS laterale e l'APS verticale.[1] Eric Fossum definisce l'APS laterale come segue:

«Una struttura APS laterale è definita come quella che ha una parte dell'area pixel utilizzata per la fotorilevazione e l'archiviazione del segnale e l'altra parte per i transistor attivi. Il vantaggio di questo approccio, rispetto a un APS integrato verticalmente, è che il processo di fabbricazione è più semplice ed è altamente compatibile con i processi dei dispositivi CMOS e CCD all'avanguardia.»

Fossum definisce l'APS verticale come segue:

«Una struttura APS verticale aumenta il fattore di riempimento (o riduce la dimensione dei pixel) memorizzando la carica del segnale sotto il transistor di uscita.»

Per applicazioni come l'imaging digitale a raggi X di grandi dimensioni, possono essere utilizzati nell'architettura APS anche i transistor a film sottile (TFT). Tuttavia, a causa delle dimensioni maggiori e del guadagno di transconduttanza inferiore dei TFT rispetto ai transistor CMOS, è necessario disporre di un numero inferiore di TFT su pixel per mantenere la risoluzione e la qualità dell'immagine a un livello accettabile. Un'architettura APS / PPS a due transistor ha dimostrato di essere promettente per gli APS utilizzando TFT in silicio amorfo. Nell'architettura APS a due transistor a destra, TAMP viene utilizzato come amplificatore commutato che integra le funzioni di Msf e Msel nell'APS a tre transistor. Ciò si traduce in una riduzione del numero di transistor per pixel, nonché in un aumento del guadagno di transconduttanza dei pixel.[35] Cpix è la capacità di memorizzazione dei pixel ed è anche usata per accoppiare capacitivamente l'impulso di indirizzamento del "Read" al gate di TAMP per la commutazione ON-OFF. Questi circuiti di lettura dei pixel funzionano meglio con rivelatori fotoconduttori a bassa capacità come il selenio amorfo.

Seamless Wikipedia browsing. On steroids.

Every time you click a link to Wikipedia, Wiktionary or Wikiquote in your browser's search results, it will show the modern Wikiwand interface.

Wikiwand extension is a five stars, simple, with minimum permission required to keep your browsing private, safe and transparent.