Loading AI tools

La théorie des perturbations est un domaine des mathématiques, qui consiste à étudier les contextes où il est possible de trouver une solution approchée à une équation en partant de la solution d'un problème plus simple. Plus précisément, on cherche une solution approchée à une équation (Eλ) (dépendante d'un paramètre λ), sachant que la solution de l'équation (E0) (correspondant à la valeur λ=0) est connue exactement. L'équation mathématique (Eλ) peut être par exemple une équation algébrique ou une équation différentielle. La méthode consiste à chercher la solution approchée de l'équation (Eλ) sous la forme d'un développement en série des puissances du paramètre λ, cette solution approchée étant supposée être une approximation d'autant meilleure de la solution exacte, mais inconnue, que la valeur absolue du paramètre λ est plus « petite ».

Histoire

Dès le début du XVIIIe siècle, la théorie des perturbations a été utilisée par les astronomes pour les besoins de la mécanique céleste : en effet, les équations différentielles décrivant un système de N corps en interaction gravitationnelle n'a pas de solution exacte générale[1] pour N ≥ 3. Cet aspect de la théorie des perturbations a été synthétisé à la fin du XIXe siècle dans les ouvrages classiques de Laplace[2], Tisserand[3] et Poincaré[4], avant de connaître de nouveaux développements dans la seconde moitié du XXe siècle avec l'avènement en 1954 de la « théorie KAM », du nom de ses trois concepteurs : Kolmogorov, Arnold et Moser.

La méthode a par ailleurs été abondamment utilisée au XXe siècle pour les besoins de la physique quantique, d'abord en mécanique quantique non relativiste, puis en théorie quantique des champs perturbative.

Convergence de la série perturbative ?

On a vu qu'on cherchait ici la solution approchée de l'équation (Eλ) sous la forme d'un développement en série des puissances du paramètre λ ; la question de la convergence de cette série se pose alors. Ce problème a été réglé pour l'astronomie par Poincaré en 1892 : la « série » de perturbation doit être comprise mathématiquement comme un développement asymptotique au voisinage de zéro, et non comme une série ordinaire convergente uniformément. Le chapitre VIII de la Mécanique céleste de Poincaré[5] commence par le commentaire suivant :

« II y a entre les géomètres et les astronomes une sorte de malentendu au sujet de la signification du mot convergence. Les géomètres préoccupés de la parfaite rigueur et souvent trop indifférents à la longueur de calculs inextricables dont ils conçoivent la possibilité, sans songer à les entreprendre effectivement, disent qu'une série est convergente quand la somme des termes tend vers une limite déterminée, quand même les premiers termes diminueraient très lentement. Les astronomes, au contraire, ont coutume de dire qu'une série converge quand les 20 premiers termes, par exemple, diminuent très rapidement, quand même les termes suivants devraient croître indéfiniment.

Ainsi, pour prendre un exemple simple, considérons les deux séries qui ont pour terme général :

Les géomètres diront que la première converge, et même qu'elle converge rapidement, parce que le millionième terme est beaucoup plus petit que le 999999e ; mais ils regarderont la seconde comme divergente, parce que le terme général peut croître au-delà de toute limite.

Les astronomes, au contraire, regarderont la première série comme divergente, parce que les 1000 premiers termes vont en croissant ; et la seconde comme convergente, parce que les 1000 premiers termes vont en décroissant et que cette décroissance est d'abord très rapide.

Les deux règles sont légitimes : la première, dans les recherches théoriques ; la seconde, dans les applications numériques. Toutes deux doivent régner, mais dans deux domaines séparés et dont il importe de bien connaître les frontières. »

Pour conclure cette discussion qualitative sur la convergence, le mathématicien Jean-Pierre Ramis précise[6] :

« On peut ainsi parler de séries convergentes « au sens des géomètres » ou « au sens des astronomes ». Notons que pratiquement, dans les applications, on constate que, presque toujours, les séries convergentes au sens des astronomes ont un terme général qui croît très vite après avoir d'abord diminué. Ainsi, ce que Poincaré envisageait comme possibilité est en fait la règle. »

C'est d'ailleurs ce qui fait l'efficacité pratique de la théorie des perturbations en physique théorique : il suffit le plus souvent de calculer les quelques premiers termes du développement asymptotique - ceux qui semblent commencer par converger - pour obtenir une très bonne approximation du résultat exact inconnu. Ainsi, dans le cadre de l'électrodynamique quantique, Dyson a montré en 1948 que la série perturbative était divergente, alors que la prise en compte des trois ou quatre premiers termes seulement donnent des prédictions théoriques en accord remarquable avec les résultats expérimentaux.

Notons qu'il existe certaines procédures de « sommation » qui permettent de donner un sens à certaines séries divergentes, comme par exemple la sommation de Borel ou l'approximant de Padé.

Position du problème

Considérons à titre d'exemple l'équation différentielle d'ordre un suivante :

Dans cette équation, t représente le temps, τ un paramètre fixé homogène à un temps, L0 un paramètre fixé homogène à une longueur, et λ le paramètre de perturbation, sans dimensions. On cherche à déterminer la fonction x(t) inconnue, homogène à une longueur, et vérifiant la condition initiale : à l'instant t = 0, on a : x(0)=X0.

Théorie des perturbations au premier ordre

Le problème de départ de la théorie des perturbations est l'équation différentielle (E0) correspondant à la valeur λ=0 :

dont la solution analytique exacte est bien connue :

où A est une constante, pour l'instant inconnue. On illustre la méthode de perturbations en nous limitant pour simplifier au premier ordre dans le développement en série des puissances du paramètre λ ; on cherche donc la solution approchée sous la forme :

où x1(t) est une fonction inconnue, à déterminer. On injecte cette expression dans l'équation différentielle exacte (Eλ). En se limitant aux termes du premier ordre inclus et en utilisant le fait que x0(t) est la solution exacte de (E0), on obtient la solution physique approchée au premier ordre :

Comparaison avec la solution exacte

On peut démontrer ici que l'équation différentielle (Eλ) vérifiant la condition initiale : x(0)=X0 admet pour toutes les valeurs du paramètre λ la solution exacte suivante :

Un développement limité de cette expression au premier ordre en λ donne explicitement la solution approchée déterminée au paragraphe précédent par la théorie des perturbations au premier ordre :

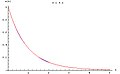

Pour visualiser l'écart entre la solution approchée et la solution exacte, on trace ci-dessous les graphes des deux fonctions pour une série de valeurs de λ allant de 0,1 à 0,5, en prenant : X0=L0= 1 m, τ = 1 s.

- en bleu, la solution exacte.

- en rouge, la solution approchée au premier ordre.

- λ=0,1

- λ=0,2

- λ=0,3

- λ=0,4

- λ=0,5

Définition et propriétés

Définition

L'oscillateur de Duffing satisfait à l'équation différentielle du second ordre suivante :

Dans cette équation, t représente le temps, ω0 un paramètre fixé homogène à une pulsation, c’est-à-dire l'inverse d'un temps. L0 est un paramètre fixé homogène à une longueur, et λ le paramètre de perturbation, sans dimensions. On cherche à déterminer la fonction x(t) inconnue, homogène à une longueur, et vérifiant les conditions initiales : à l'instant t=0, on a : x(0)=X0 et .

Interprétation physique

On peut interpréter cette équation différentielle comme la loi de la dynamique de Newton d'une particule de masse m soumise à une force dérivant d'une énergie potentielle V(x) :

où le potentiel V(x) quartique s'écrit :

Caractère borné du mouvement

Pour toutes les valeurs de λ positives ou nulles, V(x) représente un puits de potentiel. La conservation de l'énergie mécanique totale E de la particule :

entraîne alors que le mouvement est borné dans un intervalle [x1, x2], où les points tournants x1 et x2 sont les deux solutions réelles de l'équation E=V(x)

Ordre zéro : l'oscillateur harmonique

Le problème de départ de la théorie des perturbations est l'équation différentielle (E0) correspondant à la valeur λ=0 :

Cette équation est par définition un oscillateur harmonique de pulsation ω0, dont la solution analytique exacte est bien connue :

où A et φ sont deux constantes, pour l'instant inconnues.

Théorie de perturbation naïve au premier ordre

On cherche la solution approchée sous la forme :

où x1(t) est une fonction inconnue, à déterminer. On injecte cette expression dans l'équation différentielle exacte (Eλ). En se limitant aux termes du premier ordre inclus et en utilisant le fait que x0(t) est la solution exacte de (E0), on obtient l'expression au premier ordre de la théorie de perturbation :

Apparition d'un terme séculaire

On constate que la perturbation contient un terme proportionnel au temps :

Ce terme non borné est appelé terme séculaire, du mot latin saeculum qui signifie siècle. En effet, pour les temps , la perturbation est bien d'ordre λ, c’est-à-dire petite. En revanche, pour des temps plus longs de l'ordre de , la perturbation devient d'ordre 1 et n'est plus petite ; le problème devient encore pire pour des temps encore plus longs : . Or nous savons que le mouvement réel est borné, donc que xλ(t) ne peut pas croître indéfiniment : notre théorie des perturbations « naïve » n'est donc plus valide.

Dans le cadre de l'astronomie, la présence de ces termes séculaires empêchent d'étudier le futur à long terme des trajectoires planétaires, l'unité de temps caractéristique du problème étant le siècle.

Lindstedt a proposé en 1882 une méthode qui, pour certaines équations différentielles, permet d'éliminer ces termes séculaires[7],[8]. On l'appelle aussi méthode de Lindstedt-Poincaré, Poincaré ayant démontré que les séries introduites par Lindstedt devaient être interprétées comme des expressions asymptotiques[9],[10],[4].

L'idée de Lindstedt est la suivante : dans certains cas, les termes séculaires peuvent être dus au fait que l'on développe incorrectement les expressions. Par exemple, supposons que le résultat exact soit :

Cette expression clairement bornée développée au premier ordre en λ donne :

et il apparaît un terme séculaire non borné. On voit que la solution exacte est en fait une fonction de la pulsation :

qui est légèrement différente de la pulsation initiale ω0 du problème. Lindstedt va utiliser cette remarque de façon systématique.

Principe de la méthode de Lindstedt

La méthode de Lindstedt ne s'applique que pour les équations différentielles du type suivant :

où f est une fonction paire de x et impaire de qui est de plus soit périodique en t, soit indépendante de t. La méthode consiste à faire un changement d'échelle de temps en introduisant une nouvelle variable s sans dimensions définie par le développement en série :

Dans cette expression, les valeurs numériques des constantes inconnues ωk, k ≥ 0 devront être choisies afin de faire disparaître les termes séculaires de la série perturbatrice de la solution approchée à l'ordre désiré.

Illustrons la méthode dans le paragraphe suivant avec l'oscillateur de Duffing.

Exemple : l'oscillateur de Duffing au premier ordre

On a vu plus haut que l'équation différentielle de l'oscillateur de Duffing s'écrivait :

Faisons le changement d'échelle de temps t → s et définissons la nouvelle fonction inconnue y de la variable s par :

La règle de Leibniz de dérivation en chaîne donne pour la dérivée première :

et pour la dérivée seconde :

Comme on a au premier ordre :

on obtient pour les dérivées :

L'équation différentielle de Duffing devient au premier ordre :

Introduisons maintenant dans cette équation différentielle le développement au premier ordre de la solution :

Il vient en développant selon les puissances de λ :

On a donc le système de deux équations différentielles :

La première a pour solution générale : y0(s)=A cos (s + φ) où A et φ sont deux constantes. On reporte alors cette expression dans la seconde équation différentielle, et on obtient pour la première correction y1(s) :

On réutilise la formule trigonométrique :

d'où l'équation différentielle pour la fonction y1(s) :

Il suffit alors d'annuler le coefficient devant le terme en cos (s + φ) en posant :

On obtient alors l'équation différentielle finale pour la fonction y1(s) :

Il arrive que le terme dépendant d'un paramètre de petite valeur ne puisse pas être supprimé en fixant le paramètre à 0 sans changer la nature du problème et avoir des conséquences sur les propriétés des solutions. On parle alors de perturbation singulière. Généralement, les perturbations singulières apparaissent quand le paramètre multiplie le terme de plus haut degré (dérivée d'ordre le plus élevé, plus forte puissance...).

Wikiwand in your browser!

Seamless Wikipedia browsing. On steroids.

Every time you click a link to Wikipedia, Wiktionary or Wikiquote in your browser's search results, it will show the modern Wikiwand interface.

Wikiwand extension is a five stars, simple, with minimum permission required to keep your browsing private, safe and transparent.

![{\displaystyle \lambda \ \left[\ {\frac {\mathrm {d} x_{1}(t)}{\mathrm {d} t}}+{\frac {1}{\tau }}x_{1}(t)\right]+\lambda {\frac {x_{0}^{2}(t)}{\tau L_{0}}}=0,}](http://wikimedia.org/api/rest_v1/media/math/render/svg/2c6a025b78663064cca809f65a6ac2b6f072f798)

![{\displaystyle x_{\lambda }(t)=X_{0}\ \cos \left(\omega _{0}t\right)+\lambda \ \left[{\frac {X_{0}^{3}}{32\,L_{0}^{2}}}\left[\cos \left(3\omega _{0}t\right)-\cos \left(\omega _{0}t\right)\right]+{\frac {3X_{0}^{3}}{8L_{0}^{2}}}\omega _{0}t\sin \left(\omega _{0}t\right)\right]+O(\lambda ^{2})}](http://wikimedia.org/api/rest_v1/media/math/render/svg/400e4d0fdef65113156fafbb7f29b70a8eab47c1)

![{\displaystyle \cos ^{3}\alpha ={\frac {1}{4}}\ \left[3\cos \alpha +\cos(3\alpha )\right]}](http://wikimedia.org/api/rest_v1/media/math/render/svg/abf0747c96eb26572189879cfc7aa5b4ccba08f7)

![{\displaystyle {\frac {d^{2}x_{1}(t)}{dt^{2}}}+\omega _{0}^{2}x_{1}(t)=-{\frac {\omega _{0}^{2}A^{3}}{4L_{0}^{2}}}\left[3\cos \left(\omega _{0}t+\varphi \right)+\cos \left(3\omega _{0}t+3\varphi \right)\right]}](http://wikimedia.org/api/rest_v1/media/math/render/svg/9ca4f9e7514f48ef548482e189ef685acdd14687)

![{\displaystyle x_{\lambda }(t)=A\cos \left(\omega _{0}t+\varphi \right)+\lambda \left[{\frac {3A^{3}}{8L_{0}^{2}}}\omega _{0}t\sin \left(\omega _{0}t+\varphi \right)+{\frac {A^{3}}{32L_{0}^{2}}}\cos \left(3\omega _{0}t+3\varphi \right)\right]+O(\lambda ^{2})}](http://wikimedia.org/api/rest_v1/media/math/render/svg/808172d16fea60db8f7744772bc4aa51c273502f)

![{\displaystyle -\ A\ \omega _{0}\ \sin(\varphi )\ +\ \lambda \ \left[\ {\frac {3\,\omega _{0}\,A^{3}}{8\,L_{0}^{2}}}\ \sin \varphi \ -\ {\frac {3\omega _{0}\,A^{3}}{32\,L_{0}^{2}}}\ \ \sin(3\varphi )\ \right]\ =\ 0\quad (2)}](http://wikimedia.org/api/rest_v1/media/math/render/svg/c4cd141b3e8bce280bfd8f3d72ca9324247fad6d)

![{\displaystyle A\ +\ \lambda \ {\frac {A^{3}}{32\,L_{0}^{2}}}\ =\ X_{0}\quad \Longrightarrow \quad A\ =\ X_{0}\ \left[\,1\,-\,{\frac {\lambda \,X_{0}^{2}}{32\,L_{0}^{2}}}\,\right]\ +\ O(\lambda ^{2})}](http://wikimedia.org/api/rest_v1/media/math/render/svg/d4b75e89a10d082eb379a95faa4a251c3e8084c8)

![{\displaystyle x_{\lambda }(t)=X_{0}\cos \left[(1+\lambda )\omega _{0}t\right]}](http://wikimedia.org/api/rest_v1/media/math/render/svg/aa0b764da5c0c0f5022b1c4529be52e5b89bfdc9)

![{\displaystyle \omega _{0}^{2}\left({\frac {\mathrm {d} ^{2}y_{0}}{\mathrm {d} s^{2}}}+y_{0}\right)+\lambda \left[\omega _{0}^{2}{\frac {\mathrm {d} ^{2}y_{1}}{\mathrm {d} s^{2}}}+2\omega _{0}\omega _{1}{\frac {\mathrm {d} ^{2}y_{0}}{\mathrm {d} s^{2}}}+\omega _{0}^{2}y_{1}+{\frac {\omega _{0}^{2}}{L_{0}^{2}}}\ y_{0}^{3}\right]=0+O(\lambda ^{2})}](http://wikimedia.org/api/rest_v1/media/math/render/svg/92ac8758dab13f9b49a803763734224a02085a8b)

![{\displaystyle {\frac {\mathrm {d} ^{2}y_{1}(s)}{\mathrm {d} s^{2}}}+y_{1}(s)=\left[{\frac {2\omega _{1}}{\omega _{0}}}-{\frac {3A^{3}}{4L_{0}^{2}}}\right]\cos(s+\varphi )-{\frac {A^{3}}{4L_{0}^{2}}}\cos(3s+3\varphi )}](http://wikimedia.org/api/rest_v1/media/math/render/svg/0c78641ff6462f9b9ef8473b75768c95bd39aa90)