From Wikipedia, the free encyclopedia

Dữ liệu lớn (Tiếng Anh: Big data) là một thuật ngữ cho việc xử lý một tập hợp dữ liệu rất lớn và phức tạp mà các ứng dụng xử lý dữ liệu truyền thống không xử lý được. Dữ liệu lớn bao gồm các thách thức như phân tích, thu thập, giám sát dữ liệu, tìm kiếm, chia sẻ, lưu trữ, truyền nhận, trực quan, truy vấn và tính riêng tư. Thuật ngữ này thường chỉ đơn giản đề cập đến việc việc sử dụng các phân tích dự báo, phân tích hành vi người dùng, hoặc một số phương pháp phân tích dữ liệu tiên tiến khác trích xuất giá trị từ dữ liệu mà ít khi đề cập đến kích thước của bộ dữ liệu.[2] "Vài nghi ngờ cho rằng số lượng của dữ liệu có sẵn hiện nay thực sự lớn, nhưng đó không phải là đặc trưng phù hợp nhất của hệ sinh thái dữ liệu mới này."[3]

Phân tích tập dữ hợp liệu có thể tìm ra tương quan mới tới "xu hướng kinh doanh hiện tại, phòng bệnh tật, chống tội phạm và vân vân".[4] Các nhà khoa học, điều hành doanh nghiệp, y bác sĩ, quảng cáo và các chính phủ cũng thường xuyên gặp những khó khăn với các tập hợp dữ liệu lớn trong các lĩnh vực bao gồm tìm kiếm internet, thông tin tài chính doanh nghiệp. Các nhà khoa học gặp giới hạn trong công việc cần tính toán rất lớn, bao gồm khí tượng học, bộ gen,[5] mạng thần kinh, các mô phỏng vật lý phức tạp, sinh vật học và nghiên cứu môi trường.[6]

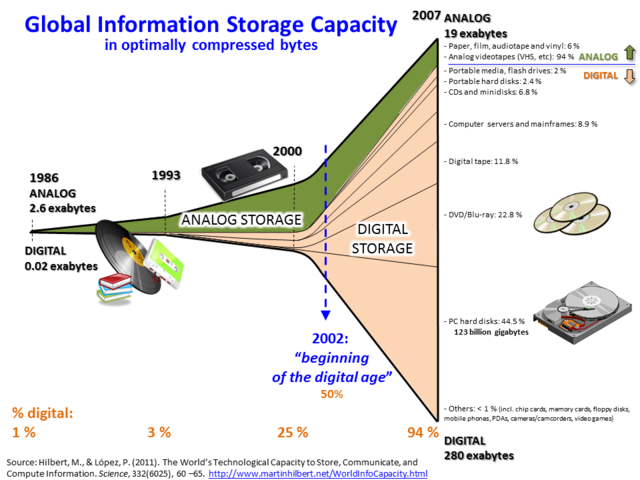

Tập dữ liệu đang tăng rất nhanh một phần vì chúng được thu thập bởi số lượng thiết bị internet vạn vật ngày càng rẻ và nhiều, ví dụ như các thiết bị di động, anten, nhật ký phần mềm, các thiết bị thu hình, thu thanh, đầu đọc RFID và mạng cảm biến không dây.[7][8] Khả năng lưu trữ thông tin của thế giới đã tăng bình quân gấp đôi sau mỗi 40 tháng từ những năm 1980[9]; riêng năm 2012, mỗi ngày thế giới tạo ra 2.5 exabytes (2.5×1018)[10]. Một câu hỏi cho các tổ chức kinh doanh lớn là xác định ai nên sở hữu các sáng kiến dữ liệu lớn có ảnh hưởng tới toàn bộ tổ chức.[11]

Hệ quản trị cơ sở dữ liệu quan hệ, máy bàn và các gói ảo hóa thường khó xử lý dữ liệu lớn. Công việc khổng lồ này yêu cầu được xử lý bởi hàng chục, hàng trăm, hoặc thậm chí hàng nghìn máy chủ.[12] Người ta quan niệm dữ liệu lớn khác nhau phụ thuộc vào khả năng của người dùng và công cụ họ dùng, và khả năng mở rộng làm cho dữ liệu lớn luôn thay đổi. "Các tổ chức đối diện với hàng trăm gigabytes dữ liệu ở thời gian đầu gây ra sự cần thiết phải xem xét lại các tùy chọn quản trị dữ liệu. Mặt khác, có thể tạo ra hàng chục hoặc hàng trăm terabytes trước khi kích thước dữ liệu trở thành một lý do quan trọng".[13]

Dữ liệu lớn thường bao gồm tập hợp dữ liệu với kích thước vượt xa khả năng của các công cụ phần mềm thông thường để thu thập, hiển thị, quản lý và xử lý dữ liệu trong một thời gian có thể chấp nhận được. Kích thước dữ liệu lớn là một mục tiêu liên tục thay đổi. Như năm 2012 thì phạm vi một vài tá terabytes tới nhiều petabytes dữ liệu. Dữ liệu lớn yêu cầu một tập các kỹ thuật và công nghệ được tích hợp theo hình thức mới để khai phá từ tập dữ liệu đa dạng, phức tạp, và có quy mô lớn.

Trong báo cáo nghiên cứu năm 2001 và những diễn giả liên quan, META Group (bây giờ là Gartner) nhà phân tích Doug Laney định nghĩa những thách thức và cơ hội tăng dữ liệu như là 3 chiều, tăng giá trị dữ liệu, tốc độ vào ra của dữ liệu (velocity), và khổ giới hạn của kiểu dữ liệu (variety). Gartner, và nhiều ngành công nghiệp tiếp tục sử dụng mô hình '3Vs' để mô tả dữ liệu lớn. Trong năm 2012, Gartner đã cập nhật định nghĩa như sau: "Dữ liệu lớn là khối lượng lớn, tốc độ cao và/hoặc loại hình thông tin rất đa dạng mà yêu cầu phương thức xử lý mới để cho phép tăng cường ra quyết định, khám phá bên trong và xử lý tối ưu". Định nghĩa '3Vs' của Gartner vẫn được sử dụng rộng rãi, và trong phù hợp với định nghĩa đồng thuận.là: "Dữ liệu lớn tiêu biểu cho tập thông tin mà đặc điểm như khối lượng lớn (Volume), tốc độ cao(Velocity) và đa dạng (Variety) để yêu cầu phương thức phân tích và công nghệ riêng biệt để biến nó thành có giá trị". Thêm nữa, vài tổ chức đã thêm vào tính xác thực(Veracity) để mô tả về nó. 3Vs đã được mở rộng để bổ sung đặc tính của dữ liệu lớn.

Big Data được mô tả bởi những đặc trưng sau:

Volume (Dung lượng)

Số lượng dữ liệu được tạo ra và lưu trữ. Kích thước của dữ liệu xác định giá trị và tiềm năng insight- và liệu nó có thể thực sự được coi là dữ liệu lớn hay không.

Variety (Tính đa dạng)

Các dạng và kiểu của dữ liệu. Dữ liệu được thu thập từ nhiều nguồn khác nhau và các kiểu dữ liệu cũng có rất nhiều cấu trúc khác nhau.

Velocity (Vận tốc)

Trong trường hợp này nghĩa là tốc độ các dữ liệu được tạo ra và xử lý để đáp ứng các nhu cầu và thách thức trên con đường tăng trưởng và phát triển.

Veracity (Tính xác thực)

Chất lượng của dữ liệu thu được có thể khác nhau rất nhiều, ảnh hưởng đến sự phân tích chính xác.

Nhà máy và các hệ thống không thực-ảo có thể có một hệ thống 6C bao gồm:

• Kết nối (cảm biến và mạng)

• Đám mây (tính toán và dữ liệu theo yêu cầu)

• Nội dung ảo (mẫu và bộ nhớ)

• Nội dung / ngữ cảnh (ý nghĩa và tương quan)

• Cộng đồng (chia sẻ và cộng tác)

• Tuỳ chỉnh (cá nhân hoá và giá trị)

Dữ liệu phải được xử lý bằng các công cụ tiên tiến (phân tích và thuật toán) để cho ra các thông tin có ý nghĩa. Ví dụ, để quản lý một nhà máy phải xem xét cả hai vấn đề hữu hình và vô hình với các thành phần khác nhau. Các thuật toán tạo thông tin phải phát hiện và giải quyết các vấn đề không nhìn thấy được như sự xuống cấp của máy, mài mòn linh kiện, vv. trong nhà máy.

Nguồn dữ liệu lớn đã tồn tại dưới nhiều hình thức, thường được xây dựng bởi các công ty cho những nhu cầu đặc biệt. Bắt đầu từ những năm 1990, các nhà cung cấp thương mại tham gia cung cấp các hệ thống quản lý cơ sở dữ liệu song song cho các dữ liệu lớn. Trong nhiều năm, WinterCorp là công ty phát hành báo cáo lớn nhất về cơ sở dữ liệu.[14]

Năm 1984, Tập đoàn Teradata đưa ra thị trường hệ thống xử lý dữ liệu song song DBC 1012. Các hệ thống của Teradata là những hệ thống đầu tiên lưu trữ và phân tích đến 1 terabyte dữ liệu vào năm 1992. Ổ đĩa cứng đã đạt đến mức dung lượng 2.5GB vào năm 1991 nên định nghĩa dữ liệu lớn liên tục phát triển theo quy luật Kryder. Teradata đã cài đặt hệ thống đầu tiên dựa trên RDBMS có thể phân tích hàng petabytes dữ liệu vào năm 2007. Đến năm 2017, có hàng chục các cơ sở dữ liệu dựa trên hệ thống của Teradata có dung lượng hàng petabyte, trong đó dữ liệu lớn nhất vượt quá 50 petabytes. Cho đến năm 2008, 100% hệ thống đều xử lý các dữ liệu quan hệ có cấu trúc. Do đó, Teradata đã thêm các kiểu dữ liệu phi cấu trúc bao gồm XML, JSON và Avro.

Năm 2000, Seisint Inc. (nay là Tập đoàn LexisNexis) đã phát triển một khung chia sẻ tệp dựa trên cấu cấu trúc C++ để lưu trữ và truy vấn dữ liệu. Hệ thống này lưu trữ và phân phối dữ liệu có cấu trúc, bán cấu trúc, và phi cấu trúc trên nhiều máy chủ. Người dùng có thể truy vấn bằng một phương ngữ C ++ gọi là ECL. ECL sử dụng phương thức "áp dụng giản đồ khi truy cập dữ liệu" để suy luận cấu trúc dữ liệu được lưu trữ khi nó được truy vấn, thay vì khi nó được lưu trữ. Năm 2004, LexisNexis mua lại Seisint Inc.[15] và trong năm 2008 đã mua lại ChoicePoint, Inc.[16] cùng với nền tảng xử lý song song tốc độ cao của họ. Hai nền tảng đã được sáp nhập vào hệ thống HPCC (High-Performance Computing Cluster) và HPCC có mã nguồn mở dựa trên giấy phép Apache v2.0 vào năm 2011. Khoảng cùng thời điểm đó, hệ thống Quantcast File đã được phát hành.[17]

Năm 2004, Google xuất bản một bài báo về một quá trình gọi là MapReduce sử dụng một kiến trúc tương tự. MapReduce cung cấp một mô hình xử lý song song, và phát hành những ứng dụng liên quan để xử lý lượng dữ liệu khổng lồ. Với MapReduce, các truy vấn được chia nhỏ và truyền đi qua các nút mạng song song và được xử lý song song (bước Map). Các kết quả sau đó được thu thập và phân phối (Bước Reduce). Khuôn mẫu này rất thành công[18] nên những công ty khác cũng muốn sao chép các thuật toán của nó. Do đó, Google đã triển khai khuôn mẫu MapReduce thông qua dự án mã nguồn mở Apache Hadoop.[19]

Các nghiên cứu vào năm 2012 cho thấy cấu trúc nhiều lớp là một lựa chọn để giải quyết các vấn đề của xử lý dữ liệu lớn. Một kiến trúc phân tán song song phân tán dữ liệu trên nhiều máy chủ; những môi trường thực hiện song song này có thể cải thiện đáng kể tốc độ xử lý dữ liệu. Kiểu cấu trúc này chèn dữ liệu vào một DBMS song song, thực hiện việc sử dụng các khung nền MapReduce và Hadoop. Loại khung nền này sẽ tăng sức mạnh xử lý thông suốt đến người dùng cuối bằng cách sử dụng một máy chủ ứng dụng đầu cuối.[20]

Phân tích dữ liệu lớn ứng dụng vào việc sản xuất được giới thiệu như một cấu trúc 5C (connection - kết nối, conversion - chuyển đổi, cyber - không gian mạng, cognition - nhận thức và configuration - cấu hình).[21]

Hồ dữ liệu cho phép một tổ chức thay đổi định hướng từ mô hình kiểm soát tập trung sang mô hình chia sẻ thông tin để năng động đáp ứng với sự thay đổi của việc quản lý thông tin. Điều này cho phép phân tách nhanh chóng dữ liệu vào hồ dữ liệu, do đó làm giảm thời gian xử lý thông tin.[22][23]

Báo cáo của Viện nghiên cứu Toàn cầu McKinsey năm 2011 mô tả các thành phần chính và hệ sinh thái của dữ liệu lớn như sau:

• Các kỹ thuật để phân tích dữ liệu, chẳng hạn như kiểm thử A/B, học máy và xử lý ngôn ngữ tự nhiên

• Công nghệ dữ liệu lớn, như thông tin kinh doanh, điện toán đám mây và cơ sở dữ liệu

• Công cụ trực quan như biểu đồ, đồ thị và các phương pháp thể hiện khác của dữ liệu

Các dữ liệu lớn đa chiều cũng có thể được biểu diễn dưới dạng tensor, có thể được xử lý hiệu quả hơn bằng cách tính toán dựa trên cơ sở dựa trên Tensor, chẳng hạn như nghiên cứu không gian đa cấp. Các công nghệ bổ sung đang được áp dụng cho dữ liệu lớn bao gồm cơ sở dữ liệu MPP, các ứng dụng dựa trên tìm kiếm, khai thác dữ liệu, hệ thống phân tán tập tin, phân tán cơ sở dữ liệu, điện toán đám mây và HPC (ứng dụng, lưu trữ và các tài nguyên máy tính) và Mạng Internet. Mặc dù nhiều phương thức tiếp cận cũng như các công nghệ xử lý đã được phát triển, vẫn còn khó khăn để thực hiện việc học máy với dữ liệu lớn.

Một vài cơ sở dữ liệu liên quan đến MPP có khả năng lưu trữ và quản lý hàng petabytes dữ liệu. Đó chính là một nguồn tận dụng khả năng tải về, theo dõi, sao lưu và tối ưu hóa việc sử dụng các bảng dữ liệu lớn trong RDBMS.

Chương trình Phân tích Dữ liệu Topological của DARPA tìm ra cấu trúc cơ bản của bộ dữ liệu khổng lồ và đến năm 2008, công nghệ này được công bố cùng với sự ra mắt của công ty Ayasdi.

Những chuyên viên phân tích dữ liệu lớn thường không sử dụng việc lưu trữ bằng những ổ đĩa chia sẻ vì chúng chậm, họ thích lưu trữ trực tiếp (DAS) dưới nhiều hình thức khác nhau từ ổ SSD (SATA) đến ổ đĩa SATA dung lượng cao được tích hợp bên trong các nút xử lý song song. Các kiến trúc lưu trữ dùng chung - Mạng lưu trữ (SAN) và Lưu trữ trên Mạng (NAS) tương đối chậm, phức tạp và tốn kém. Những yếu tố này không phù hợp với các hệ thống phân tích dữ liệu lớn đang phát triển mạnh mẽ về hiệu năng hệ thống, cơ sở hạ tầng và chi phí thấp.

Việc gửi thông tin thời gian thực hoặc gần với thời gian thực là một trong những đặc điểm xác định của phân tích dữ liệu lớn. Do đó độ trễ được tránh bất cứ khi nào và bất cứ khi nào có thể. Dữ liệu trong bộ nhớ là dữ liệu trên một đĩa quay tròn với một đầu kia là FC SAN. Chi phí của một SAN ở quy mô cần thiết cho các ứng dụng phân tích cao hơn rất nhiều so với các kỹ thuật lưu trữ khác.

Có nhiều lợi thế cũng như bất lợi khi sử dụng các ổ đĩa chung trong phân tích dữ liệu lớn, nhưng các chuyên gia phân tích dữ liệu lớn vào năm 2011 đã không ủng hộ chuyện này.

Việc sử dụng các dữ liệu lớn trong các quy trình của chính phủ cho phép tăng hiệu quả về mặt chi phí, năng suất và sự đổi mới, nhưng không phải là không có sai sót của nó. Phân tích dữ liệu thường yêu cầu nhiều bộ phận của chính phủ (trung ương và địa phương) hợp tác và tạo ra các quy trình mới và sáng tạo để mang lại kết quả mong muốn. Dưới đây là một số ví dụ về các sáng kiến liên quan đến dữ liệu lớn của chính phủ.

• Năm 2012, chính quyền của Tổng thống Obama tuyên bố Sáng kiến Nghiên cứu và Phát triển Dữ liệu lớn để tìm hiểu xem dữ liệu lớn có thể được sử dụng như thế nào để giải quyết các vấn đề quan trọng mà chính phủ phải đối mặt. Sáng kiến bao gồm 84 chương trình dữ liệu lớn khác nhau trải rộng trên sáu phòng ban.

• Phân tích dữ liệu lớn đã đóng một vai trò lớn trong chiến dịch bầu cử lại thành công của Barack Obama năm 2012.

• Chính phủ liên bang Hoa Kỳ sở hữu sáu trong số mười siêu máy tính mạnh nhất trên thế giới.

• Trung tâm Dữ liệu Utah đã được NSA (Cơ quan An ninh Quốc gia Hoa Kỳ) xây dựng. Khi hoàn tất, cơ sở sẽ có thể xử lý một số lượng lớn thông tin thu thập được bởi NSA qua Internet. Số lượng chính xác của không gian lưu trữ là không rõ, nhưng các nguồn gần đây hơn cho rằn

• Phân tích số liệu lớn đã được thử nghiệm cho BJP để giành chiến thắng trong Tổng tuyển cử Ấn Độ, 2014.

• Chính phủ Ấn Độ sử dụng nhiều kỹ thuật để xác định cách thức cử tri Ấn Độ phản ứng lại hành động cũng như các ý tưởng của chính phủ về thay đổi chính sách.

Ví dụ về việc sử dụng dữ liệu lớn trong các dịch vụ công:

• Dữ liệu về thuốc theo toa: bằng cách kết nối nguồn gốc, vị trí và thời gian của mỗi toa thuốc, một đơn vị nghiên cứu có thể theo dõi việc phân phối bất cứ loại thuốc nào trong đơn thuốc, và hướng dẫn Viện Y tế và Chăm sóc Quốc gia điều chỉnh cho chính xác. Điều này khiến cho các loại thuốc mới nhất sẽ tốn ít thời gian hơn khi đến với bệnh nhân phổ thông.

• Kết nối dữ liệu: các cơ quan địa phương liên kết các dữ liệu về các dịch vụ với nhau, ví dụ như hệ thống giao thông, với các dịch vụ công, như là việc phân chia thức ăn cho người tàn tật. Việc kết nối dữ liệu cho phép chính quyền địa phương tránh được các chậm trễ liên quan đến thời tiết, đường sá...

Nghiên cứu về việc sử dụng hiệu quả các công nghệ thông tin và truyền thông cho mục đích phát triển (hay còn gọi là ICT4D) cho thấy công nghệ dữ liệu lớn có thể có nhiều đóng góp quan trọng nhưng cũng là thách thức đối với sự phát triển của quốc tế. Những tiến bộ trong phân tích dữ liệu lớn giúp giảm chi phí cho việc ra quyết định trong các lĩnh vực quan trọng như chăm sóc sức khoẻ, việc làm, năng suất kinh tế, tội phạm, an ninh, thiên tai và quản lý tài nguyên. Tuy nhiên, những thách thức đối với các nước đang phát triển như cơ sở hạ tầng công nghệ không đầy đủ và sự khan hiếm về kinh tế và nguồn nhân lực sẽ làm nghiêm trọng thêm các mặt trái của dữ liệu lớn như sự riêng tư hoặc các vấn đề khác.

Việc sử dụng các dữ liệu lớn dưới dạng lịch sử các giao dịch tài chính được gọi là phân tích kỹ thuật. Sử dụng dữ liệu phi tài chính để dự đoán thị trường đôi khi được gọi là dữ liệu thay thế.

Theo bài Nghiên cứu xu hướng toàn cầu TCS 2013, sự cải tiến trong kế hoạch sản xuất và chất lượng sản phẩm là lợi ích lớn nhất của dữ liệu lớn cho ngành sản xuất. Dữ liệu lớn cung cấp cơ sở hạ tầng cho ngành công nghiệp sản xuất, đó là khả năng cải thiện năng suất và tính khả dụng. Việc lên kế hoạch sản xuất chính là một cách tiếp cận dữ liệu lớn cho phép giảm thời gian chết về gần như bằng không và cụ thể hóa số lượng lớn dữ liệu và các công cụ dự đoán khác cho phép tạo ra một quá trình nhằm hệ thống hóa dữ liệu thành các thông tin hữu ích. Khái niệm về việc dự báo sản xuất bắt đầu bằng việc thu thập dữ liệu cảm quan khác nhau như âm thanh, chuyển động, áp suất, điện áp... Số lượng lớn các dữ liệu cảm quan cộng với dữ liệu lịch sử sản xuất tạo thành dữ liệu lớn trong sản xuất. Các dữ liệu lớn này như là đầu vào cho các công cụ dự báo và các chiến lược phòng ngừa tương tự như việc dự báo trong lĩnh vực Quản lý Y tế.

Phân tích dữ liệu lớn đã giúp cải thiện việc chăm sóc sức khoẻ bằng cách cá nhân hóa các phương pháp trị liệu và chẩn đoán lâm sàng, làm giảm thiểu chi phí và thời gian khám bệnh, tự động báo cáo và lưu trữ thông tin sức khỏe và dữ liệu bệnh nhân trong nội bộ cũng như mở rộng ra bên ngoài, chuẩn hóa các thuật ngữ y học và chống phân mảnh trong lưu trữ dữ liệu và thông tin của bệnh. Một số lĩnh vực có sự cải tiến mang tính hướng dẫn hơn là thực hành. Lượng dữ liệu được tạo ra trong các hệ thống chăm sóc sức khoẻ là không nhỏ. Với sự bổ sung thêm của mHealth, eHealth và các thiết bị công nghệ theo dõi sức khỏe được thì khối lượng dữ liệu sẽ tiếp tục gia tăng. Điều này bao gồm dữ liệu ghi chép sức khoẻ điện tử, dữ liệu hình ảnh, dữ liệu được tạo ra của bệnh nhân, dữ liệu cảm biến và các dạng dữ liệu khó xử lý khác. Hiện nay, nhu cầu lớn hơn đối với các môi trường như vậy là chú ý nhiều hơn đến chất lượng dữ liệu và thông tin. "Dữ liệu lớn rất thường có nghĩa là dữ liệu chưa được xử lý và một phần số liệu không chính xác tăng lên khi có sự tăng trưởng khối lượng dữ liệu." Việc theo dõi bằng con người ở quy mô dữ liệu lớn là không thể và có một nhu cầu cấp thiết về các công cụ thông minh để kiểm soát chính xác và xử lý thông tin bị mất trong dịch vụ y tế. Mặc dù dữ liệu trong lĩnh vực chăm sóc sức khoẻ hiện nay thường được lưu trữ dưới dạng điện tử, nhưng nó nằm ngoài phạm vi của dữ liệu lớn vì hầu hết không có cấu trúc và khó sử dụng.

Một nghiên cứu của Viện nghiên cứu toàn cầu McKinsey cho thấy, ngành dữ liệu lớn đang thiếu hụt 1,5 triệu chuyên gia cũng như nhà quản lý dữ liệu, và một số trường đại học bao gồm Đại học Tennessee và UC Berkeley đã tạo ra các chương trình thạc sĩ để đáp ứng nhu cầu này. Các khóa huấn luyện tư nhân cũng phát triển các chương trình để đáp ứng nhu cầu đó, bao gồm các chương trình miễn phí như The Data Incubator hoặc chương trình trả tiền như General Assembly.

Để hiểu cách thức các phương tiện truyền thông sử dụng dữ liệu lớn như thế nào, trước tiên cần hiểu rõ một số ngữ cảnh trong cơ chế sử dụng cho quá trình truyền thông. Nick Couldry và Joseph Turow đề xuất rằng các học viên trong ngành Truyền thông và Quảng cáo cần tiếp cận dữ liệu lớn như là nhiều điểm thông tin về hàng triệu cá nhân. Ngành công nghiệp dường như đang chuyển hướng từ cách tiếp cận truyền thống bằng cách sử dụng các môi trường truyền thông cụ thể như báo chí, tạp chí hoặc chương trình truyền hình và thay vào đó là những người tiêu dùng với công nghệ tiếp cận những người này được nhắm mục tiêu vào những thời điểm tối ưu ở những vị trí tối ưu. Mục đích cuối cùng là để phục vụ hoặc truyền tải, một thông điệp hoặc nội dung (theo cách thống kê) phù hợp với suy nghĩ của người tiêu dùng. Ví dụ, môi trường xuất bản ngày càng làm cho các thông điệp (quảng cáo) và nội dung (bài viết) được cải thiện để thu hút người tiêu dùng đã được thu thập độc quyền thông qua các hoạt động khai thác dữ liệu khác nhau.

• Nhắm đến người tiêu dùng mục tiêu (đối với quảng cáo của các nhà tiếp thị)

•Thu thập dữ liệu

• Dữ liệu trong báo chí: nhà xuất bản và nhà báo sử dụng các công cụ dữ liệu lớn để cung cấp thông tin chi tiết và các bản đồ họa chi tiết độc đáo và sáng tạo.

Kênh 4, một kênh phát thanh truyền hình công cộng của Anh, đang dẫn đầu trong lĩnh vực dữ liệu lớn và phân tích dữ liệu.

Dữ liệu lớn có thể kết hợp với công nghệ Mạng lưới vạn vật kết nối Internet. Dữ liệu được chiết xuất từ các thiết bị IoT cung cấp một bản đồ kết nối giữa các thiết bị. Những sự kết nối này đã được ngành công nghiệp truyền thông, các công ty và chính phủ sử dụng để nhắm mục tiêu chính xác hơn đối tượng của họ và tăng hiệu quả của phương tiện truyền thông. IoT cũng ngày càng được chấp nhận như một phương tiện thu thập dữ liệu cảm giác, và dữ liệu cảm giác này đã được sử dụng trong các ngành như y học và sản xuất.

Kevin Ashton, chuyên gia đổi mới kỹ thuật số người được cho là người tạo ra thuật ngữ định nghĩa Internet vạn vật đã phát biểu: "Nếu chúng ta có máy tính biết tất cả mọi thứ - nó sẽ sử dụng dữ liệu mà nó thu thập được mà không có sự trợ giúp từ chúng ta - chúng ta sẽ có thể theo dõi và kiểm soát mọi thứ, giảm đáng kể lượng chất thải, tổn thất và chi phí. Chúng ta sẽ biết khi nào cần thay thế, sửa chữa hoặc thu hồi lại, và liệu rằng thức ăn chúng ta đang ăn có tươi hay không."

Từ năm 2015, dữ liệu lớn trở nên nổi bật trong hoạt động kinh doanh như một công cụ để giúp nhân viên làm việc hiệu quả hơn cũng như tối ưu hóa việc thu thập và chia sẻ thông tin. Việc sử dụng dữ liệu lớn để giải quyết các vấn đề thu thập dữ liệu và CNTT trong một doanh nghiệp được gọi là IT Operations Analytics (ITOA). Bằng cách áp dụng các nguyên tắc dữ liệu lớn vào các khái niệm về trí thông minh của máy móc và tính toán sâu, các bộ phận CNTT có thể dự đoán các vấn đề tiềm ẩn và đưa ra các giải pháp trước khi vấn đề xảy ra. Vào thời điểm này, các doanh nghiệp ITOA cũng bắt đầu đóng vai trò quan trọng trong việc quản lý hệ thống bằng cách cung cấp các nền tảng mang các dữ liệu cá nhân riêng biệt và tạo ra những hiểu biết sâu sắc từ toàn bộ hệ thống chứ không phải từ các dữ liệu riêng lẻ.

• EBay sử dụng hai kho dữ liệu với tốc độ 7.5 petabyte và 40PB cũng như một cụm 40PB Apache Hadoop để tìm kiếm, khuyến nghị người tiêu dùng và bán hàng.

• Amazon.com xử lý hàng triệu hoạt động back-end hàng ngày, cũng như các truy vấn từ hơn nửa triệu người bán hàng bên thứ ba. Công nghệ cốt lõi mà Amazon hoạt động dựa trên Linux và đến năm 2005 họ có ba cơ sở dữ liệu Linux lớn nhất thế giới, với dung lượng 7,8 TB, 18,5 TB và 24,7 TB.

• Facebook xử lý 50 tỷ hình ảnh từ cơ sở người dùng của nó.

• Google đã xử lý khoảng 100 tỷ lượt tìm kiếm mỗi tháng vào tháng 8 năm 2012.

• Cơ sở dữ liệu Oracle NoSQL đã được kiểm tra để vượt qua mốc 1 triệu xử lý mỗi giây với 8 nhân và đạt tốc độ 1.2 triệu xử lý mỗi giây với 10 nhân.

Seamless Wikipedia browsing. On steroids.

Every time you click a link to Wikipedia, Wiktionary or Wikiquote in your browser's search results, it will show the modern Wikiwand interface.

Wikiwand extension is a five stars, simple, with minimum permission required to keep your browsing private, safe and transparent.