Loading AI tools

Período da história humana marcado pela transição industrial tradicional para uma economia baseada na informação e tecnologia Da Wikipédia, a enciclopédia livre

Era da Informação[lower-alpha 1] é um período histórico que começou em meados do século XX. É caracterizada por uma rápida mudança das indústrias tradicionais, tal como estabelecidas durante a Revolução Industrial, para uma economia centrada na tecnologia da informação.[2]

| Era da Informação | |

|---|---|

| Um laptop se conecta à Internet para exibir informações da Wikipédia; a comunicação de longa distância entre sistemas de computador é uma marca registrada da era da informação | |

| Localização | Mundo |

| Data | 1947-2011 |

| Resultado | Uso generalizado de porta lógica, transistores, chips de circuito integrado (IC) e suas tecnologias derivadas, incluindo computadores, microprocessadores digitais, telefones celulares e a Internet. |

| Anterior | Segunda Revolução Industrial |

| Posterior | Quarta Revolução Industrial |

O início da Era da Informação foi associado ao desenvolvimento do transistor em 1947[2] e do amplificador óptico em 1957.[3] Esses avanços tecnológicos tiveram um impacto significativo na maneira como as informações são processadas e transmitidas.

De acordo com a Rede de Administração Pública das Nações Unidas, a Era da Informação foi formada pela capitalização dos avanços da miniaturização dos computadores,[4] que levaram à modernização dos sistemas de informação e das comunicações pela Internet como a força motriz da evolução social.[5]

Há um debate em curso sobre se a Terceira Revolução Industrial já terminou e se a Quarta Revolução Industrial já começou devido aos recentes avanços em áreas como a inteligência artificial e as biotecnologias.[6]

Existem diferentes conceituações da Era da Informação. Alguns se concentram na evolução da informação ao longo dos tempos, distinguindo entre a Era da Informação Primária e a Era da Informação Secundária. A informação na Era da Informação Primária era tratada por jornais, rádio e televisão. A Era da Informação Secundária foi desenvolvida pela Internet, televisões por satélite e telefones celulares. A Era da Informação Terciária surgiu com a mídia da Era Primária interconectada com a mídia da Secundária, conforme vivenciada atualmente.[7]

Outros classificam-no em termos das bem estabelecidas ondas longas schumpeterianas ou ondas de Kondratiev. Aqui os autores distinguem três diferentes metaparadigmas de longo prazo, cada um com diferentes ondas longas. O primeiro focou na transformação de materiais, incluindo pedra, bronze e ferro . A segunda, frequentemente chamada de Revolução Industrial, foi dedicada à transformação de energia, incluindo água, vapor, eletricidade e energia de combustão. Por fim, o metaparadigma mais recente visa transformar a informação. Começou com a proliferação da comunicação e dos dados armazenados e agora entrou na era dos algoritmos, que visam criar processos automatizados para converter as informações existentes em conhecimento acionável.[8]

A revolução digital converteu a tecnologia do formato analógico para o formato digital. Com isso, tornou-se possível fazer cópias idênticas ao original. Nas comunicações digitais, por exemplo, o repetidor foi capaz de amplificar o sinal digital e transmiti-lo sem perda de informação no sinal. De igual importância para a revolução foi a capacidade de mover facilmente as informações digitais entre mídias e acessá-las ou distribuí-las remotamente. Um ponto de viragem da revolução foi a mudança da música gravada analógica para a digital.[9] Durante a década de 1980, o formato digital dos discos compactos ópticos substituiu gradualmente os formatos analógicos, como discos de vinil e fitas cassete, como o meio de escolha popular.

Em 1947, o primeiro transistor funcional, o transistor de contato pontual baseado em germânio, foi inventado por John Bardeen e Walter Houser Brattain enquanto trabalhavam com William Shockley nos Laboratórios Bell.[10] Isso abriu caminho para computadores digitais mais avançados. A partir do final da década de 1940, universidades, militares e empresas desenvolveram sistemas de computador para replicar digitalmente e automatizar cálculos matemáticos que antes eram realizados manualmente, sendo o LEO o primeiro computador de uso geral disponível comercialmente. A comunicação digital se tornou econômica para adoção generalizada após a invenção do computador pessoal na década de 1970. Claude Shannon, um matemático dos Bell Labs, é creditado por ter estabelecido as bases da digitalização em seu artigo pioneiro de 1948, Uma Teoria Matemática da Comunicação.[11]

Em 1948, Bardeen e Brattain patentearam um transistor de porta isolada (IGFET) com uma camada de inversão. Seu conceito constitui a base da tecnologia CMOS e DRAM hoje.[12] Em 1957, nos Bell Labs, Frosch e Derick conseguiram fabricar transistores planares de dióxido de silício,[13] mais tarde, uma equipe nos Bell Lab demonstrou um MOSFET funcional.[14] O primeiro marco do circuito integrado foi alcançado por Jack Kilby em 1958.[15]

Outros desenvolvimentos tecnológicos importantes incluíram a invenção do chip de circuito integrado monolítico por Robert Noyce na Fairchild Semiconductor em 1959,[16] possibilitado pelo processo planar desenvolvido por Jean Hoerni.[17] Em 1963, o MOS complementar (CMOS) foi desenvolvido por Chih-Tang Sah e Frank Wanlass na Fairchild Semiconductor.[18] O transistor de porta autoalinhado, que facilitou ainda mais a produção em massa, foi inventado em 1966 por Robert Bower na Hughes Aircraft[19][20] e independentemente por Robert Kerwin, Donald Klein e John Sarace na Bell Labs.[21]

Após o desenvolvimento dos chips de circuitos integrados MOS no início da década de 1960, os chips MOS atingiram maior densidade de transistores e menores custos de fabricação do que os circuitos integrados bipolares em 1964. Os chips MOS aumentaram ainda mais em complexidade a uma taxa prevista pela Lei de Moore, levando à integração em larga escala (LSI) com centenas de transistores em um único chip MOS no final da década de 1960. A aplicação de chips MOS LSI à computação foi a base para os primeiros microprocessadores, quando os engenheiros começaram a reconhecer que um processador de computador completo poderia ser contido em um único chip MOS LSI.[22] Em 1968, o engenheiro da Fairchild Federico Faggin melhorou a tecnologia MOS com o desenvolvimento do chip MOS de porta de silício, que mais tarde ele usou para desenvolver o Intel 4004, o primeiro microprocessador de chip único. Foi lançado pela Intel em 1971 e lançou as bases para a revolução dos microcomputadores que começou na década de 1970.[23]

A tecnologia MOS também levou ao desenvolvimento de sensores de imagem semicondutores adequados para câmeras digitais.[24] O primeiro sensor de imagem desse tipo foi o dispositivo de carga acoplada, desenvolvido por Willard S. Boyle e George E. Smith nos Bell Lab em 1969,[25] com base na tecnologia de capacitor MOS.[24]

O público foi apresentado pela primeira vez aos conceitos que levaram à Internet quando uma mensagem foi enviada pela ARPANET em 1969. Redes de comutação de pacotes, como ARPANET, Mark I, CYCLADES, Merit Network, Tymnet e Telenet, foram desenvolvidas no final da década de 1960 e início da década de 1970 usando uma variedade de protocolos . A ARPANET, em particular, levou ao desenvolvimento de protocolos para interconexão de redes, nos quais várias redes separadas podiam ser unidas em uma rede de redes. O movimento Whole Earth da década de 1960 defendeu o uso de novas tecnologias.[26]

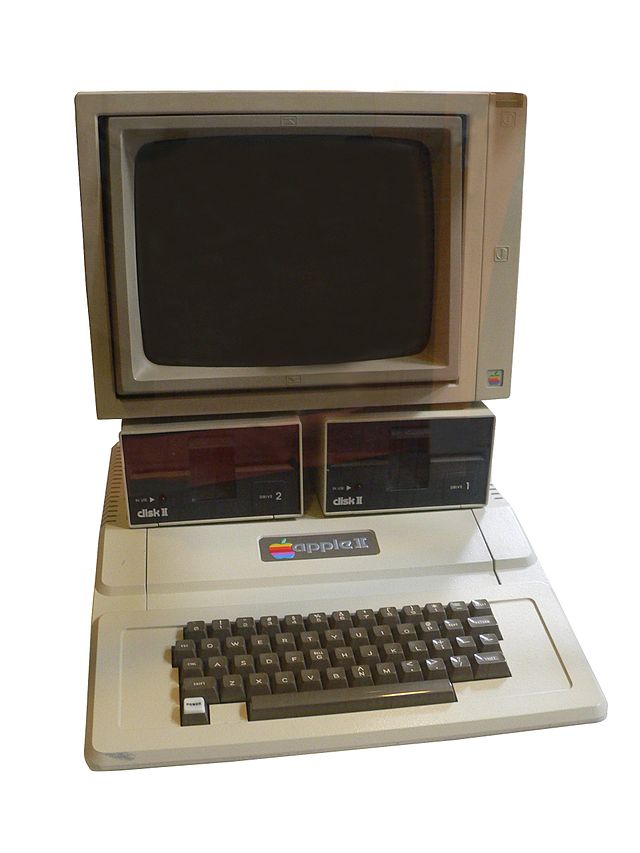

Na década de 1970, foram introduzidos o computador doméstico,[27] os computadores de tempo compartilhado,[28] os consoles de videogame, os primeiros videogames operados por moedas[29][30] e a era de ouro dos videogames de fliperama começou com Space Invaders. Nos países desenvolvidos, os computadores alcançaram semi-onipresença durante a década de 1980, quando chegaram às escolas, lares, empresas e indústrias. Caixas eletrônicos, robôs industriais, CGI em filmes e televisão, música eletrônica, sistemas de quadros de avisos e videogames, todos alimentaram o que se tornou o zeitgeist da década de 1980. Milhões de pessoas compraram computadores domésticos, tornando famosos os primeiros fabricantes de computadores pessoais, como Apple, Commodore e Tandy. Até hoje, o Commodore 64 é frequentemente citado como o computador mais vendido de todos os tempos, tendo vendido 17 milhões de unidades (segundo alguns relatos) entre 1982 e 1994.[31]

Em 1984, o US Census Bureau começou a coletar dados sobre o uso de computadores e da Internet nos Estados Unidos; sua primeira pesquisa mostrou que 8,2% de todas as famílias estadunidenses possuíam um computador pessoal em 1984, e que as famílias com crianças menores de 18 anos de idade tinham quase o dobro de probabilidade de possuir um, 15,3% (as famílias de classe média e média alta eram as mais propensas a possuir um, 22,9%).[32]

A revista Compute! previu que o CD-ROM seria a peça central da revolução, com vários dispositivos domésticos lendo os discos.[33] A primeira câmera verdadeiramente digital foi criada em 1988, e as primeiras foram comercializadas em dezembro de 1989 no Japão e em 1990 nos Estados Unidos.[34]

Tim Berners-Lee inventou a World Wide Web em 1989,[35] quando cerca de 15% de todas as famílias nos Estados Unidos possuíam um computador pessoal.[36]

A World Wide Web tornou-se publicamente acessível em 1991, antes disponível apenas para governos e universidades.[37] Em 1993, Marc Andreessen e Eric Bina introduziram o Mosaic, o primeiro navegador da web capaz de exibir imagens em linha[38] e a base para navegadores posteriores, como o Netscape Navigator e o Internet Explorer. A Stanford Federal Credit Union foi a primeira instituição financeira a oferecer serviços bancários online a todos os seus membros em outubro de 1994.[39] Em 1996, o OP Financial Group, também um banco cooperativo, tornou-se o segundo banco online do mundo e o primeiro na Europa.[40]

Em 2000, a maioria dos lares dos EUA tinha pelo menos um computador pessoal e acesso à Internet no ano seguinte.[41] Em 2002, a maioria dos entrevistados nos EUA relatou ter um celular.[42]

No final de 2005, a população da Internet atingiu 1 bilhão de usuários[43] e 3 bilhões de pessoas em todo o mundo usavam telefones celulares no final da década. A HDTV se tornou o formato padrão de transmissão de televisão em muitos países no final da década. Em setembro e dezembro de 2006, respectivamente, Luxemburgo e Países Baixos se tornaram os primeiros países a fazer a transição completa da televisão analógica para a digital. Em setembro de 2007, a maioria dos inquiridos nos EUA relatou ter Internet de banda larga em casa.[44] De acordo com estimativas da Nielsen Media Research, aproximadamente 45,7 milhões de lares nos EUA em 2006 (ou aproximadamente 40 por cento de aproximadamente 114,4 milhões) possuíam um console de videogame doméstico dedicado,[45][46] enquanto em 2015 cerca de 51 por cento dos lares nos EUA possuíam um console de videogame doméstico dedicado, de acordo com um relatório anual da indústria da Entertainment Software Association.[47][48]

Em 2012, mais de 2 bilhões de pessoas usaram a Internet, o dobro do número de pessoas que a usaram em 2007. A computação em nuvem se tornou popular no início da década de 2010. Em janeiro de 2013, a maioria dos inquiridos nos EUA relatou possuir um smartphone.[49] Em 2016, metade da população mundial estava conectada[50] e em 2020, esse número aumentou para 67%.[51]

O transístor ou transistor (do inglês transfer varistor: varistor de transferência) é um dispositivo semicondutor usado para amplificar ou trocar sinais eletrônicos e potência elétrica, considera-se inventado em 1947 pelos físicos estadunidenses John Bardeen, Walter Brattain e William Shockley. É composto de material semicondutor com pelo menos três terminais para conexão a um circuito externo. Uma tensão ou corrente aplicada a um par de terminais do transistor controla a corrente através de outro par de terminais. Como a potência controlada (saída) pode ser maior que a potência de controle (entrada), um transistor pode amplificar um sinal. Hoje, alguns transistores são embalados individualmente, mas muitos outros são encontrados embutidos em circuitos integrados. O transistor iniciou a era dos eletrônicos portáteis.[52]

O transistor é o bloco de construção fundamental dos dispositivos eletrônicos modernos e é onipresente nos sistemas modernos. Julius Edgar Lilienfeld patenteou um transistor de efeito de campo em 1926,[53] mas não foi possível construir um dispositivo de trabalho naquele momento. O primeiro dispositivo praticamente implementado foi um transistor de contato pontual inventado em 1947 pelos físicos estadunidenses John Bardeen, Walter Brattain e William Shockley. O transistor revolucionou o campo da eletrônica e abriu caminho para rádios, calculadoras e computadores menores e mais baratos, entre outras coisas. O transistor está na lista de marcos do IEEE em eletrônica,[54] e Bardeen, Brattain e Shockley dividiram o Prêmio Nobel de Física em 1956 por sua conquista.[55] A maioria dos transistores é feita de silício puro ou germânio, mas alguns outros materiais semicondutores também podem ser usados. Um transistor pode ter apenas um tipo de portador de carga, em um transistor de efeito de campo, ou pode ter dois tipos de portadores de carga em dispositivos de transistor de junção bipolar. Comparado com válvula termiônica, os transistores são geralmente menores e requerem menos energia para operar. Certos tubos de vácuo têm vantagens sobre os transistores em frequências de operação muito altas ou altas tensões operacionais. Muitos tipos de transistores são feitos para especificações padronizadas por vários fabricantes.

Antes do advento da eletrônica, os computadores mecânicos, como a Máquina Analítica de 1837, eram projetados para fornecer cálculos matemáticos de rotina e recursos simples de tomada de decisão. As necessidades militares durante a Segunda Guerra Mundial impulsionaram o desenvolvimento dos primeiros computadores eletrônicos, baseados em válvulas de vácuo, incluindo o Z3, o Computador Atanasoff–Berry, o computador Colossus e o ENIAC. A invenção do transistor possibilitou a era dos computadores mainframe (décadas de 1950 a 1970), tipificada pelo IBM 360. Esses grandes computadores, do tamanho de uma sala, forneciam cálculos e manipulações de dados muito mais rápidos do que seria humanamente possível, mas eram caros para comprar e manter, por isso estavam inicialmente limitados a algumas instituições científicas, grandes corporações e agências governamentais. O circuito integrado de germânio (CI) foi inventado por Jack Kilby na Texas Instruments em 1958.[56]

O circuito integrado de silício foi então inventado em 1959 por Robert Noyce na Fairchild Semiconductor, usando o processo planar desenvolvido por Jean Hoerni, que por sua vez estava desenvolvendo o método de passivação de superfície de silício de Mohamed Atalla desenvolvido nos Laboratórios Bell em 1957.[57][58] Após a invenção do transistor MOS por Mohamed Atalla e Dawon Kahng nos Bell Labs em 1959,[59] o circuito integrado MOS foi desenvolvido por Fred Heiman e Steven Hofstein na RCA em 1962.[60] O circuito integrado MOS de porta de silício foi posteriormente desenvolvido por Federico Faggin na Fairchild Semiconductor em 1968.[61] O primeiro microprocessador comercial de chip único lançado em 1971, o Intel 4004, foi desenvolvido por Federico Faggin usando sua tecnologia MOS IC de porta de silício, junto com Marcian Hoff, Masatoshi Shima e Stan Mazor.[62][63]

Em 1976, havia várias empresas competindo para lançar os primeiros computadores pessoais comerciais realmente bem-sucedidos. Três máquinas, o Apple II, o Commodore PET 2001 e o TRS-80 foram lançados em 1977,[64] tornando-se os mais populares no final de 1978.[65] A revista Byte mais tarde se referiu à Commodore, Apple e Tandy como a "Trindade de 1977".[66] Também em 1977, a Sord Computer Corporation lançou o Sord M200 Smart Home Computer no Japão.[67]

A comunicação óptica desempenha um papel crucial nas redes de comunicação e fornece a espinha dorsal de transmissão para as redes de telecomunicações e computadores que sustentam a Internet, a base para a Revolução Digital e a Era da Informação. Gordon Gould inventou o amplificador óptico e o laser, além de também ter fundado a primeira empresa de telecomunicações ópticas, a Optelecom, para projetar sistemas de comunicação. A empresa foi cofundadora da Ciena Corp., o empreendimento que popularizou o amplificador óptico com a introdução do primeiro sistema de multiplexação por divisão de onda densa.[68] Esta tecnologia de comunicação em grande escala surgiu como a base comum de todas as redes de telecomunicações[3] e, portanto, um fundamento da Era da Informação.[69][70]

A principal característica da revolução da informação é o crescente papel econômico, social e tecnológico da informação.[71] A informação é o tema central de várias novas ciências, que surgiram na década de 1940, incluindo a teoria da informação de Shannon (1949) e a cibernética de Wiener (1948). Wiener afirmou: "informação é informação, não matéria ou energia". Este aforismo sugere que a informação deve ser considerada juntamente com a matéria e a energia como a terceira parte constituinte do Universo; a informação é transportada pela matéria ou pela energia.[72] Na década de 1990, alguns escritores acreditavam que as mudanças implicadas pela revolução da informação levariam não apenas a uma crise fiscal para os governos, mas também à desintegração de todas as "grandes estruturas".[73]

Manuel Castells captura o significado da Era da Informação na obra The Information Age: Economy, Society and Culture quando escreve sobre nossa interdependência global e os novos relacionamentos entre economia, estado e sociedade, o que ele chama de "uma nova sociedade em formação". Ele adverte que só porque os humanos dominaram o mundo material, não significa que a Era da Informação seja o fim da história:

"Na verdade, é exatamente o oposto: a história está apenas começando, se por história entendermos o momento em que, após milênios de uma batalha pré-histórica com a natureza, primeiro para sobreviver, depois para conquistá-la, nossa espécie atingiu o nível de conhecimento e organização social que nos permitirá viver em um mundo predominantemente social. É o início de uma nova existência e, de fato, o início de uma nova era, a Era da Informação, marcada pela autonomia da cultura em relação à base material de nossa existência."[74]

Thomas Chatterton Williams escreveu sobre os perigos do antiintelectualismo na Era da Informação em um artigo para The Atlantic . Embora o acesso à informação nunca tenha sido tão grande, a maioria das informações é irrelevante ou insubstancial. A ênfase da Era da Informação na velocidade em detrimento da perícia contribui para uma "cultura superficial em que até mesmo a elite menospreza abertamente, como inúteis, os nossos principais repositórios para o melhor que foi pensado".[75]

No final da década de 1980, menos de 1% da informação armazenada tecnologicamente no mundo estava em formato digital, enquanto em 2007 era de 94% e em 2014 era de mais de 99%.[76]

Estima-se que a capacidade mundial de armazenar informação tenha aumentado de 2,6 exabytes (com compressão ótima) em 1986 para cerca de 5.000 exabytes em 2014 (5 zettabytes).[76][77]

| Ano | Assinantes de telefonia celular (% da pop. mundial) | Usuários da Internet (% da população mundial) |

|---|---|---|

| 1990 | 12,5 milhões (0,25%)[78] | 2,8 milhões (0,05%)[79] |

| 2002 | 1,5 bilhão (19%)[79] | 631 milhões (11%)[79] |

| 2010 | 4 bilhões (68%)[80] | 1,8 mil milhões (26,6%)[50] |

| 2020 | 4,78 bilhões (62%)[81] | 4,54 bilhões (59%)[82] |

| 2023 | 6,31 bilhões (78%)[83] | 5,4 bilhões (67%)[84] |

Em 1945, Fremont Rider propôs uma "lei natural" de expansão das bibliotecas, que dobrariam sua capacidade a cada 16 anos, quando houvesse espaço suficiente disponível.[85] Ele defendeu a substituição de obras impressas volumosas e decadentes por fotografias analógicas em microformato miniaturizadas, que poderiam ser duplicadas sob demanda para usuários de bibliotecas e outras instituições. Rider não previu, no entanto, a tecnologia digital que surgiria décadas depois para substituir a microforma analógica por mídias digitais de imagem, armazenamento e transmissão, por meio das quais grandes aumentos na rapidez do crescimento da informação seriam possíveis por meio de tecnologias digitais automatizadas e potencialmente sem perdas. Assim, a lei de Moore, formulada por volta de 1965, calcularia que o número de transistores em um circuito integrado denso dobra aproximadamente a cada dois anos.[86]

A capacidade tecnológica mundial para armazenar informação cresceu de 2,6 exabytes (EB) ( com compressão ideal) em 1986 para 15,8 EB em 1993; mais de 54,5 EB em 2000; e para 295 EB (com compressão ideal) em 2007.[76][88] Este é o equivalente informativo a menos de um CD-ROM de 730 megabytes (MB) por pessoa em 1986 (539 MB por pessoa); cerca de quatro CD-ROM por pessoa em 1993; doze CD-ROM por pessoa no ano 2000; e quase sessenta e um CD-ROM por pessoa em 2007.[76] Estima-se que a capacidade mundial de armazenamento de informação tenha atingido 5 zettabytes em 2014.[77]

A quantidade de dados digitais armazenados parece estar crescendo de forma aproximadamente exponencial, lembrando a Lei de Moore. Assim, a lei de Kryder prescreve que a quantidade de espaço de armazenamento disponível parece estar a crescer aproximadamente de forma exponencial.

A capacidade tecnológica mundial para receber informações através de redes de transmissão unidirecionais era de 432 exabytes de informação (comprimida de forma otimizada) em 1986; 715 exabytes (comprimidos de forma otimizada) em 1993; 1,2 zettabytes (comprimidos de forma otimizada) em 2000; e 1,9 zettabytes em 2007, o equivalente em informação a 174 jornais por pessoa por dia.[76] A capacidade efectiva mundial para trocar informações através de redes de telecomunicações bidireccionais foi de 281 petabytes de informação (comprimida de forma optimizada) em 1986; 471 petabytes em 1993; 2,2 exabytes (comprimidos de forma optimizada) em 2000; e 65 exabytes (comprimidos de forma optimizada) em 2007, o equivalente em informação a seis jornais por pessoa por dia.[76]

A capacidade tecnológica mundial para calcular informações com computadores de uso geral guiados por humanos cresceu de 3,0 × 108 MIPS em 1986 para 4,4 × 109 MIPS em 1993; para 2,9 × 1011 MIPS em 2000; para 6,4 × 1012 MIPS em 2007.[76] Um artigo publicado na revista Trends in Ecology and Evolution em 2016 relatou que:[77]

A tecnologia digital ultrapassou em muito a capacidade cognitiva de qualquer ser humano e o fez uma década antes do previsto. Em termos de capacidade, há duas medidas importantes: o número de operações que um sistema pode realizar e a quantidade de informações que podem ser armazenadas. Estima-se que o número de operações sinápticas por segundo em um cérebro humano esteja entre 10^15 e 10^17. Embora esse número seja impressionante, mesmo em 2007 os computadores de uso geral da humanidade eram capazes de executar bem mais de 10^18 instruções por segundo. As estimativas sugerem que a capacidade de armazenamento de um cérebro humano individual é de cerca de 10^12 bytes. Em uma base per capita, isso é igualado pelo armazenamento digital atual (5x10^21 bytes por 7,2x10^9 pessoas).

O código genético também pode ser considerado parte da revolução da informação. Agora que o sequenciamento foi informatizado, o genoma pode ser renderizado e manipulado como dados. Tudo começou com o sequenciamento de DNA, inventado por Walter Gilbert e Allan Maxam em 1976-1977 e Frederick Sanger em 1977, cresceu de forma constante com o Projeto Genoma Humano, inicialmente concebido por Gilbert e, finalmente, as aplicações práticas do sequenciamento, como os testes genéticos, após a descoberta pela Myriad Genetics da mutação do gene do câncer de mama BRCA1. Os dados de sequência no Genbank aumentaram de 606 sequências de genomas registradas em dezembro de 1982 para 231 milhões de genomas em agosto de 2021. Mais 13 trilhões de sequências incompletas foram registradas no banco de dados de submissões Whole Genome Shotgun em agosto de 2021. A informação contida nessas sequências registradas duplicou a cada 18 meses.[89]

Eventualmente, a tecnologia da informação e comunicação (TIC) — ou seja, computadores, máquinas informatizadas, fibras ópticas, satélites de comunicação, a Internet e outras ferramentas de TIC — tornou-se uma parte significativa da economia mundial, à medida que o desenvolvimento de redes ópticas e microcomputadores mudou muito muitas empresas e indústrias.[90][91] Nicholas Negroponte captou a essência dessas mudanças em seu livro de 1995, Being Digital , no qual discute as semelhanças e diferenças entre produtos feitos de átomos e produtos feitos de bits.[92]

A Era da Informação afetou a força de trabalho de diversas maneiras, como por exemplo, obrigando os trabalhadores a competir em um mercado de trabalho global. Uma das preocupações mais evidentes é a substituição do trabalho humano por computadores que possam desempenhar as suas funções de forma mais rápida e eficaz, criando assim uma situação em que os indivíduos que desempenham tarefas que podem ser facilmente automatizadas são forçados a encontrar emprego onde o seu trabalho não seja tão descartável.[93]

Juntamente com a automação, os empregos tradicionalmente associados à classe média (por exemplo, linha de montagem, processamento de dados, gestão e supervisão ) também começaram a desaparecer como resultado da terceirização . Incapazes de competir com os trabalhadores dos países em desenvolvimento, os trabalhadores da produção e dos serviços nas sociedades pós-industriais (ou seja, desenvolvidas) perdem os seus empregos através da subcontratação, aceitam cortes salariais ou contentam-se com empregos de baixa qualificação e baixos salários no setor dos serviços.[94] No passado, o destino econômico dos indivíduos estaria vinculado ao de sua nação. Por exemplo, os trabalhadores nos Estados Unidos já foram bem pagos em comparação aos de outros países. Com o advento da Era da Informação e as melhorias na comunicação, isso já não acontece, uma vez que os trabalhadores têm agora de competir num mercado de trabalho global, em que os salários dependem menos do sucesso ou do fracasso das economias individuais.[94]

Ao efetivar uma força de trabalho globalizada, a internet também permitiu maiores oportunidades nos países em desenvolvimento, tornando possível que os trabalhadores nesses locais forneçam serviços presenciais, competindo, portanto, diretamente com seus colegas de outras nações. Esta vantagem competitiva traduz-se em maiores oportunidades e salários mais elevados.[95]

A Era da Informação afetou a força de trabalho, pois a automação e a informatização resultaram em maior produtividade, juntamente com a perda líquida de empregos na indústria . Nos Estados Unidos, por exemplo, entre Janeiro de 1972 e Agosto de 2010, o número de pessoas empregadas em empregos na indústria transformadora caiu de 17,5 milhões para 11,5 milhões, enquanto o valor da indústria transformadora aumentou 270%.[96] Embora inicialmente parecesse que a perda de empregos no setor industrial poderia ser parcialmente compensada pelo rápido crescimento de empregos em tecnologia da informação, a recessão de março de 2001 prenunciou uma queda acentuada no número de empregos no setor. Este padrão de diminuição de empregos continuaria até 2003, e os dados mostraram que, no geral, a tecnologia cria mais empregos do que destrói, mesmo no curto prazo.[97]

A indústria tornou-se mais intensiva em informação e menos intensiva em mão de obra e capital . Isso deixou implicações importantes para a força de trabalho, pois os trabalhadores se tornaram cada vez mais produtivos à medida que o valor do seu trabalho diminui. Para o próprio sistema capitalista, o valor do trabalho diminui, o valor do capital aumenta. No modelo clássico, os investimentos em capital humano e financeiro são importantes preditores do desempenho de um novo empreendimento.[98] No entanto, como demonstrado por Mark Zuckerberg e pelo Facebook, parece agora possível que um grupo de pessoas relativamente inexperientes e com capital limitado tenham sucesso em grande escala.[99]

Seamless Wikipedia browsing. On steroids.

Every time you click a link to Wikipedia, Wiktionary or Wikiquote in your browser's search results, it will show the modern Wikiwand interface.

Wikiwand extension is a five stars, simple, with minimum permission required to keep your browsing private, safe and transparent.