Loading AI tools

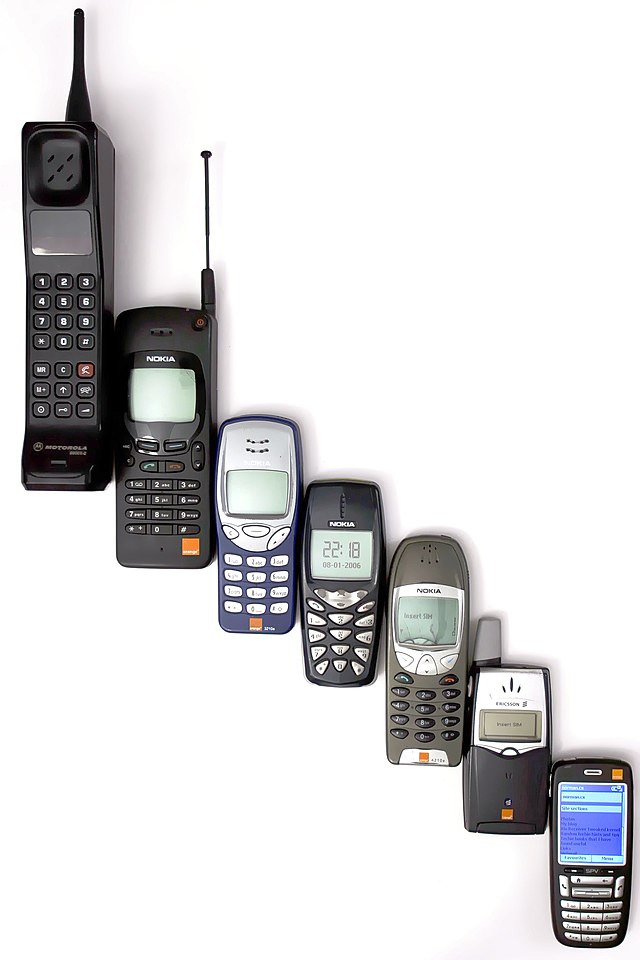

La gestion de l’énergie dans les systèmes embarqués est fondamentale pour leur bon fonctionnement. Le nombre de ces systèmes est en augmentation constante et leurs domaines d’utilisation sont de plus en plus variés. Les contraintes sont très différentes selon que la conception porte sur un capteur environnemental, un téléphone portable ou une sonde corporelle. L’objectif principal peut être une grande longévité, une taille réduite ou encore un fonctionnement sans batterie.

En plus des sources d’énergies utilisables, l'article aborde les méthodes permettant d’analyser la consommation énergétique d'un système et donc de valider que telle méthode est plus efficace que telle autre, dans l’atteinte d'objectifs précis. Deux domaines sont pris en exemple pour pointer le fait que les objectifs peuvent grandement différer en fonction de l'utilisation qui est faite du système embarqué : les téléphones portables et les capteurs corporels.

L'optimisation de la consommation peut être réalisée selon différentes méthodes, dont certaines peuvent même être combinées. L’amélioration peut par exemple se faire au niveau matériel, en pilotant sélectivement certains composants ou périphériques. Des composants particuliers peuvent également être sélectionnés dès la conception, en fonction des objectifs recherchés. L’amélioration peut également être de type logicielle (système d’exploitation, type du code, programmation de l’applicatif…). Beaucoup d’éléments participent à la consommation énergétique, dont certains ne sont pas évidents de prime abord. En fonction de la manière de coder, par exemple, un système peut consommer plus ou moins d’énergie.

Systèmes alimentés par batteries

Les batteries électrochimiques rechargeables type lithium-ion sont utilisées comme source d'énergie dans une grande majorité de systèmes électroniques portables, comme les smartphones, ordinateurs portables ou les tablettes[1],[2]. Elles influent de manière significative sur le temps de fonctionnement et les performances globales des appareils[3],[4].

Selon les prévisions, à l'horizon 2020, 50 milliards d'objets intelligents seront connectés à l'Internet des objets (plus de six fois la population mondiale projetée à l'époque)[5],[6]. La plupart de ces appareils seront alimentés par batterie pour des raisons de coût, de commodité, ou de la nécessité d'un fonctionnement autonome. Le remplacement des batteries à grande échelle étant souvent trop couteux voire irréalisable[6], les appareils IdO devront avoir une longue durée de vie opérationnelle : de quelques jours à plusieurs années en fonction de leur domaine d'utilisation.

L'énergie n'est que l'une des nombreuses ressources nécessaires dans l'informatique des systèmes embarqués. Elle reste cependant la seule ressource périssable, qui, une fois consommée, ne peut être réapprovisionnée que par des actions externes, comme la recharge ou le remplacement de la batterie[3].

La durée de vie d'un système alimenté par batterie est déterminée par la capacité de la source d'énergie (c'est-à-dire la batterie) et l'énergie qui y est puisée par le reste du système[4]. La quantité d'énergie fournie variant de manière significative, en fonction de la façon dont elle est utilisée[7].

La conception de composants à faible puissance (low-power design, ultra-low-power design)[6],[8] permet de réduire consommation énergétique et améliore la durée de vie de la batterie[9]. Cependant, pour vraiment maximiser la durée de vie d'une batterie, une analyse de la source d'énergie et du système qui la consomme est nécessaire[7]. De nombreux modèles ont été développés et permettent de saisir de manière suffisamment détaillée le comportement des batteries[10] et aident les concepteurs de systèmes à concevoir des algorithmes et des stratégies de gestion optimales[11].

Les développements continus dans le domaine de la gestion de l'alimentation (DVFS[12], conceptions hybrides analogiques-numériques...) contribuent eux aussi à cette amélioration[13],[6].

Systèmes à récupération d'énergie

Le principe de la récupération d'énergie (energy harvesting ou energy scavenging) remonte à l'époque de la roue d'hydraulique et du moulin à vent[14],[15]. D'autres approches crédibles, récupérant l'énergie de la chaleur ou des vibrations, existent depuis des décennies. Néanmoins, le domaine a rencontré un regain d’intérêt depuis l'émergence des systèmes embarqués comme les téléphones portables et les réseaux de capteurs sans fils.

Les systèmes à récupération d'énergie sont des solutions qui tirent toute ou une partie de leur énergie de leur environnement. Le point important de cette énergie environnante est qu'elle a beau être potentiellement infinie, il peut y avoir une limite quant à son taux d'utilisation[16].

Les technologies de captage d'énergie environnementale sont multiples : capteurs solaires[17],[18],[19],[20], éoliens[19], piézoélectriques[21] ou tout autre transducteur capable de tirer de l'énergie de son environnement[22],[14]. L'énergie mécanique[14] est probablement la plus répandue et se trouve dans la force du vent, le mouvement des membres, l'énergie potentielle élastique, la vibration ambiante, la rotation d'une roue de voiture, et bien d'autres[23]. Le différentiel thermique peut également être utilisé pour générer de l'électricité. La source la plus étudiée et technologiquement mature est sans doute la lumière[24].

La production d'énergie varie avec le temps, en fonction de conditions environnementales qui échappent généralement au contrôle du concepteur[22]. Les systèmes embarqués utilisant un type particulier de récolte doivent donc être intégrés à des structures (immeuble, maison, serre...) dans lesquelles ce type d'énergie est abondant[25]. Dans certaines situations, si l'appareil est enfoui sous terre ou à l'intérieur des murs, la collecte d'énergie est difficile, mais le transfert d'énergie sans fil peut être effectué. Par exemple, la charge par induction peut être utilisée pour recevoir de l'énergie à partir d'une émission électromagnétique[26],[27]

Dans le cas des systèmes embarqués que l'on peut porter (smartwatch, vêtements connectés) ou implantable (médical), la source d'énergie peut provenir de l'utilisateur lui-même, parfois en complément d'une énergie environnementale disponible[23]. Elle peut par exemple être générée à partir des mouvements[28] ou bien de la chaleur corporelle[29],[30].

En utilisant l'énergie récoltée de manière optimale, le système peut fonctionner dans un mode de neutralité énergétique, consommant uniquement l'énergie qu'il parvient à récolter. Le système peut alors continuer à fonctionner de façon pérenne et n'est limitée que par la longévité du matériel. Un système est dit à fonctionnement neutre lorsque son niveau de performance souhaité peut être maintenu indéfiniment[16],[31]. Cependant, même si la consommation énergétique passait en dessous du seuil de neutralité, la longévité du système n'en serait pas prolongée pour autant[31].

À la différence d'un système d'exploitation généraliste, un système embarqué est conçu pour réaliser une tâche particulière et définie de manière précise. Ainsi, le système embarqué peut être optimisé en fonction de ses contraintes : moindre coût, meilleure performance ou encore consommation énergétique[32]. La consommation énergétique peut être divisée en trois catégories : la consommation liée au captage d'informations, celle liée au traitement des données et enfin celle liée à leur transmission[33].

Concevoir un système embarqué avec une consommation énergétique adaptable nécessite de pouvoir mesurer et ensuite prévoir cette consommation. Le but étant de maximiser les performances du système sans dépasser les limites énergétiques mises à sa disposition[34]. Cette contrainte se nomme aussi le mode neutre en énergie (Energy Neutral Mode)[16],[31].

Mesurer la faible consommation énergétique de systèmes embarqués est une tâche compliquée. Selon Nadir Cherifi et al., les méthodes d’estimation et de mesure peuvent être regroupées en trois catégories : les mesures physiques, les mesures logicielles et les simulations[35]. La conception de systèmes embarqués nécessite des outils dans ces trois catégories pour pouvoir prévoir la consommation avant le prototypage, puis valider ensuite les résultats sur un nombre idéalement limité de prototypes ou d’architectures[7].

En fonction de l’équipement cible, les besoins et les contraintes sont cependant différents. Un téléphone portable a une contrainte de poids et de taille[36]. Un capteur environnemental a des contraintes d’autonomie, de même qu’un capteur corporel mais pas forcément pour les mêmes raisons[37].

Contraintes liées aux Smartphones

La consommation énergétique des smartphones et l'utilisation optimale de l'énergie sont des enjeux majeurs dans la conception de ce type de systèmes embarqués. Ils nécessitent une autonomie énergétique, assurée par l'utilisation de batteries lithium-ion. Cependant, en plus de la performance, la portabilité impose des limitations en termes de taille et de poids qui finalement viendront limiter la taille de la batterie et donc la quantité d'énergie disponible. Les améliorations visant à augmenter la capacité des batteries ne suivant pas le rythme imposé par les améliorations en micro-électronique, différents procédés destinés à augmenter la durée de vie de la batterie sont utilisés, se basant sur des modèles reliant le comportement de la batterie aux conditions de décharges liées aux consommateur d'énergie (CPU par exemple)[36].

L'analyse énergétique via la modélisation est un prérequis essentiel pour comprendre l'impact des applications ou des composants sur un système. En fonction des estimations de puissance générées par un power-model, un plan d'optimisation énergétique peut être développé pour faciliter l'utilisation efficace de l'énergie dans les appareils mobiles[38].

Contraintes liées au Médical et à la Santé

Les capteurs sans fils portables, interconnectés au sein d'un réseau BAN (Body Area Network) sont largement utilisés dans le domaine médical, collectant diverses caractéristiques physiologiques permettant de suivre en temps réel l'état de santé du patient. L'analyse énergétique de ce type de système embarqué est primordiale car elle peut affecter les fonctionnalités de l'ensemble du système[39] et donc avoir un impact direct sur la vie du patient.

La durée de vie de ces dispositifs micro-électroniques, spécialement ceux étant implantés dans le corps est cruciale. Le remplacement ou la recharge de ces dispositifs embarqués induit un coût financier et une gêne supplémentaire non souhaitable pour le patient[37].

De plus, ce type de dispositifs peut également entrainer une hausse de la température corporelle ou des tissus environnants. La consommation d'énergie doit donc être réduite au minimum afin de limiter cette hausse[37].

Méthodes d'analyse de la performance logicielle

Démontré en premier lieu par Tiwari et al., un même logiciel exécuté sur différents modèles de processeurs aboutira à une consommation globale différente sur chaque système[40]. En mesurant le courant utilisé par un processeur lors de l’exécution de chaque tâche ou séquence d’instructions, il est ainsi possible de modéliser et d’évaluer le coût énergétique d’un programme.

Si on regarde le fonctionnement d’un système embarqué, la phase d’émission des informations utilise une quantité d’énergie non négligeable qui doit être prise en compte dans le fonctionnement global du programme[41]. L’analyse de la performance logicielle et les mesures en fonctionnement réel[42] peuvent ainsi aboutir à une décision sur le protocole à utiliser (IPv4, IPv6 ou dérivés[43],[44]), voire à déporter une partie du traitement des informations sur des systèmes disposant de plus d’énergie[45].

Des algorithmes permettent également d’analyser et de prédire de manière précise la consommation d’un système embarqué lors de l’exécution de son code[46],[47].

Méthode d'analyse de la consommation énergétique liée à l'OS

Les systèmes d’exploitation des solutions embarquées sont des éléments critiques d’environnements complexes. Ils sont porteurs de services vitaux pour le système mais ont un fort impact sur l’efficacité énergétique de la solution[48].

Il est important de pouvoir faire la distinction entre la consommation implicite et la consommation explicite. Cette dernière est celle liée au fonctionnement direct du système d’exploitation (exécution de ses fonctions internes), Il est possible d’analyser le cheminement des exécutions et de les classer en fonction de leur rapport efficacité/coût énergétique[49]. La consommation implicite étant celle qui est induite par les interruptions et pauses liées aux éléments externes (planificateurs de tâches, replanification, demande d’interruption sur cause externe…).

Sur les systèmes temps réel, en fonction de l’application utilisée, le système d’exploitation peut générer une plus ou moins grande consommation d’énergie. Des travaux ont démontré qu’une adaptation de l’application peut induire une réduction de la sollicitation de l’OS et donc de la consommation[50].

Des outils d’analyse de consommation liée à l’OS peuvent également permettre le développement et l’amélioration de systèmes d’exploitation à énergie neutre[51].

Méthodes d'analyse de la configuration du cache

La configuration du cache a un lien direct avec les performances et la consommation énergétique du système[52]. Plus la taille de la mémoire cache augmente, moins il y a de défauts de cache (cache miss), ce qui augmente les performances du système et diminue la consommation énergétique du logiciel et de la mémoire. Cependant, l’énergie dissipée par les cache augmente en raison de sa taille[46].

Il est donc primordial d'avoir à disposition des modèles permettant de mesurer l'impact énergétique du cache dans un système embarqué, afin de pouvoir ensuite en minimiser les effets[46],[53],[52].

La configuration du bus et du cache[54] sont interdépendantes[53] et doivent donc être analysées simultanément afin d'évaluer les impacts de l'ensemble des configuration cache/bus pour une application donnée[52].

Méthodes d'analyse du comportement des batteries

Le comportement réel d’une batterie lors de sa charge ou de sa décharge suit une courbe non linéaire, pouvant varier au cours du temps[55]. Développer des frameworks plus proches de la réalité permet de simuler l’état des batteries de manière plus dynamique et de concevoir des systèmes plus robustes et fiables[55]. De la même manière, avoir des modèles plus précis permet de concevoir ou d’optimiser des systèmes répondant à des contraintes telles que le poids ou le volume des batteries[11].

De nombreux modèles mathématiques ont été développés, rendant possible une simulation assez détaillée du comportement des batteries : des modèles physiques permettant de décrire les interactions ayant lieu à l’intérieur même des batteries ; des modèles empiriques, mettant en œuvre des équations au cours d’expérimentations scientifiques ; des modèles abstraits, représentant la batterie comme un système numérique[56], un circuit électrique, un élément d’études statistiques, ou encore des modèles mixtes, offrant des représentations simplifiées des processus physiques à l’œuvre dans les batteries[10].

Dans chaque catégorie, les modèles peuvent être évalués selon quatre critères de base : La précision de la prévision, la complexité de la simulation, le niveau de paramétrage nécessaire et l’utilité du résultat final[10].

Topologie des circuits électroniques

La manière la plus efficace d'améliorer la consommation énergétique d'un système embarqué est de réduire la consommation énergétique de ses composants électroniques (microprocesseurs, mémoire, interface réseau...)[57]. Par exemple, afin de limiter leurs consommations, la plupart des microprocesseurs disposent maintenant de modes basse consommation (ou sleep modes)[57],[58].

La miniaturisation des capteurs sans fil a accéléré la miniaturisation des composants (processeurs, capteurs, batteries). La conception de ces circuits à faible puissance (low energy design) permet l'utilisation de sources d'énergies plus petites et moins onéreuses tout en augmentant la durée de vie du dispositif afin de réduire les coûts lié au remplacement ou à la recharge de la batterie[9].

Pour concevoir des capteurs très basse consommation, il est essentiel de savoir décomposer chaque tâche de manière à minimiser autant que possible le temps de calcul nécessaire. Pour ce faire, le choix de la topologie du circuit et des éléments qui le composent est primordial[8]. La conception de capteurs toujours plus petits, performants et peu coûteux nécessite un effort constant sur chaque décomposition de l’architecture[59].

Dynamic Voltage and Frequency Scalling (DVFS)

L’énergie consommée par un processeur est approximativement proportionnelle à sa fréquence de cadencement et au carré de sa tension[60]. Le DVFS (pour Dynamic Voltage and Frequency Scaling) consiste à adapter dynamiquement les paramètres de fréquence et de tension d’un processeur en fonction des ressources requises à un instant t. Ainsi, lorsque ces ressources ne sont pas utilisées, cette adaptation permet d’optimiser la consommation énergétique[12].

Entrer du texte sur un clavier ne requiert pas nécessairement toute la puissance du processeur. De même, il peut exister des périodes d’inactivité logicielle. Lorsque la puissance maximale d’un processeur n’est pas requise, la consommation moyenne peut être fortement diminuée grâce au DVFS[61]. L’économie d’énergie permet donc d’augmenter le potentiel de calcul du processeur.

Les conditions pour l’implémentation du DVFS sont multiples. L’OS doit d’abord être capable de piloter la fréquence du processeur et ce même processeur doit pouvoir fonctionner sous différentes tensions[62]. Ensuite, il doit exister une régulation continue entre tension et fréquence recherchée[62]. Cette régulation peut être accompagnée de différents algorithmes dont la fonction est de prédire la charge CPU dans un avenir proche. En fonction de la prédiction, une action sur la tension d’alimentation du processeur peut alors être exécutée[63].

Cependant, sur des systèmes temps réel, le DVFS peut générer des dysfonctionnements. Le changement de fréquence du processeur ralenti de fait le temps de calcul et peut engendrer le dépassement de certains compteurs critiques[64]. Pour pouvoir utiliser un algorithme DVFS, les tâches du système doivent pouvoir être planifiées et aucune des tâches en cours ne doit dépasser le délai maximal de calcul autorisé[65]. Les algorithmes DVFS ont donc du être adaptés pour pouvoir fonctionner sans perturbation notable sur les systèmes temps réel[66],[67],[68]. Un autre dysfonctionnement possible a été identifié par Zhu Dakai et al. Il s’agit de l’existence d’un lien entre la méthode DVFS et le taux de fiabilité d’un système embarqué temps réel[69]. Selon lui, réduire la consommation énergétique de systèmes critiques en influant sur la tension ou la fréquence peut avoir un impact négatif sur la fiabilité de ce système.

Dynamic Power Management (DPM)

L’adaptation dynamique de l’énergie est la capacité d’un système à augmenter ou diminuer sa consommation en fonction de caractéristiques extérieures. Dans le cadre de capteurs corporels, par exemple, le système doit être capable de réduire sa consommation lorsque l’utilisateur n’a pas d’activité physique[39]. De la même manière, en fonction de l’énergie disponible, le système doit également être capable d’adapter sa consommation[70], au besoin en décalant les tâches les plus énergivores sur des périodes plus propices[71], voire en basculant le système dans un état moins consommateur d’énergie tout en limitant l’impact sur les performances[72].

Les gains obtenus grâce à cette méthode sont divers et dépendent des buts recherchés. La durée de vie de la batterie peut par exemple être fortement augmentée sans impact sur les performances[73]. En complément d’une adaptation de la consommation, il est possible d’utiliser des systèmes de récupération/génération d’énergie (soleil, mouvements ou encore chaleur corporelle)[74],[37]. La combinaison des deux permet de réduire la taille de la batterie et donc du système embarqué[74].

Condensateurs et supercondensateurs

Avec le développement des capteurs et systèmes sans batterie, le stockage et la gestion de l’énergie en provenance de sources inconstantes sont devenues des questions primordiales[75],[76]. Afin de bénéficier de sources d’alimentations plus stables et donc gérable sur ces capteurs sans batterie, l’utilisation de condensateurs et supercondensateurs s’est répandue[77],[78],[79].

Par rapport aux batteries, les condensateurs présentent le gros avantage d’avoir une durée de vie bien supérieure, en termeq de nombre de cycles de rechargements[80],[79]. Bien que les travaux de Qianao Ju et al. aient aussi pointé des inconvénients sur les supercondensateurs[81], il propose un algorithme pour en diminuer les effets.

Ces composants sont utilisés de différentes manières. Une première méthode est l’utilisation d’un ou plusieurs supercondensateurs pour stocker une charge qui sera directement utilisée selon les besoins du système[78],[79]. Si besoin en utilisant des algorithmes de gestion d’énergie[82]. Ensuite, d’autres condensateurs peuvent être utilisés pour alimenter individuellement des périphériques[77] ou un système de régulation d’énergie[79].

Scratch-Pad Memory (SPM)

L’efficacité énergétique d’un système peut être augmentée en installant des éléments mémoires pilotés par logiciel à l’intérieur des microprocesseurs (on chip memory)[83]. Cette architecture est appelée Scratch Pad Memory (SPM). Une autre mémoire « on chip » existe, appelée mémoire cache. Cependant, comparée à la mémoire cache, la SPM utilise moins d’énergie pour accéder à l’information[84],[85].

Les microprocesseurs utilisent les SPM via différentes techniques. L'un des principes étant d’analyser le code et de stocker l’information là où l’efficacité énergétique sera la meilleure[86],[87]. Des études actuellement menées sur le sujet proposent des méthodes combinant l’utilisation des SPM avec la mémoire cache[88],[89],[90].

Phase Change Memory (PCM)

Une technologie en cours de développement est la mémoire à changement de phase (PCM ou Phase Change Memory). Cette technologie exploite le changement de propriété physique d’un alliage sous un effet Joule (chaleur)[91] : Le matériau change de résistivité (facteur 3 à 4) entre un état dit « cristallin » et un autre dit « amorphe ». La PCM consomme en moyenne moins d’énergie et est plus rapide en lecture qu’une mémoire DRAM. Cependant, des limitations importantes existent : le matériau a une longévité moindre due à l’altération graduelle du matériau lorsqu’on le chauffe pour le changer d’état ; la consommation énergétique est ponctuellement plus importante qu’une DRAM classique en phase d’écriture ; enfin, le délai d’écriture est également plus important qu’avec les DRAM[92]. Les mémoires non volatiles (NVM) dont font partie les PCM sont des technologies prometteuses pour la gestion de l’énergie dans les systèmes embarqués[93]. La comparaison avec les mémoires volatiles sont à l’avantage des NVM[94], même si ces composants ont des inconvénients.

L’une des solutions à ces inconvénients est la limitation du nombre d’écritures. Avant d’appliquer un changement au bit mémoire, une vérification de son état est réalisée. Si l’état actuel est le même que celui à venir, le système ne modifie pas sa valeur[95],[96].

En exploitant l’état transitoire entre le mode cristallin et le mode amorphe, il est également possible de stocker plusieurs valeurs sur un même élément « binaire », soit 3[97] ou 4[98] valeurs. Cependant, bien que la capacité soit augmentée, la longévité de la mémoire est réduite et il faut mettre en place d’autres mécanismes pour l'optimiser.

Une autre méthode consiste à répartir les écritures de manière uniforme sur la surface physique de la mémoire, limitant ainsi l’échauffement localisé du composant[99],[100], qui est la cause de l'altération graduelle du matériau.

Magnetic RAM (MRAM)

Le paragraphe ci-dessous ne cite que deux types de mémoires magnétiques, bien qu'il en existe d'autres[101]. Il s'agit des deux types les plus aboutis pour une version commerciale dans les systèmes embarqués, les autres étant des domaines en développement.

Spin-Transfer Torque MRAM (STT MRAM)

Parmi les mémoires non-volatiles (NVM) prometteuses pour la gestion de l’énergie dans les systèmes embarqués[102] se trouve la STT MRAM, pour Spin-Transfer Torque Magnetic RAM. Pour cette technologie, l’élément contenant l’information binaire est un matériau ferromagnétique réparti en deux couches polarisées, séparée par un isolant. La couche inférieure est polarisée de manière fixe, la supérieure est polarisée par injection de courant en fonction de la valeur binaire recherchée (polarité identique ou contraire à celle de la couche inférieure). La lecture de la valeur se fait en mesurant la résistivité entre les deux couches.

Les techniques actuelles permettent de construire une cellule STT-MRAM avec deux valeurs (SLC, un bit)[102] ou quatre valeurs (MLC, deux bits)[103],[104].

La STT-MRAM consomme peu en moyenne, est rapide en lecture et a une grande longévité. Mais la latence et la consommation en écriture est importante, par rapport à la classique SRAM[102]. Une technique utilisant par exemple deux modes d’écritures différents permet de réduire la latence en écriture[104]. La consommation énergétique lors de l’écriture diminue avec l’évolution des technologies, mais ce seuil se rapproche de celui utilisé pour la lecture des cellules (qui diminue peu)[105]. Ceci provoque des erreurs et des techniques doivent également être développées pour y remédier.

Autre méthode envisagée, qui recoupe également une technique d’un paragraphe précédent : l’utilisation de STT-MRAM comme support de mémoire SPM[106]. L’accès à ce type de mémoire consommant moins d’énergie, une modification des logiciels de gestion de la SPM permettent de réaliser cette architecture, qui peut économiser plus de 50 % de l’énergie consommée par le système.

Une étude menée par Nowak et al. en 2016 a cependant montré des propriétés intéressantes entre tension électrique, durée d’écriture et taille du composant, leur ayant permis de réduire significativement la taille des cellules sans augmenter le taux d’erreur en écriture[107].

Memristor

Son existence fut prédite en 1971[108] mais ce composant n’a été implémenté qu’en 2008[109]. Il n’a pas encore d’application commerciale en l’état actuel des recherches mais promet une formidable avancée dans le domaine des mémoires en ce qui concerne le degré d’intégration, la rapidité d’accès et la faible consommation[110],[111],[112].

Le Memristor ou mémoire résistive (RRAM) est une résistance variable dont la valeur peut être modifiée par l’application d’une tension[110],[113] : L’état logique est déterminé par la valeur de la résistance au moment de la lecture. Les inconvénients de cette mémoire sont une consommation et une latence élevée en écriture. Des recherches sont menées sur ces éléments, apportant des solutions envisageables pour une commercialisation[114], notamment en réduisant la durée de rétention des informations et la tension d'écriture. Mais des phénomènes non maitrisés en limitent pour l’instant le développement[112].

Gestion des I/O

La gestion de la consommation peut passer par la gestion des périphériques qui sont de gros consommateurs d’I/O, et donc d’énergie[115]. Les périphériques étant gérés via des processus, en analysant l’état de ces processus au cours d’intervalles de temps, il est possible d’en déduire l’utilisation ou non d’un périphérique particulier[116]. Sur les systèmes temps réel, l’analyse peut se révéler plus délicate et un autre algorithme peut être utilisé, permettant une prévision plus réactive aux changements du système[115]. Cependant, la méthode proposée par Cheng et al. économise peu ou pas d’énergie sur les systèmes déjà très chargés.

Spécialisation des OS

Les systèmes d’exploitation des solutions embarquées deviennent de plus en plus critiques et doivent subir des adaptations afin de correspondre le plus précisément possible au besoin[117]. Il existe des OS configurables de manière très variée, permettant une utilisation sur plusieurs architectures mais nécessitant des réglages précis[117]. Cependant, le développement peut être orienté pour dédier l’OS à un fonctionnement spécifique, comme les systèmes à énergie neutre[51]. Dans l’exemple cité, l’OS nivelle la criticité de chaque tâche en fonction des ressources qu’elle consomme et le temps de traitement prévu. Les ressources des tâches les moins critiques pouvant alors être ré-allouées en cas de besoin à des tâches affichées comme plus critiques.

Algorithmes de planification

Les algorithmes diffèrent dans la manière d'établir leurs prédictions (nombre d'intervalles utilisés, poids éventuel, méthode mathématique appliquée) ainsi que dans la manière d'adapter ensuite la vitesse processeur. L’un des principes est de découper l’échelle du temps en intervalles, puis d’examiner les tâches qui ont pu être traitées durant chaque période[118]. Selon le résultat de l’analyse, l’algorithme peut décider d’augmenter ou diminuer le nombre de tâches à traiter lors du prochain intervalle en agissant sur la vitesse du processeur[119]. Pour agir sur la fréquence du processeur, l’algorithme charge ensuite l’OS de réaliser la modification[120],[118].

La modification peut être une prédiction de l’état futur ou une adaptation prédéterminée[121]. Cela correspond a une adaptation statique ou dynamique et des études ont comparé leurs effets sur des systèmes réels[122]. Outre le type de l’adaptation, le choix de la longueur des intervalles peut avoir de grandes conséquences sur la consommation[12]. Si l'intervalle est trop courte, la fréquence du processeur devra être élevée pour que les tâches soient traitées en totalité. Si elle est trop longue, le processeur peut devoir fonctionner sans traiter de données, d'où une perte de ressources.

Dans le cas des systèmes à récupération d'énergie, l'énergie électrique disponible change au fil du temps et est limitée par la taille de l'unité de stockage (batterie, condensateur) et du récolteur (panneau solaire par exemple). Des algorithmes de planification permettent au système de décider dynamiquement quand être actif ou passif, afin de fournir la meilleure qualité de service sans gaspiller l'énergie[123].

Optimisation des instructions

Le choix des instructions dans le code peu avoir un impact significatif sur le coût énergétique. Une analyse des coûts énergétiques des instructions d'un processeur 486DX2[124] révèle que les instructions utilisant des paramètres mémoire ont un courant moyen très élevé par rapport aux instructions utilisant des paramètres de registre.

Ce type d'optimisation contribue à la conception de logiciels à faible consommation énergétique, mais leurs impacts sont étroitement liés à une architecture cible donnée[125]. Les optimisations pour un type de processeur utilisées dans un code éco-énergétique peuvent ne pas convenir pour d'autres types de processeurs. Une analyse du niveau d'instruction doit donc être effectuée pour chaque type de processeur utilisé[40],[126].

Optimisation au niveau compilateur

Les appels de procédures sont couteux dans la plupart des architectures. La technique d'inlining des procédures peut aider à améliorer les performances et à économiser l'énergie logicielle en diminuant les surcharges (overhead) associés aux appels et aux retours[46]. Un effet secondaire de l'inlining est l'augmentation de la taille du code. Cette augmentation nécessite en conséquence une taille mémoire plus importante, qui conduira à une plus grande dissipation d'énergie[46].

Les techniques d'optimisations de boucle :

- loop interchange est une technique de transformation de boucle linéaire (linear loop transformations) permettant de réduire de la puissance totale de la mémoire grâce à une meilleure utilisation du cache[127].

- loop unrolling permet d'augmenter le parallélisme des instructions en diminuant ou supprimant les instructions de contrôle[46],[128],[127].

- pipeline logiciel est une technique permettant d'optimiser les boucles d'un programme, de sorte que chaque itération dans la boucle soit formée à partir de séquences d'instructions choisies parmi différentes itérations du code original[128]. Cette technique permet de diminuer le nombre d'initialisations en récupérant les instructions de différentes itérations. Par conséquent, la consommation totale d'énergie diminue.

- loop fission (loop distribution) divise une boucle (loop) contenant plusieurs instructions en plusieurs boucles contenant chacune une partie des instructions d'origines. Cette technique permet une allocation plus fine des banques mémoires et permet de générer des économies d'énergie en désactivant les banques de mémoires inutilisées[129],[130].

- loop fusion combines deux boucles en une seule, ce qui améliore la réutilisation des données, réduisant ainsi l'énergie consommée par la mémoire[130].

Optimisation du code

Dans la plupart des systèmes embarqués, des portions significatives de code sont répétées. Si le logiciel n'est pas écrit efficacement, on peut s'attendre à ce qu'il nécessite un plus grand nombre de cycles, consomme plus de puissance et occupe plus de mémoire[131].

La restructuration du code d'un programme offre le meilleur équilibre entre efficacité énergétique et automatisation. Son impact sur la consommation d'énergie tend à être élevé puisque le travail est effectué avec une vision globale du programme. En outre, les techniques utilisées sont indépendantes de la plate-forme, ce qui les rend facilement portables à différentes architectures[132].

L'interleaving est un mécanisme qui peut réduire la consommation d'énergie dans les systèmes utilisant la mémoire partitionnée, en regroupant les éléments de données de multiples tableaux (array) consultés simultanément en un seul espace de données commun. Ainsi, seuls les modules mémoire contenant des parties des tableaux en cours d'accès ont besoin d'être actifs[133].

Dans des programmes multiprocessus concurrents, des facteurs tels que la communication interprocessus (IPC), la communication de données, les changements de contexte, l'intervention du système d'exploitation peuvent affecter de manière significative la consommation énergétique globale d'une application[134]. Les optimisations proposées par Fei et al. permettent par exemple de réaliser des économies d'énergie allant jusqu'à 37,9 % (23,8 % en moyenne) par rapport aux optimisations traditionnelles des compilateurs[135].

La gestion de l'énergie au niveau de l'application est une source importante d'optimisation énergétique[136],[137],[138],[139].

Les travaux menés par Flinn et al.[140] ont souligné l'importance et la faisabilité de la gestion de l'énergie au niveau de l'application. Leur système surveille l'offre et la demande énergétique. Lorsque l'énergie est abondante, l'application favorise l'expérience utilisateur. À l'inverse, lorsque l'énergie vient à manquer, l'application bascule en mode économie d'énergie. L’économie d’énergie est en moyenne de 36 %. Si l’énergie est suffisante, leur système est cependant capable de s’adapter aux variations d’une autre ressource : la bande-passante. Le système détecte une baisse de débit via un indicateur calculé en interne (nommé "fidélité") puis modifie l’application pour optimiser l’expérience utilisateur[136].

La programmation éco-énergétique (energy-aware programming) est une voie prometteuse suscitant un intérêt croissant[137],[139],[141]. Ces méthodes et techniques permettent de mettre en place des comportements d'application alternatifs en fonction du mode de fonctionnement énergétique.

Eon[137] est un système de programmation éco-énergétique, permettant aux programmeurs de construire des programmes à partir de code écrit dans différents langages. Il permet de faire correspondre simplement des flux de contrôles par rapport à des états énergétiques du système. Eon n'exécute que les flux autorisés par le programmeur pour un état énergétique donné. Ceci permet d’adapter les fonctionnalités du système à chaque mode d’énergie disponible.

Green[138] est un système permettant d'estimer le coût énergétique des boucles et fonctions des programmes. Il permet aux programmeurs de spécifier une perte de QoS maximale qui sera tolérée et fournit des garanties statistiques que l'application répondra à cette cible. Green génère une version d'étalonnage du programme qu'il exécute pour construire un modèle de QoS quantifiant l'impact de l'approximation. Ce modèle est permet ensuite de synthétiser une version approximative du programme qui répondra à une cible de QoS spécifiée par l'utilisateur. Les résultats expérimentaux démontrent que la version verte de ces applications fonctionnent nettement mieux et consomment moins d'énergie avec seulement une petite perte de QoS[142].

ENT[141] est un autre langage de programmation, qui permet de mettre en place une gestion de l'énergie au niveau de l'application, de manière proactive et adaptative. La conception proactive permet aux programmeurs, d'appliquer leurs connaissances de l'application à la gestion de l'énergie, en caractérisant statiquement le comportement énergétique de différents parties du code dans différents modes de fonctionnement. La conception adaptative permet de retarder cette caractérisation jusqu'à l'exécution, ce qui permet de capturer dynamiquement le comportement du programme en fonction de son état, de ses paramètres de configurations, le niveau de la batterie ou la température CPU.

Ce mélange de typage statique ou dynamique permet de réguler, via des erreurs de compilation ou d'exécution, les interactions entre les programmes et éventuellement d'exposer ou éliminer des "bugs énergétiques" (par exemple, un fragment de programme spécifiquement défini pour un mode «batterie haute » mais accidentellement utilisé dans le mode de "Batterie faible").

Différentes études ou enquêtes ont été menées afin de comprendre les interactions entre les utilisateurs et les batteries de leurs ordinateurs portables ou leurs smartphone. Banerjee et al.[143] constate par exemple que la plupart des recharges sont effectuées alors qu'une quantité d'énergie conséquente subsiste et que ces recharges sont la plupart du temps dictées par le contexte (lieu et heure) plutôt que par le niveau de charge restant.

Selon Rahmati et al.[144], une indication de charge inexacte de la batterie d'un smartphone et un affichage insuffisant des informations, conduisent à une sous utilisation des réglages d'économie d'énergie, à une mauvaise exploitation de l'énergie de la batterie et à un mécontentement des utilisateurs.

Wikiwand in your browser!

Seamless Wikipedia browsing. On steroids.

Every time you click a link to Wikipedia, Wiktionary or Wikiquote in your browser's search results, it will show the modern Wikiwand interface.

Wikiwand extension is a five stars, simple, with minimum permission required to keep your browsing private, safe and transparent.