Cociente intelectual

resultado de pruebas que estiman la inteligencia general De Wikipedia, la enciclopedia libre

El cociente intelectual (abreviado CI; y a veces, aunque aceptado por la RAE, erróneamente llamado «coeficiente intelectual»)[1] es un estimador de la inteligencia general, resultado de alguno de los tests estandarizados diseñados para este fin.

Algunos autores como el neurocientífico Adam Hampshire considera que el cerebro humano es lo suficientemente complejo como para medir la inteligencia con un único factor,[2] sin embargo otros autores consideran que éstas pruebas tienen un gran valor predictivo en términos de rendimiento académico o laboral.[3] El paleontólogo e historiador de la ciencia y ex-catedrático de zoología por la Universidad de Harvard, Stephen Jay Gould, cuestionaría los métodos y motivaciones tras los cuales solían fundamentarse las pruebas de inteligencia estandarizadas en su obra La falsa medida del hombre, argumentando la existencia de al menos dos falacias siempre presentes: la cosificación y la tendencia a ordenar en escalas ascendentes variables muy complejas,[4] sumado a un sesgo histórico presente dentro de la Antropología biológica en el trabajo de diversos autores, cuyas investigaciones y conclusiones solían basarse en prejuicios.[5] Además expuso la estrecha y aún presente influencia de la visión determinista-biológica que se tenía sobre las personas relacionada con su inteligencia particular,[6]como también el uso de la craneometría en los primeros intentos de predecir los rasgos de un individuo con base en las medidas de su cráneo.[7] Es a partir de esta idea en donde emerge la posibilidad de cuantificación de una abstracción como bien lo puede ser la inteligencia, varios años antes de la invención del cociente intelectual. Recientemente el ensayista y escritor Nassim Taleb, quien también considera el CI como un ejemplo de pseudociencia, negó su validez estadística en una revista informal.[8]

Como respuesta parcial a estas críticas, las pruebas de inteligencia suelen ser más complejas y aportan otros estimadores, aparte del CI, que es necesario valorar. En un principio, el CI se obtenía dividiendo la edad mental de una persona (obtenida tras la realización de pruebas o test no estandarizados) entre su edad cronológica y multiplicando el resultado por 100. Sin embargo, en la segunda mitad del siglo XX este método fue sustituido por el diseño de pruebas estandarizadas que arrojaban directamente la puntuación de este estimador.

Terminología

Hasta la 22.ª edición del Diccionario de la lengua española de la RAE, publicada en 2001, se recogía el término «coeficiente» con entrada propia,[9] y a partir de marzo de 2012, fecha en la que se incorporan las 1697 modificaciones aprobadas desde septiembre de 2007,[10] la Real Academia Española añadió a la página electrónica del avance de la vigésima tercera edición de su Diccionario, como «artículo enmendado», el término «cociente» (del antiguo cuociente),[11][12] y recogió así el uso que se da en el campo de la psicología en español[13][14] desde al menos 1978.[15] Cabe destacar que, independientemente de uso más propio, los dos términos han coexistido, incluso juntos en una misma página, en varias publicaciones especializadas.[16][17][18]

Historia

Resumir

Contexto

Desde hace muchos años se ha intentado clasificar a las personas en diversas categorías de inteligencia a través de la observación del comportamiento en la vida cotidiana de las personas. Eso ocurría incluso antes de que se inventaran las pruebas de Cociente Intelectual (CI). Esas otras formas de observación del comportamiento siguen siendo importantes para validar las clasificaciones basadas principalmente en los resultados de los exámenes de inteligencia.

El término cociente intelectual fue empleado por primera vez por el psicólogo de la Universidad de Breslavia William Stern, en 1912.[19] Su finalidad fue dar nombre a un nuevo método para puntuar los resultados de las primeras pruebas de inteligencia para niños, desarrollados por Alfred Binet y Théodore Simon a principios del siglo XX. Los psicólogos franceses Alfred Binet y Théodore Simon publicaron, en 1905, la prueba llamada Edad Mental. La puntuación en la escala de esta prueba de Binet-Simon revelaría la edad mental del niño. La medida de la inteligencia consistía en la división de la edad mental entre la edad cronológica y se multiplicaba el resultado por 100, dando como resultado el mencionado cociente.[20] El psicólogo estadounidense Lewis Terman, de la Universidad de Stanford, revisó la prueba de Binet-Simon, y se modificó el nombre por Escala de Inteligencia Stanford-Binet (1916). Se convirtió en la prueba más popular en los Estados Unidos durante décadas.

Aunque aún se emplea habitualmente el término CI para referirse al resultado de una prueba de inteligencia, la puntuación de las pruebas empleadas hoy día, como la Escala Wechsler de Inteligencia para Adultos, se basa en la proyección del rango medido del sujeto en una campana de Gauss formada por la distribución de los valores posibles para su grupo de edad, con un valor central (inteligencia media) de 100 y una desviación estándar de 15. En términos generales, los valores mayores de 100 están por encima de la media, mientras que los valores menores de 100 están por debajo de la media, pero la desviación estándar hace que las personas con puntuaciones entre 85 y 115 se consideren puntuaciones dentro de los márgenes. Por ejemplo, una persona con un CI de 90 está por debajo de la media, pero dentro de la desviación prevista. Además, distintas pruebas pueden tener distintas desviaciones estándar.

Las puntuaciones medias para muchas poblaciones han tendido a subir una media de tres puntos por década desde principios del siglo XX con la mayoría del incremento acumulado en la mitad inferior de la curva de CI; este fenómeno se conoce como efecto Flynn. Existe controversia sobre si este incremento estable se produce por un aumento real de las habilidades intelectuales en dichas poblaciones, o si se debe más bien a problemas metodológicos con las pruebas pasadas o presentes.

Craneometría y antropología física

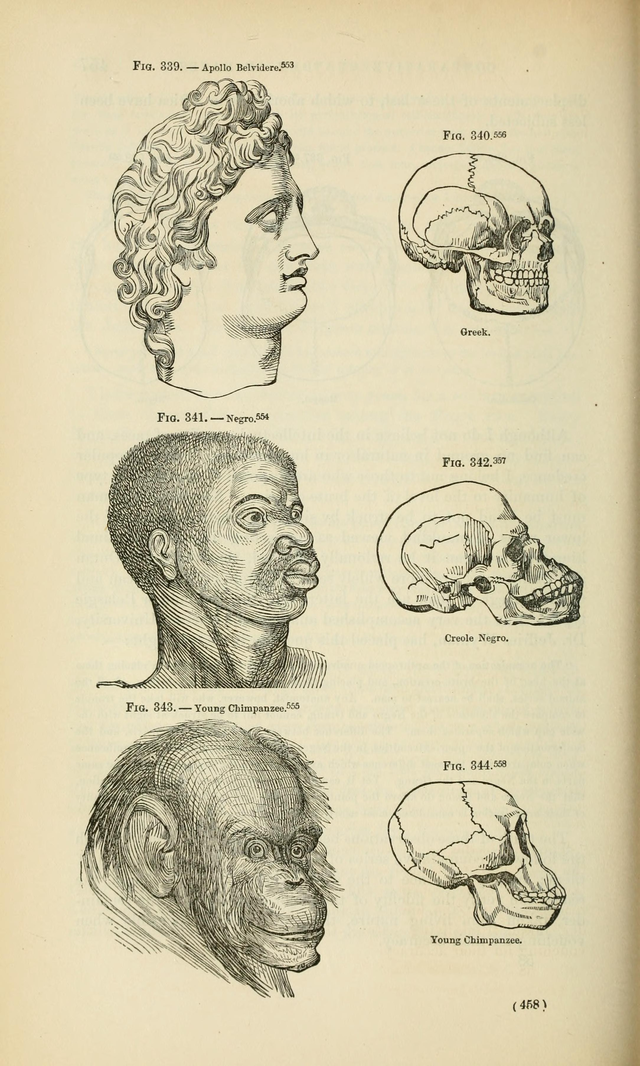

El académico holandés Petrus Camper (1722–89), uno de los primeros teóricos de craneometría, utilizó la "craneometría" (medición del volumen del interior del cráneo) para justificar científicamente diferencias raciales. En 1770, pensó que el ángulo facial podía medir la inteligencia entre las especies de hombres. El ángulo facial se formaba al dibujar dos líneas: una horizontal de la fosa nasal a la oreja; y una vertical de la protuberancia de la mandíbula superior a la de la frente. La craneometría de Camper mostraba que las estatuas antiguas –el ideal grecorromano– tenían un ángulo facial de 90 grados, los europeos lo tenían de 80 grados, los Negros lo tenían de 70 grados y un orangután tenían un ángulo facial de 58 grados. Por lo tanto, estableció una jerarquía biológica racista para la humanidad, por la concepción decadente de la historia. Tales investigaciones racistas científicas fueron continuadas por el naturalista Étienne Geoffroy Saint-Hilaire (1772–1844) y el antropólogo Paul Broca (1824–80).

Samuel George Morton

En el siglo XIX, uno de los primeros antropólogos físicos americanos, médico y poligenista, Samuel George Morton (1799–1851), recolectó cráneos humanos de todo el mundo e intentó hacer un esquema de clasificación lógica. Influenciado por la teoría racial contemporánea, Dr. Morton dijo que podía juzgar la capacidad intelectual racial midiendo el interior de la capacidad craneal por lo que un cráneo grande denotaba un cerebro grande y mayor capacidad intelectual. Opuestamente, un cráneo pequeño denotaba un cerebro pequeño y por lo tanto baja capacidad intelectual; superior e inferior establecido. Después de analizar tres momias de las catacumbas egipcias antiguas, Morton concluyó que los caucásicos y los Negros ya eran diferentes hace tres mil años. Como la Biblia indica que el arca de Noé había terminado en el monte Ararat solo mil años antes de esto, Morton afirmaba que los hijos de Noé no podían explicar el origen de cada raza en la Tierra. Según la teoría de poligénesis de Morton, las razas han sido diferentes desde el inicio.[21]

En Crania Americana de Morton, sus afirmaciones fueron basada en la información craneométrica que los caucásicos tenía los cerebros más grandes con un promedio de 87 pulgadas cúbicas, indígenas americanos estaban en el medio con 82 pulgadas cúbicas y los Negros tenían los cerebros más pequeños con 78 pulgadas cúbicas en promedio.[21]

En La falsa medida del hombre (1981), el historiador científico Stephen Jay Gould argumentaba que Samuel Morton había falsificado la información, quizás accidentalmente sobrellenando algunos de los cráneos para entonces obtener los resultados que legitimizan las presunciones racistas que intentaba demostrar. Un estudio subsecuente por el antropólogo John Michael encontró que la información original de Morton era más precisa que lo que describe Gould, concluyendo que "al contrario de la interpretación de Gould... la investigación de Morton fue conducida con integridad".[22] Jason Lewis y sus colegas llegaron a conclusiones similares a las de Michael en el reanálisis de la colección de cráneos de Morton; sin embargo se alejaron de las conclusiones racistas de Morton agregando que "investigaciones han demostrado que la variación humana moderna es generalmente continua en vez de ser distinta o "racial" y que la mayor variación moderna de humanos es dentro, en vez de entre, poblaciones".[23]

En 1872, Paul Broca, fundador de la Sociedad Antropológica de París (1859), encontró el mismo patrón en las medidas —que Crania Americana reportaba— al pesar muestras de cerebros en autopsia. Otros estudios históricos, que proponen una raza negra –raza blanca, inteligencia– con diferente tamaño de cerebro incluye a aquellos de Bean (1906), Mall (1909), Pearl (1934), y Vint (1934).

La fascinación por los números

En La falsa medida del hombre, Stephen Jay Gould argumentaba que el germen propio del cálculo de la inteligencia provenía de la craneometría, una disciplina que compartía mucho con la frenología, ya que ambas tenían en común el haber reclamado la capacidad de predecir pseudocientíficamente rasgos de personalidad o inteligencia.[7]

Sin embargo, la cuestión real radicaba en determinar una forma de traducir estos hallazgos a datos numéricos legibles, una forma rigurosa de justificar las diferencias intelectuales más allá de simples análisis subjetivos. Sobre este tema Gould escribiría:

Otra corriente, igualmente irresistible, barrió el campo de las ciencias humanas: la fascinación por los números, la fe en que las mediciones rigurosas podrían garantizar una precisión irrefutable, y serían capaces de marcar la transición entre una especulación subjetiva y una ciencia tan válida como la física newtoniana. La evolución y la cuantificación formaron una alianza temible; en cierto sentido, su unión forjó la primera teoría racista "científica" de peso, si, como muchos que se equivocan sobre la verdadera naturaleza de la ciencia, consideramos científica toda afirmación aparentemente respaldada por abundantes cifras. Antes de Darwin, los antropólogos habían presentado datos numéricos, pero la tosquedad de un análisis como el de Morton (Capítulo 2) invalida cualquier pretensión de rigor. Hacia finales del siglo de Darwin, unas técnicas generalizadas y un creciente cuerpo de conocimientos estadísticos habían producido un diluvio de datos numéricos más fidedignos.

Posteriormente añade:

Los principales crancómetras no fueron ideólogos conscientes. Se consideraban a sí mismos esclavos de los números, apóstoles de la objetividad. Y confirmaron todos los prejuicios habituales de los hombres blancos pudientes: que los negros, las mujeres y las clases pobres ocupan puestos subordinados debido a los rigurosos dictados de la naturaleza.[24]

Primeras pruebas de inteligencia y ley de inmigración de 1924

Antes de la década de los veinte, los científicos sociales estaban de acuerdo con que los blancos eran superiores a los negros, pero necesitaban una forma de demostrar esto para poder apoyar las políticas sociales a favor de los blancos. Pensaban que la mejor forma de lograr esto era a través de la inteligencia. Interpretando las pruebas a favor de los blancos, los resultados de los diseñadores de estas pruebas representaban a las minorías de forma muy negativa.[25][26]

En 1908, Henry H. Goddard tradujo la prueba de inteligencia de Binet de francés a inglés y en 1912 comenzó a aplicar la prueba a los inmigrantes que llegaban a Ellis Island.[27] Algunos afirman que en un estudio de inmigrantes Goddard llegó a la conclusión de que el 87 % de los rusos, 83 % de los judíos, 80 % de los húngaros y 79 % de italianos eran débiles mentales y tenían una edad mental menor de 12 años.[28] Algunos también dicen que esta información fue utilizada como “evidencia” por legisladores y por lo tanto afectando la política social por años.[27] Un intérprete presente durante las pruebas de inmigrantes le señaló a Goddard que la prueba era injusta para la gente que no era familiar con el inglés y cultura estadounidense, pero Goddard no estaba de acuerdo.[27] Por el otro lado, Bernard Davis señaló que en la primera oración de su artículo Goddard escribió que los sujetos de estudio no eran miembros típicos del grupo sino que habían sido seleccionados porque se les sospechaba inteligencia por debajo de la normal. Davis ha señalado que Goddard argumentaba que los cocientes intelectuales (CI) bajos de los sujetos se debían probablemente más a factores ambientales que genéticos y que Goddard concluyó que “podemos confiar que sus hijos serán de inteligencia promedio y si son criados bien serán buenos ciudadanos”.[29]

Un factor importante en las pruebas de inteligencia era que muchos de los diseñadores ignoraban al principio del siglo XX el papel del ambiente. Si un grupo de gente recibe mejor educación con más oportunidades que otro grupo entonces era lógico que hubiera una gran diferencia entre los grupos. La mayoría de las minorías no tenían acceso o el dinero para recibir una buena educación durante este tiempo y esto sesgó los resultados de las pruebas de inteligencia para hacer parecer que los blancos eran 'naturalmente' más inteligentes. Esto solo mantenía el problema porque las universidades solo quieren gente inteligente para sus escuelas y por lo tanto los que recibían la mejor educación continuaban su educación mientras que los que recibían menos oportunidades eran catalogados como muy estúpidos para continuar su educación.

En su libro La falsa medida del hombre, Stephen Jay Gould argumentó que los resultados de las pruebas de inteligencia jugaron un papel muy importante en la aprobación de la Ley de inmigración de 1924 que restringía la inmigración a Estados Unidos.[30] Sin embargo, Mark Snyderman y Richard J. Herrnstein, después de analizar el registro del Congreso y la audiencia del comité relacionado con la Ley de Inmigración, concluyeron que "los diseñadores de las pruebas no veían los resultados como favorecedores para políticas de inmigración restrictivas como la Ley de 1924, y el Congreso prácticamente ignoró las pruebas de inteligencia".[31]

Juan N. Franco contestó a los resultados de Snyderman y Herrnstein. Franco afirmó que aunque Snyderman y Herrnstein reportaban que la colección de información de los resultados de las pruebas de inteligencia no fueron utilizadas para aprobar la Ley de inmigración de 1924; los resultados de las pruebas de CI sí fueron consideradas por los legisladores. Como evidencia, Franco señaló el hecho: Después de la aprobación de la ley de inmigración, la información del censo de 1890 se utilizó para asignar cuotas basadas en porcentajes de inmigrantes provenientes de diferentes países. Con base en esta información, la legislatura restringió la entrada de los inmigrantes del sur y este de Europa a Estados Unidos y permitió más inmigrantes del norte y oeste del Europa.

La información del censo de 1900, 1910 o 1920 hubiera mostrado números más grandes de inmigrantes del sur y este de Europa permitidos en Estados Unidos. Sin embargo, Franco señaló que utilizando la información del censo de 1890 le permitía al Congreso a excluir a europeos del sur y este (quienes tuvieron peor desempeño en las pruebas de CI que los europeos del oeste y norte) de los Estados Unidos. Franco argumentaba que el trabajo de Snyderman y Herrnstein sobre este tema no demostraba que las pruebas de inteligencia hayan influenciado o no las leyes de inmigración.[32]

Eugenesia

Stephen Jay Gould describió el libro de Madison Grant The Passing of the Great Race (1916) como "la forma más influencial del racismo científico estadounidense". Desde la década de los veinte hasta la década de los treinta, el movimiento de la higiene racial alemana aceptó la teoría nórdica de Grant. Alfred Ploetz (1860–1940) acuñó el término de Rassenhygiene en Bases de la higiene racial (1895), y fundó la Sociedad Alemana para la Higiene Racial en 1905. El movimiento apoyaba la crianza selectiva, esterilización obligatoria y un seguimiento estricto de la salud pública con eugenesia.

La higiene racial estaba históricamente unida a nociones tradicionales de salud pública, pero con énfasis en herencia—lo que el filósofo e historiador Michel Foucault llamó racismo de estado. En 1869, Francis Galton (1822–1911) propuso sus primeras medidas sociales para preservar o mejorar las características biológicas y más tarde acuñó el término "eugenesia". Galton, un estadístico, introdujo la correlación y análisis de regresión y descubrió una regresión hacia la media. Fue el primero en también estudiar las diferencias humanas y herencia de la inteligencia con métodos estadísticos. Introdujo el uso de cuestionarios y encuestas para obtener información de grupos de poblaciones que necesitaba para sus trabajos genealógicos y biográficos y para estudios antropométricos. Galton también fundó la psicometría, aquella ciencia que mide las facultades mentales, y la psicología diferencial, una rama de psicología enfocada en las diferencias psicológicas entre personas en vez de características en común.

Como el racismo científico, la popularidad de la eugenesia creció a principios del siglo XX, y ambas ideas influenciaron las políticas raciales nazi y la eugenesia nazi. En 1901, Karl Pearson (1857–1936) y Walter F. R. Weldon (1860–1906) fundaron la revista científica Biometrika la cual promovía la biometría y análisis estadísticos de herencia. Charles Davenport (1866–1944) estuvo involucrado brevemente en la revista. En Race Crossing in Jamaica (1929), dio argumentos estadísticos diciendo que el mestizaje conducía a degradación biológica y cultural. Davenport estaba conectado a la Alemania nazi antes y durante la Segunda Guerra Mundial. En 1939, escribió una contribución al festschrift para Otto Reche (1879–1966), quien se volvió una importante figura en el plan de eliminar a las poblaciones consideradas "inferiores" del este de Alemania.[33]

Aclaración de la UNESCO

El antropólogo estadounidense de origen suizo Alfred Métraux, dirigente de la organización, le encargó a Claude Lévi-Strauss un ensayo que se convertiría en su célebre obra Raza e Historia. Publicada en 1952 constituirá un punto de inflexión fundamental sobre el tema al hacer de la raza un concepto totalmente ilegítimo para pensar las diferencias humanas: solo existe una raza, la raza humana,[34] con sus diferencias culturales.[35] A partir de entonces el término «raza», si es que se utiliza, se entenderá como una categoría social y no como un hecho natural.[35] En La cuestión racial (1950), la UNESCO[36] afirmó:

"Ahora es reconocido generalmente que las pruebas de inteligencia no pueden diferenciar con seguridad entre lo que es debido a capacidad innata y lo que es producto de influencias del ambiente, práctica y educación".[37]

Acuerdos de la Asociación Psicológica estadounidense acerca de la inteligencia

En 1994 se publicó una declaración en el Wall Street Journal con 25 puntos básicos sobre el estudio científico de la inteligencia, suscrito por más de 50 científicos de diferentes procedencias.[38] El objetivo de esta publicación fue contrarrestar los equívocos y mitos difundidos por los medios de comunicación tras la publicación del libro The Bell Curve, acusado de carecer de base científica en alguna de sus afirmaciones. A continuación, algunos de los acuerdos referentes al cociente intelectual (CI) que se propusieron como puntos sobre los que continuar el debate:

- La inteligencia no es lo mismo que el conocimiento, sino una capacidad general que permite resolver problemas, razonar, planificar, pensar de modo abstracto, comprender ideas complejas y aprender de la experiencia.

- La inteligencia se puede medir a través de los tests, que constituyen un método fiable y preciso de medición.

- Existen tests de muchos tipos, pero todos miden lo mismo. Algunos son culturalmente mediatizados (requieren de un aprendizaje o conocimiento previo específico) y otros contemplan conceptos "universales" no mediatizados.

- La distribución según el rendimiento en los tests se representa mediante una distribución estándar, en la que la mayor parte de las personas se encuentran alrededor de los valores centrales (CI=100); pocas se alejan mucho por encima o por debajo de este valor central.

- Los tests no presentan sesgos culturales que perjudiquen a determinadas etnias.

- El nivel intelectual se relaciona con el rendimiento en ámbitos sociales, educativos u ocupacionales.

- Un nivel intelectual alto facilita el desempeño de las actividades cotidianas (aumentando su importancia en tareas complejas), pero no garantiza el éxito o fracaso en la trayectoria vital.

- Las diferencias de rendimiento académico no dependen únicamente del CI, pero la inteligencia suele ser el factor más importante.

- La herencia de la inteligencia oscila entre 0.4 y 0.8 de correlación (escalado de 0 a 1), habiendo una importante influencia del ambiente.

- Aún se desconoce cómo manipular la inteligencia de forma permanente.

- Las diferencias étnico-raciales son significativas en un mismo nivel socioeconómico, pero se desconoce la causa.

- Se detecta un incremento de los resultados de las pruebas de inteligencia con el paso de los años debido a diversos efectos ambientales. A este fenómeno se le denomina Efecto Flynn.

Es importante considerar la fecha y la geografía en la que se plantean estas cuestiones (sociedad norteamericana a finales de los años 90), por lo que su generalización ha de hacerse con cautela. El informe expuso, además, una serie de interrogantes sin respuesta que supuso buena parte de la agenda de investigación científica sobre la inteligencia del siglo XXI. Entre estas encontramos los «mecanismos de influencia de los genes sobre la inteligencia», «la explicación del aumento de la influencia genética con la edad», «cuáles son los factores ambientales más influyentes, el papel que juega la nutrición o la escolarización en el nivel de inteligencia o por qué hay diferencias en las puntuaciones medianas entre diferentes grupos sociales».

Genética y ambiente

Resumir

Contexto

Heredabilidad de la inteligencia

Entendemos la heredabilidad del CI como la proporción de varianza en un rasgo que es atribuible al genotipo dentro de una población definida en un ambiente específico. La heredabilidad mide cuánto de esa variación está causada por la genética, y los valores que obtenemos son variables a lo largo de nuestra vida, ya que confluyen directamente con los efectos ambientales.[39] La cifra oficial para la heredabilidad del CI según un informe por parte de la American Psychological Association, es de 0.45 para niños y se eleva alrededor de 0.75 para adolescentes y adultos.[40][41] Por lo tanto la heredabilidad adquiere importancia a medida que envejecemos, y no al revés, como podríamos pensar si tenemos en cuenta la experiencia y el aprendizaje. No obstante, los miembros de una familia tienen aspectos ambientales en común. Este entorno compartido representa entre 0.25 y 0.35 de la variación del cociente intelectual en la etapa infantil; posteriormente, al pasar a la adolescencia, este valor tiende a 0.[42][43][44]

El entorno

Según William Dickens y James R. Flynn los genes en un CI alto inician un ciclo de retroalimentación del individuo con el entorno, donde los niños con mayores capacidades mentales buscan entornos más estimulantes que acaban aumentando su CI. El efecto Flynn puede explicarse por estos motivos relacionando el aumento del estímulo ambiental con la subida en la media general del CI.[45][46]

Factor G

Resumir

Contexto

Hoy en día los diferentes tipos de test de inteligencia se basan en diferentes marcos teóricos y concepciones de la inteligencia. Sin embargo, es común que estas herramientas de medida incluyan puntuaciones sobre ámbitos de competencia específicos (lenguaje, inteligencia espacial, etc.) en varios niveles de abstracción, y que ofrezcan también un Factor G, como valor que resume la inteligencia general del individuo.[47]

En 1904 el psicólogo británico Charles Spearman hizo el primer análisis factorial de las correlaciones entre las medidas de la capacidad cognitiva. Spearman observó que las calificaciones de rendimiento de los niños en las materias aparentemente no relacionadas estaban positivamente correlacionadas con el resto de las asignaturas. A partir de esta observación destacó que estas correlaciones reflejaban la influencia de una capacidad mental general en otras tareas no relacionadas con la escuela. Así se creó un modelo explicativo sobre la inteligencia llamado teoría bifactorial de inteligencia. Esta teoría plantea la existencia de un factor general (Factor g) de la capacidad cognitiva y unos factores específicos (S), que se entienden como habilidades y aptitudes que están presentes en ciertos ámbitos de la vida. Estos dos componentes se consideran diferentes, pero no independientes, ya que el Factor G es el más importante, tiene una acción genérica en las capacidades cognitivas individuales. Sin embargo, este punto de vista no es universalmente aceptado; existen otros modelos de inteligencia humana.[cita requerida]

Los modelos de inteligencia de hoy en día se representan como una jerarquía de tres niveles, donde en la parte inferior se sitúan las aptitudes primarias (rendimiento), en la parte intermedia se encuentran las secundarias (percepción visual y auditiva, velocidad cognitiva, Inteligencia Cristalizada e Inteligencia Fluida, entre otras) y, finalmente, en la cima se encuentra el Factor G, denominado Inteligencia General.

Actualmente el campo de investigación de genética conductual ha establecido que el Factor G es de carácter hereditario y dependería fundamentalmente de la carga genética.

Pruebas

Resumir

Contexto

La psicometría es la disciplina científica que forma parte de la metodología de las ciencias del comportamiento y está relacionada directamente con el campo de la medición psicológica. Es una disciplina cuyo objeto es medir los aspectos psicológicos de una persona, como, por ejemplo, los rasgos de la personalidad, las habilidades, las capacidades mentales, el conocimiento general y la actitud. Tradicionalmente, las pruebas de medidas de inteligencia han sido criticadas por estar mediatizadas culturalmente. Es decir, se creía que tenían una importante carga cultural que requería un aprendizaje previo de los sujetos. En la actualidad, tienden a ser culturalmente imparciales.[48]

Las primeras pruebas psicométricas se construyeron para medir la inteligencia mediante procedimientos que evaluaban el cociente intelectual de los individuos, una medida que se suponía aproximada al constructo de la inteligencia. Generalmente, las medidas se obtienen a través de técnicas estadísticas basadas en la correlación, como el análisis factorial o la regresión lineal.[49] A nivel práctico, la psicometría hace uso intensivo sobre todo de cálculos y análisis estadísticos, asignando los números e identificando los atributos físicos y psicológicos. Se consideran las pruebas de dificultad y temática variable que miden la capacidad de ejecución de una tarea mediante una puntuación. Entre ellas, se encuentran analogías verbales, rotación u orientación espacial, cálculo numérico y conocimiento del lenguaje.[50]

En la actualidad existen diversas pruebas que permiten obtener una medida de aptitudes de nivel general o global de inteligencia: test de Stanford-Binet, escalas de Wechsler, escalas de McCarthy, test de Matrices Progresivas de Raven, test de Dominos, K-ABC, DAT-5, test de Factor G.[51]

- Test del Dominó o Test D-48[3]

El Test del Dominó un test que mide el Factor G (general) de la inteligencia a través de pruebas lógicas. Esta técnica es resultado de la Teoría bifactorial de Spearman, pues ello es lo que dio lugar al concepto de inteligencia general, la cual mide dicho test.

Fue Edgar Anstey, influido por el test de matrices progresivas de Raven, el que realizó este test en 1944 mediante fichas de dominó. El test del Dominó es una prueba no verbal que evalúa el nivel de abstracción, comprensión y deducción de una persona.

Este test consta de 48 ítems clasificados en 8 páginas, cada una de ellas referidas a un principio:

- Página 1 referida a la simetría.

- Página 2 referida a la alternativa

- Página 3 referida a la progresión simple

- Página 4 referida a la asimetría

- Página 5 referida a la progresión circular

- Página 6 referida a la progresión compleja

- Página 7 referida a la combinación de principios previos

- Página 8 referida a la adición y sustracción.

Cada una de estas páginas contiene una serie de fichas de dominó, una de ellas en blanco, la cual debe ser deducida por el paciente mediante la lógica y el orden. La dificultad de este test es progresiva y suele durar en torno a media hora.

Una vez realizado el test al individuo, se deberá interpretar los resultados obtenidos a través de una tabla de baremos, los cuales comparan los resultados mediante percentiles y eneatipos, según los resultados obtenidos se estará en un percentil concreto, el cual pertenece a un eneatipo determinado.

Mediciones: rangos y puntajes del CI

Resumir

Contexto

En la actualidad, las puntuaciones de CI se usan en muchos contextos distintos: predictivos de rendimiento escolar, indicadores de necesidades especiales educativas, predictivos de rendimiento laboral, o por parte de sociólogos que estudian la distribución de la inteligencia en poblaciones y las relaciones entre la inteligencia y otras variables. Algunos pedagogos y psicólogos presentan la siguiente clasificación para describir diferentes niveles de superdotación intelectual, con el CI como punto de referencia:[52][53]

Capacidad cognitiva nula CI 0-4

Menos del 0,000 001 % tiene tal CI. La persona con este trastorno no sabe leer, ni hablar, ni comunicarse ni mucho menos escribir. Necesita una ayuda psicológica. La mayoría fueron y son ejemplo de los llamados "niños salvajes", quienes fueron y son criados al margen de la sociedad en ciertos países.

Discapacidad cognitiva profunda CI 5-19

Incluye aproximadamente al 1-2 % de las personas con discapacidad cognitiva. La mayoría de los individuos con este diagnóstico presentan una enfermedad neurológica identificada que explica su discapacidad cognitiva. Durante los primeros años, desarrollan considerables alteraciones del funcionamiento sensorio motor. Puede predecirse un desarrollo óptimo en un ambiente altamente estructurado con ayudas y supervisión constantes, así como fijando una relación individualizada con el educador. El desarrollo motor y las habilidades para la comunicación y el cuidado personal pueden mejorar si se le somete a un adiestramiento adecuado. Algunos de ellos llegan a realizar tareas simples en instituciones protegidas y estrechamente supervisados.

Discapacidad cognitiva grave CI 20-34

Incluye el 3-4 % de los individuos con discapacidad cognitiva. Durante los primeros años de la niñez, la adquisición de un lenguaje comunicativo es escasa o nula. Durante la edad escolar, pueden aprender a hablar y pueden aprender habilidades elementales de cuidado personal. Se benefician solo limitadamente de la enseñanza de materias pre académicas como la familiaridad con el alfabeto y el cálculo simple, pero pueden dominar ciertas habilidades como el aprendizaje de la lectura global de algunas palabras imprescindibles para su autonomía e independencia. Los adultos pueden ser capaces de realizar tareas simples estrechamente supervisadas en instituciones. En su mayoría se adaptan bien a la vida en la comunidad, a no ser que sufran alguna discapacidad asociada que requiera cuidados especializados o cualquier otro tipo de asistencia.

Discapacidad cognitiva moderada CI 35-54

La discapacidad cognitiva moderada equivale aproximadamente a la categoría pedagógica de «moldeable». Este grupo constituye alrededor del 10 % de toda la población con discapacidad cognitiva. Adquieren habilidades de comunicación durante los primeros años de la niñez. Adquieren una formación laboral y, con supervisión moderada, pueden adquirir destrezas para su propio cuidado personal. También pueden beneficiarse de corrección en habilidades sociales y laborales, pero es improbable que progresen más allá de un segundo nivel en materias escolares. Pueden aprender a trasladarse independientemente por lugares que les son familiares. En su mayoría son capaces de realizar trabajos no cualificados o semicualificados, siempre con supervisión, en talleres protegidos o en el mercado general de trabajo. Se adaptan bien a la vida en comunidad, usualmente en instituciones con supervisión.

Discapacidad cognitiva leve CI 55-69

Se denomina así a las personas que transitan la “etapa educable”. Son alrededor del 87 % de las personas afectadas por el trastorno. Suelen desarrollar habilidades sociales y de comunicación durante los años preescolares (0-5 años). Tienen insuficiencias mínimas en las áreas sensoriomotoras y con frecuencia no se diferencian de otros niños sin discapacidad cognitiva hasta edades posteriores. Adquieren habilidades sociales y laborales adecuadas para una autonomía mínima, pero pueden necesitar supervisión, orientación y asistencia, especialmente en situaciones de estrés social o económico desusado. Contando con apoyos adecuados, los sujetos con discapacidad cognitiva leve viven sin inconvenientes en la comunidad, sea independientemente, sea en establecimientos supervisados.

Inteligencia límite CI 70-84

Una de cada nueve personas ocupa este rango. Opuestamente a la inteligencia brillante, el retraso presenta características propias de él: Estar debajo de la media en adultos también es responsable de que algunos niños fracasen escolarmente. Solo es un retraso ligero, por lo que no debe ser confundido como asincrónico. Tiene a más de 2/7 de la población mundial en este rango, correspondiéndose opuestamente con la llamada "inteligencia brillante" (CI = 115-129).

Debajo de la media CI 85-99

Presentan una inteligencia debajo del valor de 100, pero en la mayoría de los casos no es perceptible tal diferencia, sobre todo porque la mayoría de las personas se acercan al valor medio. No presentan problemas durante su infancia, ni dificultades para integrarse en general. Un poco menos del 12 % de la población mundial se sitúa en este estatus.

Media de cociente intelectual establecida CI 100

La mayor parte de la población se encuentra en este rango tal y como nos muestra la gráfica de la campana de Gauss. Es un valor no absoluto en la gran escala. No absoluto porque ese mismo valor aumenta 3 puntos por década, para que dé siempre valores de 100. La razón de esto es que el progreso y el desarrollo en el mundo están haciendo que progresivamente muchas sociedades asciendan en la estratificación, salgan del estatus de pobreza, no sufran hambrunas ni desnutrición, enfermedades, entre otras cosas, que hacen que la inteligencia promedio del ser humano aumente paulatinamente, consecuentemente trae el cambio. De todas formas, es como el punto intermedio entre el retraso, el trastorno mental y las clases de superdotación intelectual. Es el punto medio en el que se basa toda la escala. Por ejemplo: Una persona tiene 15 años recién cumplidos y sabe que tiene la misma cantidad de edad mental. El resultado sale solo: 15/15=1. Y ahora hay que multiplicarlo por 100, debido a que es el valor medio del cociente. 1 × 100 = 100. Es decir, que esa persona tiene equilibrio entre su edad biológica y su edad mental. Suelen ausentarse de problemas psicológicos y además no tienen problemas de sueño: Duermen 9 horas diarias. Casi el 3 % de la población tiene 100 de CI, teniendo en cuenta que la escala se extiende desde 0 (IQ nulo) hasta 201 (máximo probable en escala de Stanford-Binet, contando el máximo de rareza de uno en siete mil millones de habitantes).

Encima de la media CI 101-114

Es un rango que alcanza aproximadamente a 3 de cada 10 personas. Corresponde a una persona con una capacidad que no es notablemente detectable como "más inteligente", pero sí es un valor significativo, sobre todo cuanto más se avanza en la escala.

Inteligencia brillante CI 115-129

Se corresponde con aproximadamente el 13 % de las personas. Presenta una inteligencia superior a los demás. La mayoría de las profesiones y roles de desempeño están en este rango.[54] La media para la mayoría de las personas con licenciaturas de más alto desempeño intelectual en el mundo occidental ronda alrededor de los 125 puntos de cociente intelectual.[55]

Superdotación intelectual CI 130-144

Véase también: Superdotación intelectual

Se denomina superdotados a aquellos que poseen un cociente intelectual igual o mayor que 130 (generalmente), y se encuentran por encima del 98 % de la población. Es decir, que su resultado se encuentra en la parte derecha más extrema de la curva de resultados (que forma una campana de Gauss). Es la contraparte de la asincronía mental, junto con las discapacidades cognitivas anteriormente mencionadas. Este grupo lo engrosan también gran número de personas con licenciaturas, gobernantes y empresarios. Sin embargo, a este rango empiezan a pertenecer los científicos de élite del mundo occidental. Inician problemas de comunicación entre la emisión y recepción de ideas, emociones o mensajes con quienes distan más de 15 puntos en la escala; derivados de la diferencia en la manera de pensar, de igual manera comienzan los problemas sociales al no lograr comprender el comportamiento inconsistente e insensato de quienes están por debajo de su nivel, así como el inicio de afecciones y reacciones emocionales e inmunológicas, como ansiedad, TDAH, depresión, alergias, celiaquía y otros trastornos inmunitarios.

La media que calculó Roe en el año 1952 fue de 152 puntos de CI, pero desde entonces y tras el efecto Flynn, la media actual de los científicos de élite estadounidense caería dentro de este rango, y ahora es de 136 puntos.[56][57] Haciendo una corrección actualizada del efecto Flynn acontecido desde su publicación la media del CI de los 301 genios de la humanidad estimados por Catherine Cox en 1926 también caería en este rango tanto en la escala Wechsler (15SD) como Stanford-Binet, quinta revisión (SB5 16SD).

Genialidad intelectual CI 145-155

Se denomina genios a aquellos que poseen un cociente intelectual igual o mayor que 145 (generalmente), y representa el 0.1 % (1 de cada 1000) de la población. Es decir, que su resultado se encuentra en la parte derecha más extrema de la curva de resultados (una campana de Gauss). Es el límite que distingue al profesionista común de más alto rango intelectual de la media entre los científicos y los genios socialmente incomprendidos. Simonton y David Wechsler apuntan que alrededor de los 145 puntos de CI empieza a emerger una forma radical de pensar con respecto a los demás grupos, a la par que se incrementan otro tipo de problemas psicológicos derivados.[58]

Inteligencia superior CI 156-174

Véase también: Altas capacidades intelectuales

Tiene una rareza en la escala de inteligencia Stanford-Binet, cuarta revisión, (SB4 16SD) de uno de cada tres mil quinientas personas (0.03 % de la población).[59] Este grupo se caracteriza por una forma radicalmente distinta de pensar, y suelen padecer problemas como el síndrome de bajo rendimiento académico o laboral, el síndrome de disincronía, así como problemas emocionales o trastornos de personalidad. Sin embargo, esto es probable que sea el efecto y no la causa, pues debido a su rareza y lejanía con respecto a la media es difícil que la mayoría comprenda su forma de pensar.[58] Para Simonton tal fenómeno se debe a que cuando hay una diferencia de 20 puntos de CI entre el emisor y el receptor no habrá un entendimiento pleno.[58]

Inteligencia excepcional CI 175-189

A tal inteligencia solo llega una de cada 700 mil personas en todo el mundo (SB4 16SD).[59] Por tal razón, es posible que hasta la persona pueda empezar a leer por debajo de los tres años. Generalmente, puede aprender idiomas con relativa facilidad, y tiene un gran dominio del lenguaje propio. Es un don poseer tamaño intelecto. Las personas sienten grandes emociones, y son muy sentimentales a la hora de enfrentarse a ciertas situaciones. Llegan a un rendimiento escolar de alrededor de 96/100, y en la etapa educable su inteligencia es muy destacable como "honorífica".[cita requerida]

Inteligencia profunda CI 190-201

Aproximadamente, una persona de cada 18 millones es capaz de llegar a tan alta puntuación (SB4 16SD).[59][n. 1] Es una inteligencia muy superior, pero así también es difícil llegar a este rango: aproximadamente, 0.00000005 % de personas de todo el mundo tienen tal cociente.[59]

CI mayor a 201

Cifras mayores a este número son improbables o posiblemente un bulo, pues la rareza para 201 en la escala Stanford-Binet (SB4 16SD) o 195 en la escala Wechsler (15SD) es de una en ocho mil millones de personas, y la humanidad apenas supera esta cantidad.[59][60][61][n. 2][n. 3]

Sin embargo, se estima que en este CI se encuentran personas con historias muy interesantes, como William James Sidis, Marilyn vos Savant y Christopher Hirata.

Impacto social

Resumir

Contexto

Rendimiento académico y CI

A lo largo del periodo académico, desde la primaria hasta los cursos de postgrado, existe una relación entre el rendimiento de los alumnos y sus puntuaciones en las pruebas de CI. Se observa que esta relación disminuye en intensidad a lo largo del tiempo: • 6-12 años (primaria): la correlación es de 0.7 • 12-18 años (secundaria): la correlación pasa a ser 0.5 • 18- 22 años (universidad): se observa un descenso a 0.4 • Más de 22 años (postgrado): la correlación disminuye hasta 0.3.[62]

Sin embargo, educadores como Julián De Zubiría Samper argumentan que las capacidades intelectuales en realidad tienen una menor participación a la estimada por Lewis Terman en la determinación del éxito académico:

El Estudio Terman concluyó que la población de CI muy superior tendía a tener éxito académico y que el CI correlacionaba en un 0,5 con el rendimiento académico. Este es el cuarto de los mitos que hay que develar: la supuesta correlación entre CI y rendimiento académico.

El propio Terman, al final de su vida, tuvo serias dudas al respecto y de manera autocrítica llegó a afirmar que variables de tipo emocional e interpersonal tenían un impacto alto en la determinación del éxito académico de un individuo.

Los estudios mundiales actuales (Freeman, 2001; Terrassier, 2002; Benito y Alonso, 1996) y las propias conclusiones del IAM, permiten estar más de acuerdo con las tesis finales de Terman que con las conclusiones obtenidas años atrás.

Nuestras propias investigaciones nos permiten concluir que, antes que el CI, en el rendimiento escolar de un estudiante tienen un papel mucho más importante la autonomía, el interés, la creatividad, la reflexividad y la resonancia familiar y escolar (De Zubiría y Ramírez, 2005). Después de realizar más de 2000 correlaciones en la propia institución entre los años 2000 y 2004, podemos concluir que la correlación entre CI y rendimiento académico es prácticamente nula. De las múltiples correlaciones realizadas entre el IQ y el rendimiento académico en el IAM, el 95 % de ellas arrojaron correlaciones nulas (De Zubiría y Ramírez, 2005).[63]

Rendimiento laboral y CI

La validez del CI como predictivo del desempeño laboral es superior a cero para todos los trabajos estudiados hasta la fecha, pero varía con el tipo de trabajo (de un 0.2 a un 0.6). El CI está más relacionado con el razonamiento y menos con la función motora; los puntos en pruebas de CI predicen las calificaciones de desempeño en todas las ocupaciones. Para las actividades altamente calificadas, las puntuaciones de CI más bajas son más propensas a encontrar obstáculos laborales, pero no ocurre así en actividades mínimamente calificadas donde tendría más peso el rendimiento motor (fuerza, resistencia, coordinación…).[64][65][66]

Actualmente son más utilizados los test de habilidad y de personalidad que los de Cociente Intelectual en las pruebas psicométricas de empleo.

Criminalidad y CI

Arthur Jensen, en su libro The g Factor: The Science of Mental Ability (1998), cita datos estadísticos que sugieren que, independientemente de clase social, la "raza" o las disfunciones familiares, las personas con CI entre 70 y 90 tienen índices de criminalidad más altos que las personas con cociente intelectual por debajo o por encima de este rango. Además, se explica que el fracaso escolar manifiesta una alta correlación con la conducta delictiva, siendo uno de sus mejores predictores.[67]

El informe de 1995 de la Asociación Estadounidense de Psicología (APA), conocido como «Intelligence: Knowns and Unknowns», indicó que la correlación entre CI y la delincuencia es de –0.20. Eso significa que la varianza explicada es menor al 4 % y los vínculos causales pueden ser indirectos.[68]

Cabe aclarar que la idea de características propias innatas de los criminales proviene de una vieja concepción dentro de la antropología criminal, una rama dentro de la criminología encargada del estudio de rasgos criminales fundamentada principalmente en parecidos fisiológicos. Estas ideas fueron recogidas y propuestas por Cesare Lombroso en su obra L'uomo delinquente (1876), en la cual el criminal era considerado en términos absolutos como un ser anormal, que sufría una desviación de base biológica que conducía a una regresión a los estados primitivos del ser humano. Los componentes de este paradigma se articulaban en la secuencia bio-psicosocial; donde el componente biológico era el más importante y el componente social muy pocas veces se tenía en cuenta.

En la actualidad se toman en cuenta datos y perspectivas sociológicas más que psicológicas para sugerir un origen propio de la criminalidad dentro de una sociedad.[69]

El efecto Flynn

Resumir

Contexto

Lleva el nombre de James R. Flynn, un neozelandés especializado en ciencia política, quien descubrió que en todo el mundo las puntuaciones de CI subían pausadamente a razón de tres puntos de CI por década (Flynn, 1999). Las explicaciones que se han propuesto han incluido la mejor nutrición, una tendencia hacia familias más pequeñas, la mejor educación, una mayor complejidad en el ambiente y la heterosis (Mingroni, 2004). Sin embargo, las pruebas se renormalizan ocasionalmente para obtener valores medios de 100 en la puntuación, como, por ejemplo, en WISC-R (1974), WISC-III (1991) y WISC-IV (2003). Por lo tanto, es difícil comparar puntuaciones de CI cuya medición dista varios años en el tiempo.

Hay una evidencia reciente que demuestra que la tendencia al alza de las puntuaciones en test de inteligencia ha remitido en algunos países del primer mundo. En 2004, Jon Martin Sundet (de la Universidad de Oslo) y algunos colaboradores publicaron un artículo documentando puntuaciones en test de inteligencia administrados a reclutas noruegos entre la década de 1950 y 2002, mostrando que el incremento en las puntuaciones en test de inteligencia general se detuvo después de mediados de la década de 1990, y que incluso disminuyó en el subtest de razonamiento numérico.

Thomas W. Teasdale (de la Universidad de Copenhague) y David R. Owen (del Brooklyn College de la ciudad de Nueva York) descubrieron resultados similares en Dinamarca, donde los resultados de los test de inteligencia mostraron que no hubo aumento durante la década de los noventa.

También hay indicaciones provenientes del Reino Unido de que las puntuaciones en los test de inteligencia no están siempre subiendo. Michael Shayer (un psicólogo del King's College de la Universidad de Londres) y dos colaboradores informaron que el rendimiento en los test de razonamiento de Física que se administraron a adolescentes británicos de las escuelas secundarias disminuyó considerablemente entre 1976 y 2003.

Edad y CI

Resumir

Contexto

El CI puede cambiar a lo largo de nuestra vida, sobre todo en la etapa infantil. A pesar de estas variaciones la puntuación sigue unos márgenes muy similares hasta la entrada de la edad adulta, donde comenzaría a disminuir lentamente. Este hecho se ha atribuido posteriormente por diversos investigadores en mayor medida al efecto Flynn y sus consecuencias colaterales, que no el envejecimiento del propio individuo.[70]

En términos de inteligencia y variabilidad, siguiendo el modelo propuesto por Raymond Cattell, podemos distinguir dos tipos: en la que la inteligencia fluida sería la que varía más a lo largo del tiempo y la cristalizada que permanece estable a lo largo de nuestra vida. Para estudiar empíricamente los cambios de la inteligencia asociados a la edad existen dos diseños de estudios fundamentales: el transversal, que consiste en la evaluación de grupos de distintas edades en un mismo momento temporal; y el longitudinal que consiste en evaluar un grupo de personas de la misma edad en distintos momentos de su vida. Además de estos dos tipos, encontramos un tercer modelo de estudio que combina los dos anteriores, llamado Time-lag o secuencial-transversal, que consiste en evaluar distintos grupos de personas por edades en distintos momentos temporales (Ej.: personas de 20, 30, y 40 años en los años 1950, 1960, y 1970).[62][71]

Polémica

Resumir

Contexto

En el año 1995, la divulgadora y profesora emérita K. C. Cole, en el marco de la publicación del libro The Bell Curve, escribiría una columna titulada "COLUMNA UNO : Las estadísticas pueden arrojarnos una curva : La polémica en torno a un libro que relaciona raza y cociente intelectual muestra las posibles trampas del análisis de datos. La mayoría de la gente cree que los números no mienten, pero los matemáticos saben que no es así"; en la columna, Cole se vale de un axioma elemental conocido como "correlación no implica causalidad" o también conocido implícitamente como la falacia Cum hoc ergo propter hoc para hacer su posterior análisis en torno a este tema:

Su controvertido libro saca a relucir un arsenal de artillería matemática para reforzar su propuesta de que la inteligencia se hereda en su mayor parte, que los negros tienen menos y que poco se puede hacer al respecto. Los revisores (por no hablar de los lectores) han admitido estar en shock ante tal aluvión de estadísticas, gráficos y análisis de regresión múltiple.

(...)

Correlación, dicen, no significa necesariamente causalidad. Correlación significa únicamente que una cosa tiene una relación con otra. A veces las causas pueden perderse en una maraña de factores en competencia tan impenetrable que ni siquiera un análisis matemático sofisticado logra resolverlas.[72]

Posteriormente y citando al matemático y divulgador de las matemáticas John Allen Paulos, autor del libro El hombre anumérico escribe:

"La verdad es que se puede establecer una correlación entre casi cualquier cosa", dijo el matemático de la Universidad de Temple John Allen Paulos, cuya investigación reveló la conexión entre los pies y la habilidad en matemáticas. "Es la mística de la precisión".

El psicólogo y estadístico Rand Wilcox de la USC coincidió: “La correlación no dice nada sobre la causalidad. Pero es un error que incluso cometen los investigadores”.

De hecho, las correlaciones pueden no ser más reveladoras que una coincidencia. O el momento.

Por ejemplo, los estudios revelan habitualmente un fuerte vínculo estadístico entre padres divorciados y adolescentes con problemas. Pero también es cierto que los adolescentes se sienten atraídos por los problemas sin importar lo que hagan los padres.

La “curva de campana”, dicen algunos expertos, es una variación más compleja de este tema. "Es muy posible que dos cosas se muevan juntas, pero ambas están siendo impulsadas por un tercer factor", dijo el estadístico de Stanford Ingram Olkin.

Paulos señala que casi todo lo que se correlaciona con un alto coeficiente intelectual también se asocia con altos ingresos. Esta conclusión no sorprende, dado que los padres adinerados pueden permitirse mejores escuelas, más libros y computadoras y, en general, criar niños más sanos y mejor nutridos.[72]

Por otro lado, el psicólogo canado-estadounidense Keith Stanovich en su tesis del 2009 titulada "What Intelligence Tests Miss: The Psychology of Rational Thought" señala que de hecho este tipo de pruebas carecen de importantes atributos cognitivos relacionados con la racionalidad humana, como por ejemplo las situaciones de juicio y de toma de decisiones, las cuales de por sí tienen atributos demasiado importantes dentro de la psique humana como para no ser evaluadas dentro de las mismas.[73]

Investigadores de la Universidad Western de Canadá y el Museo de Ciencia de Londres llevaron a cabo «el mayor estudio para medir la inteligencia» realizado hasta el momento, llegando a la conclusión de que la prueba del cociente intelectual resulta altamente engañosa. El objetivo del estudio era investigar si una sola cifra puede realmente medir las capacidades cognitivas, y reflejar si esta puede establecer las diferencias en las distintas habilidades cognitivas. Según estos investigadores, mediante pruebas de escáner cerebral se pueden constatar tres componentes cognitivos fundamentales —memoria a corto plazo, razonamiento y habilidad verbal— que corresponden a tres patrones distintos de actividad neural.[74]

Los resultados del estudio sugieren que las pruebas de CI tienen «fallos fundamentales» porque no toman en cuenta «la compleja naturaleza del intelecto humano con todos sus distintos componentes». La inteligencia se compone de circuitos diferentes y unas personas pueden destacar en un área de inteligencia y no en otra. Sería el caso, por ejemplo, de personas con habilidades lingüísticas fantásticas y una memoria brillante, pero con poca capacidad de razonamiento o viceversa. Los investigadores concluyen: «Nuestros resultados desmienten de una vez por todas la idea de que una sola medida de inteligencia, como es el cociente intelectual, es suficiente para concentrar todas las diferencias en la capacidad cognitiva que vemos entre las personas; el cerebro humano es el objeto más complejo que se conoce, por ahora, y la idea de que solo existe una medida de la inteligencia podría estar equivocada».[2][74][75]

Es importante aclarar que el cociente intelectual no se puede utilizar como sinónimo de inteligencia, pues es solamente un estimador de la misma. Sin embargo, en la mayoría de las lecturas no profesionales se comete el error de tomarlo como si fuera lo mismo. Por eso, se aconseja al lector que cada vez que lea o escuche algo sobre el CI se asegure de si se está hablando de este estimador de inteligencia o de la misma inteligencia.

Se ha demostrado que la inteligencia está relacionada con factores como la probabilidad de sufrir ciertas enfermedades,[76] el estatus social de los padres (por el acceso a una mejor educación, alimentación y salud)[77] y de forma sustancial, la inteligencia de los padres. Aunque los mecanismos de herencia de la inteligencia han sido investigados durante casi un siglo, aún existe controversia al respecto de hasta qué punto la inteligencia es hereditaria, y los mecanismos de dicha herencia son aún tema de debate.[78]

Notas

- En la escala de Stanford-Binet (16SD) la rareza para 185 puntos de CI es de una persona en una población de 18 496 011 con una media de 100ː

- En la escala de Stanford-Binet (16SD) con una media de 100, contando que para 2015 existían 7 376 471 981 humanos y donde erfc-1 es la función error inversa complementaria tenemos que el cociente intelectual máximo posible es 201 bajo la siguiente fórmulaː

- En la escala de Wechsler (15SD) con una media de 100, contando que para 2015 existían 7 376 471 981 humanos y donde erfc-1 es la función error inversa complementaria tenemos que el cociente intelectual máximo posible es 194 bajo la siguiente fórmulaː

Véase también

Referencias

Wikiwand - on

Seamless Wikipedia browsing. On steroids.