Stereodisplay

zwei- oder dreidimensionale Präsentation eines Bildes oder Films für den Tiefeneindruck Aus Wikipedia, der freien Enzyklopädie

Stereodisplay (auch 3D-Display, veraltet Raumbildprojektion) bezeichnet die Anzeige von stereoskopischen oder dreidimensionalen Bildern für einen Tiefeneindruck durch stereoskopisches Sehen mittels eines Bildschirm oder durch eine Projektion. Eine verbreitete Nutzung besteht in der Darstellung von 3D-Filmen. Darüber hinaus gibt es viele Anwendungsgebiete, beispielsweise in Forschung, Entwicklung, Medizin und Militär.

Unterscheidung zwischen Stereoskopie und 3D

Die Technik von stereoskopischen Displays besteht darin, zwei für das linke und rechte Auge leicht unterschiedliche Bilder darzustellen. Die beiden Bilder werden dann im Gehirn für die Tiefenwahrnehmung kombiniert. Obwohl häufig dafür der Ausdruck „3D“ verwendet wird, ist meist die Bezeichnung „stereoskopisch“ korrekter. Denn es ist ein Unterschied, ob zwei 2D-Bilder angezeigt werden oder ob mehrere Bilder oder sogar eine räumliche Projektion dargestellt wird. Der größte Unterschied besteht darin, dass die Kopf- und Augenbewegungen eines Betrachters bei einem stereoskopischen Bild nicht zu mehr Informationen über ein dargestelltes Objekt führen, also weder die Bewegungsparallaxe simuliert wird noch auf eine variable Betrachtungsdistanz akkommodiert werden kann. Autostereoskopie, Holografie und Volumendisplays sind Beispiele für Verfahren, die solche Einschränkungen nicht oder nur zum Teil haben.

Stereo-Displays

Zusammenfassung

Kontext

Allgemeines

Die Kanaltrennung bezeichnet bei stereoskopischen Betrachtungsmethoden die für die Augen nötige Trennung von linkem und rechtem Bild. Jedes Auge darf nur das ihm zugehörige Bild sehen. Der Idealfall ist eine hundertprozentige Kanaltrennung, bei der das rechte Bild für das linke Auge vollkommen unsichtbar ist und umgekehrt. Bei ungenügender Kanaltrennung entstehen Geisterbilder, Crosstalk oder Übersprechen genannt, welche die 3D-Wahrnehmung trüben und schlimmstenfalls zu Kopfschmerzen beim Betrachter führen können.[1] Crosstalk ist somit eine fehlerhafte Darstellung, bei der das Bild für das eine Auge auch für das andere Auge sichtbar ist. Dieser Effekt tritt vor allem in kontrastreichen Bildpartien auf. Verschiedene Verfahren beschäftigen sich mit der Reduktion des unerwünschten Übersprechens.[2]

Brillenbasierte Verfahren

Die Kanaltrennung wird mit Hilfe einer Stereo- oder 3D-Brille erreicht, die der Betrachter tragen muss. Es gibt mehrere verschiedene technische Verfahren, die die Trennung in Links- und Rechtsbild herbeiführen können.

Anaglyphe Projektion

Unter „Anaglyphenprojektion“ (aus griechisch ἀνά aná „auf“, „aufeinander“ und γλύφω glýphō „meißeln“, „gravieren“, auch „darstellen“) im ursprünglichen Sinne versteht man zwar grundsätzlich jede Stereoprojektion, bei der beide Teilbilder gleichzeitig auf dieselbe Projektionsfläche geschickt werden (auch die Polarisationsprojektion ist also streng genommen eine „Anaglyphenprojektion“), meist ist jedoch mit „anaglyphisch“ eine farbanaglyphische Darstellung gemeint: Zur Trennung der beiden Einzelbilder werden verschiedene Farbfilter in 3D-Brillen verwendet, ursprünglich Rot vor dem rechten Auge und Grün vor dem linken. Beim Ansehen des Films löscht der Rot-Filter das rote Filmbild aus, und das grüne Bild wird schwarz – der Grünfilter löscht das grüne Farbbild, und das rote wird schwarz. Da beide Augen nun unterschiedliche Bilder sehen, entsteht im Gehirn wieder ein räumliches Bild. Da das eine Auge ein „Rotbild“ sieht, das andere jedoch ein „Türkisbild“, interpretiert das Gehirn das meist als unbunt, also in Graustufen („Schwarzweißbild“).

Ende der 1970er Jahre verbesserte Stephen Gibson die Farbanaglyphentechnik mit seinem patentierten „Deep Vision“-System, das andere Filterfarben verwendet: Rot vor dem rechten Auge und Cyan vor dem linken. Inzwischen bietet auch die dänische Firma „Color Code“ ein eigenes Farbanaglyphen-System an. Die Filterfarben der „ColorCode“-Brillen sind Blau vor dem rechten Auge und Gelb vor dem linken. Für den Spielfilm „Journey to the Center of the Earth“ wurde 2008 in England ein weiteres Farbanaglyphenverfahren („Trio Scopics“) eingeführt, mit Grün vor dem linken Auge und Magenta vor dem rechten.

Vorteile des Verfahrens sind die äußerst einfachen und billigen Brillen und es funktioniert (für Standbilder) auch bei Druckerzeugnissen und (für Videos) über normale Farbfernseher oder mit normalen Farbmonitoren. Nachteil ist die Beschränkung auf Schwarz-Weiß-Ansichten für den Betrachter.

Polarisationsfiltertechnik

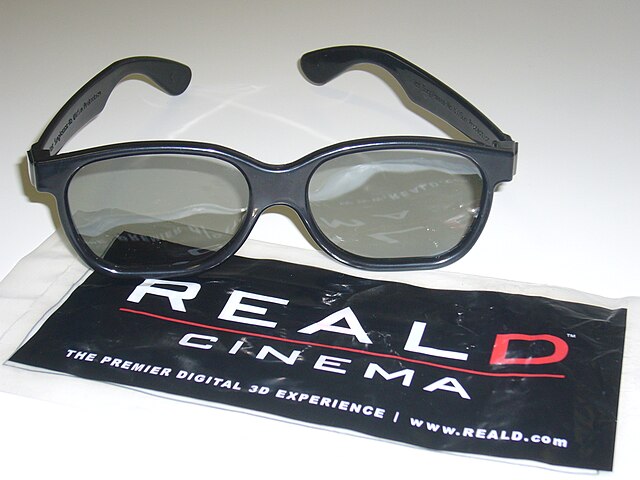

Bei dieser Projektionstechnik wird die Kanaltrennung mit linear (veraltet) oder zirkular polarisiertem Licht erreicht. Es befinden sich jeweils entgegengesetzte versetzte Polfilterfolien vor den Projektionsobjektiven und in den Polfilterbrillen der Betrachter. In Kinos werden hierzu zwei Projektoren verwendet; bei 3D-Fernsehern oder 3D-Computermonitoren ist meist ein Vorfilter verbaut, bei dem vor den geradzahligen Zeilen der Polarisationsfilter für das eine Auge und vor den ungeradezahligen Zeilen der Polfilter für das andere Auge eingebracht ist.

Bei Projektion wird zur Aufrechterhaltung des Polarisationsstatus des Lichts eine metallisch beschichtete Leinwand benötigt. Eine normale (matt-)weiße Leinwand reflektiert das Licht unter Verlust der Polarisation, wodurch die Kanaltrennung verloren geht.

Bei linear polarisiertem Licht sind rechtes und linkes Bild nur komplett zu trennen, wenn ein Winkel von 90° zwischen den Polfilter-Folien vor den Projektionslinsen besteht, ebenso bei den Filtern in der Brille. Der Kopf muss während der Bildbetrachtung stets gerade gehalten werden. Je schräger man den Kopf seitwärts neigt, desto schwächer wird die Kanaltrennung, es erscheinen „Geisterbilder“; bei 45° sind eigentliches Bild und Geisterbild gleich hell. Bei zirkular polarisiertem Licht, wie es moderne Verfahren wie Real-D verwenden, trifft das nicht mehr zu – man kann den Kopf ohne Nachteile frei neigen.

Ein weiteres Problem besteht in der uneinheitlichen Verwendung der Filter bei verschiedenen Herstellern von Brillen und Projektoren. Die Filter in der Brille müssen passend zu den Filtern im Projektor sein, sonst kommt es zu einer Vertauschung der Kanäle. Anwendung findet diese Technik außer im Privatbereich bei vielen IMAX-3D-Vorführungen und seit 2009 auch in vielen 3D-Kinos.

Der Vorteil der Polarisations-Projektionstechnik liegt in der hohen Farbtreue der gezeigten Bilder, auch sind die Brillen recht günstig und leicht und brauchen keinen Strom. Nachteilig ist der Helligkeitsverlust durch die verwendeten Filter und die höheren Kosten der metallischen Leinwand. Bei entsprechenden 3D-Fernsehern reduziert sich die Zeilenzahl auf die Hälfte.

Interferenzfiltertechnik

Die Interferenzfiltertechnik ist ein seinerzeit bei DaimlerChrysler entwickeltes System zur stereoskopischen Wiedergabe. Das System wird von der INFITEC GmbH weiterentwickelt und vertrieben. Die Firma DOLBY Inc. wendet das Verfahren unter dem Namen Dolby 3D an. Es arbeitet nach einem Lichtwellenlängenfiltersystem (Wellenlängenmultiplex). Für jedes Auge wird jeweils ein Teil der vom Auge als Rot-Grün-Blau empfundenen Wellenlängen durchgelassen und der des anderen Auges sehr effektiv blockiert. Hierbei werden die Grundfarben der Bilder also für das linke und rechte Auge auf jeweils unterschiedliche überlappungsfreie Wellenlängenbereiche reduziert.[3] Dabei arbeitet das Verfahren für den Betrachter scheinbar farbneutral, d. h., es kommt zu keinen sichtbaren Farbänderungen.

Bei dieser Betrachtungstechnik ist der Kopf beliebig neigbar, und es wird keine Silberleinwand benötigt. Darum kommt das Verfahren auch in Planetarien zum Einsatz. Die Brillengläser und Filter bestehen aus in einem Vakuumverfahren beschichtetem Glas und sind daher vergleichsweise teuer.

Erfolgt die Projektion von linken und rechten Bild abwechselnd mit einem Projektor (Filterrad zwischen Lampe und bildgebender Einheit bei Dolby 3D), benötigt dieses Verfahren einen Videoprozessor, der die Farbanteile der linken und rechten Ansicht unabhängig verändert, um die links und rechts unterschiedlichen Farbverfälschungen, die durch dieses Verfahren prinzipbedingt auftreten, wieder auszugleichen. Dies betrifft nahezu ausschließlich kommerzielle Kinos, bei denen die 3D-Projektion aus Gründen der Wirtschaftlichkeit sequentiell erfolgt, die Farbkorrektur also 144 Mal je Sekunde wechseln muss. Werden linkes und rechtes Bild durch separate Projektoren erzeugt, kann die Farbkorrektur hingegen in den Einstellungen der Projektoren selbst erfolgen.

Neuere Filtersysteme (Infitec II, Omega 3D) lassen pro Seite mehrere Frequenzbänder durch. Dadurch werden die Farbverfälschungen auch ohne Bearbeitung des Videosignals schon weitgehend bis vollständig vermieden, abhängig vom tatsächlichen Lichtspektrum des jeweiligen Projektorexemplars.

Grundlage für die Farbkorrektur ist die Metamerie, die es ermöglicht, aus unterschiedlichen Spektren denselben Farbeindruck im Auge zu erzeugen. Das Wellenlängenmultiplex-Verfahren ist nur für Projektionen geeignet, jedoch nicht für den Druck von 3D-Bildern.

Shuttertechnik

Bei dieser Methode werden die beiden Bilder für das rechte und das linke Auge nacheinander auf eine normale, weiße Leinwand projiziert oder auf einem normalen Monitor angezeigt. Für einen Film mit 24 Bildern pro Sekunde müssen also in der gleichen Zeit 48 Bilder auf die Leinwand gebracht werden, was für moderne Projektoren kein Problem darstellt. Um Flimmern zu vermeiden, werden meist höhere Frequenzen gewählt, wobei dann jedes einzelne Bild mehrfach gezeigt wird. Der Projektor gibt während der Vorführung über Infrarotsignalgeber, welche sich oberhalb der Leinwand befinden, Steuerimpulse an die von den Zuschauern getragenen Shutterbrillen. Diese Brillen verdunkeln dann abwechselnd das rechte und das linke (LCD-)Brillenglas und sorgen so dafür, dass jedes Auge nur das für es bestimmte Bild sieht. Vorteile sind dabei die hohe Farbtreue und die Nutzbarkeit einer normalen Leinwand sowie die Unabhängigkeit von der Kopfneigung des Betrachters. Außerdem ist ein solches System trotz der höheren Kosten für die Shutterbrillen bis zu einer gewissen Publikumsgröße kostengünstiger, da im Gegensatz zum Polarisationsverfahren weder ein zweiter Projektor noch ein Polfilter für die Projektoren noch eine metallisierte Leinwand erforderlich sind und der Synchronisierungsaufwand wegfällt.

Zu Anfang wurden Shutterbrillen auch durch kabelgebundene Signale synchronisiert, die zugleich die Energie für die Shuttertechnik lieferten. Heutige Shutterbrillen haben meist eingebaute Akkus.

Beim „3D-ready“-Heimkino-Projektor (meistens DLP-Beamer) wird über den HDMI-1.3-Anschluss i. d. R. ein 120 Hz-3D-Videosignal von einer 3D-tauglichen PC-Grafikkarte zugeführt und als 2x60-Hz-3D-Video zeitsequentiell projiziert. Neben passenden 3D-Shutterbrillen (z. B. Nvidia 3D-Vision mit eigenem USB-Infrarot-Sender) kann man ggfs. preiswerte sogenannte „DLP-Link“-Shutterbrillen verwenden, die von einem Projektor-Weißimpuls zwischen den Videobildern synchronisiert werden und deshalb keinen Infrarot-Sender benötigen. Nur 3D-Projektoren mit HDMI-1.4a-Anschluss können direkt mit 3D-HD-Signalen von 3D-Blu-ray-Playern oder HDTV-Receivern gespeist werden.

Nachteile des Verfahrens sind zum einen, dass die Brillen Elektronik beinhalten müssen, wodurch sie teurer und schwerer als bei den anderen Verfahren sind; enthaltene Akkus müssen aufgeladen werden. Zum anderen müssen Fernseher und Computermonitore, um Flimmern zu vermeiden, 144 Bilder pro Sekunde oder mehr darstellen können, ohne dass das vorherige Bild als Geisterbild erscheint.

Head-Mounted Display

Head-Mounted Displays oder Videobrillen sind vor den Augen getragene visuelles Ausgabegeräte, bei denen meist für das linke und rechte Auge getrennte Bildschirme vorhanden sind und die zwei Stereobilder so direkt vor dem jeweiligen Auge angezeigt werden können. Siehe z. B. Oculus Rift.

Prismengläser-Brillen

Eine Reihe von Verfahren nutzt auch den Effekt, dass Prismen den Strahlengang umlenken. So nutzt z. B. das Stereo-Sichtgerät SSG1b, auch unter dem Namen KMQ seit den 1980er Jahren bekannt, diesen Effekt. Vornehmlich für Bücher und Poster, wo es auf Farbtreue und Einfachheit ankommt. Es konnte aber schon früher am Bildschirm oder zur Projektion mit wenigen Zuschauern verwendet werden. Allerdings muss der Nutzer den passenden Abstand zum Bild beibehalten und seinen Kopf dauerhaft waagerecht halten. Ansonsten decken sich die Sehstrahlen beider Augen nicht mit den beiden Teilbildern, welche untereinander angeordnet sind. Daher rührt auch der englische Name des Verfahrens: Over-Under. Diese Einschränkungen sollen zukünftig von einem OpenHardware- bzw. Open-Source-Projekt namens openKMQ für die Arbeit am Computer aufgehoben werden.

Autostereoskopie

Bei der Autostereoskopie werden keine Brillen für die räumliche Betrachtung benötigt. Die Trennung in Links- und Rechtsbild findet mittels eines optischen Strahlteilers statt, der sich direkt vor dem Bildschirm befindet. Durch Linsen, Prismen oder Streifen wird bewirkt, dass jedes Auge einen unterschiedlichen Teilbereich des Bildschirms wahrnimmt. Durch geschicktes Verteilen der Bildinformation, dem Verschachteln, sieht der Betrachter immer zwei zusammenpassende Stereobilder, auch wenn er den Kopf seitlich hin und her bewegt. In gewissen Grenzen kann damit auch Bewegungsparallaxe simuliert werden, so dass es sich hierbei um echte 3D-Displays nach obiger Definition handelt.

Eine frühe Anwendung war die Projektion auf „Drahtgitter-Leinwände“, die erstmals in Moskau 1930 durchgeführt wurde. Ein derartiges mechanisches Bildtrennsystem wurde bereits 1906 von Estanawe postuliert, der ein feines Gitter von Metalllamellen als Leinwand vorschlug. Bei der Projektion müssen die Zuschauer sehr genau vor der Leinwand platziert sein, sonst können die Augen nicht das jeweils für sie bestimmte Bild sehen. Verbessert wurde das System durch Noaillon, der das Raster zum Zuschauer geneigt anordnete und die nun radial angeordneten Rasterstreifen leicht hin- und herbewegte. Weiterentwickelt wurde das System von Iwanow, der statt eines mechanischen Parallelrasters 30.000 sehr feine Kupferdrähte als Leinwand verwendete. Das aufwendige Verfahren erlangte keine Serienreife. Nur ein einziges Kino wurde für das System umgebaut, das Moskva in Moskau, und auch dort wurden nur wenige Filme in diesem Verfahren gezeigt, so zum Beispiel 1940 Zemlja Molodosti, Koncert (Das Land der Jugend / Konzert) und 1947 der russische Spielfilm Robinzon Kruzo, der immerhin über 100.000 Zuschauer vorweisen konnte.

Mittlerweile findet die Autostereoskopie wieder neue Anwendungsmöglichkeiten, beispielsweise beim Nintendo 3DS, Handys, Computerbildschirmen und Fernsehern.

3D-Displays

Zusammenfassung

Kontext

Volumendisplay

Bei einem Volumendisplay werden physikalische Mechanismen genutzt, Lichtpunkte im Raum schwebend darzustellen, z. B. über leuchtende Voxel in Gas, Nebel oder auf einer schnell rotierenden Milchglas-Scheibe bzw. -Helix. Andere Lösungen nutzen mehrere LCD.

Eines der Prinzipien eines Volumendisplay besteht darin, die Projektionsfläche zu bewegen, sodass diese ein ganzes Volumen überstreicht. Wenn dies schnell genug geschieht und je nach Position der Fläche andere Inhalte projiziert werden, fasst das menschliche Auge auf Grund seiner Trägheit alles insgesamt zu einem geschlossenen 3D-Bild zusammen.

Ein Ansatz ist die Verwendung einer spiralförmig gewundenen Fläche, geformt wie eine Windung einer Archimedischen Schraube. Diese Fläche wird senkrecht montiert und rotiert um eine senkrechte Achse. Ein 2-D-Projektor projiziert auf einen Sektor dieser Fläche das Bild, also auf eine schräge Fläche, die insgesamt je nach aktuellem Rotationswinkel höher oder tiefer liegt. Der Projektor muss synchron zur Rotation auf diesen Ausschnitt diejenigen Informationen projizieren, welche zu den jeweiligen Höhenpunkten auf der schrägen Fläche passen. Der schottische TV-Pionier J.L. Baird meldete 1941 sein volumetrisches 3D- und Farb-TV-System zum Patent an. Aktuelle Laborsysteme (Japan, GB) verwenden u. a. Laserlichtquellen.

Sphären-Display

Ein Sphären-Display ist ein Wiedergabegerät in Form einer Kugel, mit dessen Hilfe Benutzer dreidimensionale Objekte betrachten und mit ihnen interagieren können.

Möglich wird diese interaktive Visualisierung durch acht Projektoren im Taschenformat (Pico-Projektoren), die im Fußteil der Kugel untergebracht sind, sowie einer leistungsstarken Software, die das Zusammenspiel der einzelnen Projektoren koordiniert und für eine automatische Kalibrierung der Projektoren sorgt. Somit ist es möglich, Auflösung und Helligkeit der einzelnen projizierten Bilder derart miteinander nahtlos zu verbinden, dass ein Rückgang der Qualität verhindert wird und eine einheitliche Darstellung einer 3D-Animation fast überall auf der Kugeloberfläche möglich wird. Dies gelingt vor allem durch den Einsatz einer Webcam, welche die Position der einzelnen Projektionen feststellt und ihren Beitrag zum Gesamtbild in der Kugel gezielt berechnet.

Um die Interaktion mit Menschen in der Umgebung zu ermöglichen, verwendet das Display sechs Infrarot-Kameras. Sie verfolgen die Bewegung der Zuschauer, die mit Hilfe eines Sensors gekennzeichnet sind. Durch die Daten der Kameras kann ein Computer ständig die virtuelle Szene perspektivisch bezogen auf die Position eines Betrachters korrigieren. Darüber hinaus ermöglicht eine Leap-Motion-Schnittstelle die Steuerung und Interaktion der 3-D-Szenen und Animationen mit Gesten. Somit ist es beispielsweise möglich, eine Animation zu beginnen oder vorwärts und rückwärts zu bewegen.[4]

Holographisches Display

Pseudostereoskopische Verfahren

Pulfrich-Verfahren

Sogenannte „Pulfrich-Brillen“ mit hell/dunklen Filtern (z. B. „Nuoptix“), nutzen den „Pulfrich-Effekt“ für einen 3D-Eindruck bei seitlichen Kamerafahrten und wurden z. B. durch die RTL-Fernsehsendung Tutti Frutti Anfang der 1990er-Jahre sehr verbreitet. Bei dem Pulfrich-Verfahren handelt es sich nicht um eine echte stereoskopische Darstellung, da das Bild hier nur mit einer einzigen Kamera aufgenommen wird. Die beiden Perspektiven für das linke und rechte Auge kommen durch das verdunkelte Brillenglas zustande, das auf dem Pulfrich-Prinzip beruht. Die abgedunkelte Ansicht wird dabei dem Gehirn zeitverzögert weitergegeben, so dass zwei Ansichten aus unterschiedlichen Perspektiven (allerdings zeitlich versetzt) den Raumeindruck bilden. Dieses Verfahren ist nur sehr begrenzt einsetzbar, weil hier wichtige Voraussetzungen erfüllt sein müssen, damit dieses Verfahren als 3D-Verfahren überhaupt funktioniert. So muss die Kamera oder die Objekte immer (grundsätzlich und immerwährend) eine konstante, langsame, ausschließlich horizontale Bewegung durchführen. Wird nur eine dieser Voraussetzungen nicht erfüllt, tritt kein 3D-Effekt mehr ein.

ChromaDepth-Verfahren

Das ChromaDepth-Verfahren von American Paper Optics basiert auf der Tatsache, dass bei einem Prisma Farben unterschiedlich stark gebrochen werden. Die ChromaDepth-Brille enthält spezielle Sichtfolien, die aus mikroskopisch kleinen Prismen bestehen. Dadurch werden Lichtstrahlen je nach Farbe unterschiedlich stark abgelenkt. Die Lichtstrahlen treffen im Auge an unterschiedlichen Stellen auf. Da das Gehirn jedoch von geraden Lichtstrahlen ausgeht, entsteht der Eindruck, die unterschiedlichen Farben kämen von unterschiedlichen Standpunkten. Somit erzeugt das Gehirn aus dieser Differenz den räumlichen Eindruck (3D-Effekt). Der Vorteil dieses Verfahrens besteht vor allem darin, dass man ChromaDepth-Bilder auch ohne Brille (also zweidimensional) problemlos ansehen kann – es sind keine störenden Doppelbilder vorhanden. Außerdem können ChromaDepth-Bilder ohne Verlust des 3D-Effektes beliebig gedreht werden. Allerdings sind die Farben nur beschränkt wählbar, da sie die Tiefeninformation des Bildes enthalten. Verändert man die Farbe eines Objekts, dann ändert sich auch dessen wahrgenommene Entfernung. Dies bedeutet, dass ein rotes Objekt immer vor z. B. grünen oder blauen Objekten liegen wird.

Pseudoholographie

Gelegentlich wird auch die trickreiche Umsetzung des als Pepper’s ghost bekannten Zaubertricks als "holographisches Display" bezeichnet. Es handelt sich aber nur um eine 2D- oder Stereoprojektion.[5][6]

Einzelnachweise

Literatur

Weblinks

Wikiwand - on

Seamless Wikipedia browsing. On steroids.