Вялікія даныя

From Wikipedia, the free encyclopedia

Вялікія даныя (вялікія звесткі) — тэрмін для азначэння набораў даных (англ.: data sets), якія з’яўляюцца настолькі вялікімі і складанымі, што традыцыйнае прыкладное праграмнае забеспячэнне для апрацоўкі даных не падыходзіць. Да праблемаў аналізу вялікіх даных адносяцца збор, захаванне, аналіз, пошук, абмен, перадача, візуалізацыя, фільтрацыя, абнаўленне, канфідэнцыяльнасць і крыніца даных. Цяперашняе выкарыстанне тэрміна «вялікія даныя», як правіла, адносіцца да выкарыстання прагнастычнай аналітыкі, аналітыкі паводзін карыстальнікаў або некаторых іншых перадавых метадаў аналітыкі даных і рэдка — да пэўнага памеру набору даных.

Артыкул вымагае праверкі арфаграфіі Удзельнік, які паставіў шаблон, не пакінуў тлумачэнняў. |

Аналіз набораў даных можа знайсці новыя сувязі для «выяўлення бізнес тэндэнцый, прадухілення хвароб, змагання са злачыннасцю і інш.»[2] Навукоўцы, бізнесмены, медыкі-практыкі, рэкламшчыкі і ўрады вельмі часта сустракаюцца са складанасцямі з вялікімі данымі ў такіх галінах як інтэрнэт-пошук, фінансавая і бізнес-інфарматыка. Навукоўцы сутыкаюцца з абмежаваннямі ў працы электроннай навукі (e-Science), якая ўключае метэаралогію, геноміку[2], канэктоміку, складаныя фізіялагічныя сімуляцыі, біялагічныя і экалагічныя даследаванні[3].

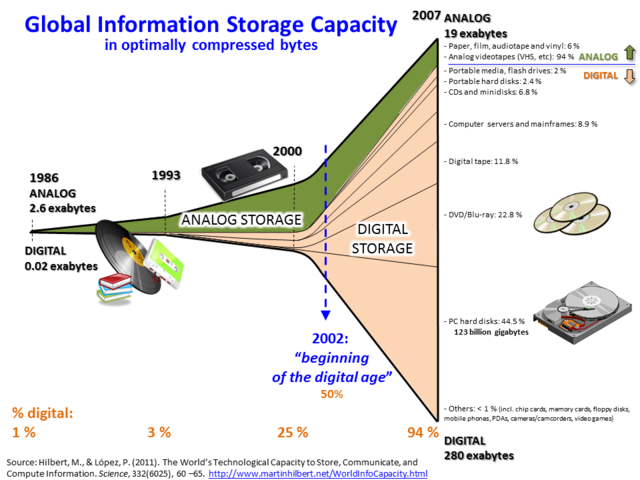

Наборы даных растуць вельмі хутка і часткова таму што яны вельмі танна збіраюцца шэрагам мабільных прылад з інфа-сэнсарамі, у паветры (remote sensing), праграмнымі логамі, камерамі, мікрафонамі, радыё-рыдэрамі (radio-frequency identification (RFID)) і бесправаднымі сэнсарнымі сеткамі[4][5]. Сусветныя тэхналагічныя магчымасці захоўвання інфармацыі на чалавека падвойваліся кожныя 40 месяцаў з 1980-ых[6]; у 2012 кожны дзень ствараецца 2,5 эксабайт (2.5×1018) даных[7]. Для буйных прадпрыемстваў узнікае новае пытанне, хто павінен валодаць вялікімі данымі, якія ўздзейнічаюць на ўсю арганізацыю[8].

Сістэмы кіравання рэляцыйнымі базамі даных і статыстычнае праграмнае забеспячэнне для візуалізацыі даных часта адчуваюць цяжкасці з апрацоўкай і аналізам вялікіх даных. Часта такая задача патрабуе «праграмнага забеспячэння, здольнага працаваць паралельна на дзясятках, сотнях і нават тысячах сервераў»[9]. Што лічыць «вялікімі данымі» залежыць ад магчымасцяў карыстальнікаў і іх інструментаў. «Для некаторых арганізацый сутыкненне з сотнямі гігабайт даных можа выклікаць неабходнасць пераглядзець варыянты кіравання данымі. Для іншых могуць спатрэбіцца дзясяткі ці сотні тэрабайт, перш чым памер даных стане важным фактарам»[10].